หน้านี้แสดงรายการการทดสอบทั้งหมดใน Camera Image Test Suite (ITS) ซึ่งเป็นส่วนหนึ่งของ Android ชุดเครื่องมือทดสอบความเข้ากันได้ (CTS) Verifier การทดสอบ ITS เป็นการทดสอบการทำงาน ซึ่งหมายความว่าไม่ได้วัดคุณภาพของรูปภาพ แต่ฟังก์ชันกล้องทั้งหมดที่โฆษณาทำงานได้ตามที่คาดไว้ เอกสารนี้ช่วยให้นักพัฒนาแอปและผู้ทดสอบเข้าใจว่าการทดสอบแต่ละรายการทำอะไรและวิธีแก้ไขข้อบกพร่องของการทดสอบที่ไม่สำเร็จ

ITS ของกล้องจะควบคุมการทดสอบตามพร็อพเพอร์ตี้ของกล้องที่จำเป็น ระดับ API และ

ระดับ Media Performance Class (MPC) สำหรับระดับ API นั้น ITS จะใช้

ro.product.first_api_level เพื่อควบคุมการทดสอบที่เพิ่มในระดับ API ที่เฉพาะเจาะจง ซึ่ง

ทดสอบประสบการณ์ของผู้ใช้ในเชิงลบสำหรับฟังก์ชันการทำงานในระดับ API ที่ต่ำกว่า ITS ใช้ ro.vendor.api_level เพื่อควบคุมการทดสอบฟีเจอร์ที่เพิ่มในระดับ API หนึ่งๆ ซึ่งต้องใช้ความสามารถของฮาร์ดแวร์ใหม่ หากกำหนด ro.odm.build.media_performance_class สำหรับอุปกรณ์ ITS จะกำหนดให้มีการทดสอบเฉพาะที่ต้องดำเนินการตามระดับ MPC

การทดสอบจะจัดกลุ่มตามฉากดังนี้

scene0: จับข้อมูลเมตา Jitter เครื่องวัดการหมุน การสั่นscene1: การเปิดรับแสง ความไว การชดเชยค่าการเปิดรับแสง (EV), YUV เทียบกับ JPEG และ RAWscene2: การตรวจจับใบหน้า การทดสอบที่ต้องใช้ฉากสีscene3: การขยายสัญญาณ การเคลื่อนไหวของเลนส์scene4: สัดส่วนภาพ การครอบตัด มุมมองscene5: การไล่ระดับสีของเลนส์scene6: ซูมscene7: สวิตช์กล้องหลายตัวscene8: การรับแสงอัตโนมัติ (AE) และสมดุลสีขาวอัตโนมัติ (AWB) การวัดแสงตามพื้นที่scene9: การบีบอัด JPEGscene_extensions: ส่วนขยายกล้องscene_tele: การสลับเลนส์เทเลโฟโต้scene_flash: แฟลชอัตโนมัติ อัตราเฟรมขั้นต่ำscene_video: เฟรมหลุดsensor_fusion: ออฟเซ็ตเวลาของกล้องและไจโรสโคปfeature_combination: การรวมฟีเจอร์scene_ip: ความเท่าเทียมของรูปภาพระหว่างแอปกล้องเริ่มต้นกับ แอปกล้อง Jetpack (JCA)

ดูคำอธิบายของแต่ละฉากได้ในส่วนต่างๆ

scene0

การทดสอบไม่จำเป็นต้องมีข้อมูลฉากที่เฉพาะเจาะจง อย่างไรก็ตาม โทรศัพท์ต้อง อยู่นิ่งสำหรับการทดสอบเครื่องวัดการหมุนและการสั่น

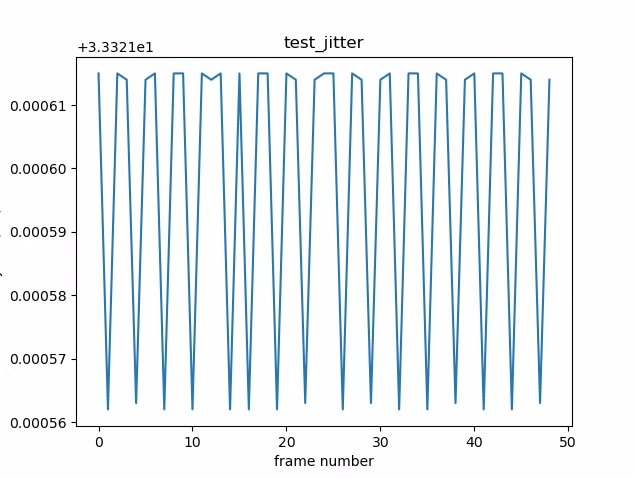

test_jitter

วัดความกระตุกในแสตมป์เวลาของกล้อง

API ที่ทดสอบ:

android.hardware.camera2.CaptureResult#SENSOR_TIMESTAMPandroid.hardware.camera2.CaptureRequest#CONTROL_AE_TARGET_FPS_RANGE

ผ่าน: มีเดลต้าอย่างน้อย 30 มิลลิวินาทีระหว่างเฟรม

ในรูปต่อไปนี้ โปรดสังเกตช่วงแกน y ขนาดเล็ก จริงๆ แล้วความกระวนกระวายมีน้อย ในพล็อตนี้

รูปที่ 1 แผนภาพ test_jitter

test_metadata

ทดสอบความถูกต้องของรายการข้อมูลเมตา โดยดูผลการจับภาพและออบเจ็กต์ลักษณะกล้อง การทดสอบนี้ใช้ค่าการรับแสงและค่าเกนเนื่องจากเนื้อหาของรูปภาพไม่สำคัญauto_capture_request

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#INFO_SUPPORTED_HARDWARE_LEVELandroid.hardware.camera2.CameraCharacteristics#SCALER_CROPPING_TYPEandroid.hardware.camera2.CameraCharacteristics#SENSOR_BLACK_LEVEL_PATTERNandroid.hardware.camera2.CameraCharacteristics#SENSOR_INFO_TIMESTAMP_SOURCEandroid.hardware.camera2.CaptureRequest#SENSOR_FRAME_DURATIONandroid.hardware.camera2.CaptureResult#SENSOR_ROLLING_SHUTTER_SKEW

ผ่าน: แท็กระดับฮาร์ดแวร์ rollingShutterSkew, frameDuration

timestampSource, croppingType, blackLevelPattern, pixel_pitch

ขอบเขตการมองเห็น (FoV) และระยะชัดลึกมีอยู่และมีค่าที่ถูกต้อง

test_request_capture_match

การทดสอบที่อุปกรณ์เขียนค่าการรับแสงและค่าเกนที่ถูกต้องโดยการอ่านข้อมูลเมตาของการจับภาพ

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#SENSOR_INFO_EXPOSURE_TIME_RANGEandroid.hardware.camera2.CameraCharacteristics#SENSOR_INFO_SENSITIVITY_RANGEandroid.hardware.camera2.CaptureRequest#SENSOR_EXPOSURE_TIMEandroid.hardware.camera2.CaptureRequest#SENSOR_SENSITIVITYandroid.hardware.camera2.CaptureResult#SENSOR_EXPOSURE_TIMEandroid.hardware.camera2.CaptureResult#SENSOR_SENSITIVITY

ผ่าน: คำขอและค่าข้อมูลเมตาที่บันทึกไว้ตรงกันในทุกช็อต

test_sensor_events

สำหรับอุปกรณ์ที่โฆษณารองรับการรวมเซ็นเซอร์ การทดสอบนี้จะตรวจสอบว่า อุปกรณ์ค้นหาและพิมพ์เหตุการณ์เซ็นเซอร์หรือไม่ เซ็นเซอร์ที่คาดไว้คือ ตัวตรวจวัดความเร่ง เครื่องวัดการหมุน และเครื่องวัดค่าความเข้มข้นของสนามแม่เหล็ก การทดสอบนี้จะทำงานได้ก็ต่อเมื่อหน้าจอ เปิดอยู่ ซึ่งหมายความว่าอุปกรณ์ไม่ได้อยู่ในโหมดสแตนด์บาย

API ที่ทดสอบ:

ผ่าน: ได้รับเหตุการณ์สำหรับเซ็นเซอร์แต่ละตัว

test_solid_color_test_pattern

การทดสอบว่ารูปแบบการทดสอบสีทึบสร้างขึ้นอย่างถูกต้องสำหรับการปิดเสียงกล้อง หากรองรับการปิดเสียงกล้อง จะต้องรองรับรูปแบบการทดสอบสีทึบ หากไม่รองรับการปิดเสียงกล้อง ระบบจะทดสอบรูปแบบการทดสอบสีทึบเฉพาะในกรณีที่มีการโฆษณาความสามารถนี้

หากระบบรองรับรูปภาพดิบ เราจะทดสอบการกำหนดสีด้วย สีที่ทดสอบคือดำ ขาว แดง น้ำเงิน และเขียว สำหรับกล้องที่ไม่รองรับ รูปภาพ RAW ระบบจะทดสอบเฉพาะสีดำ

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristic#SENSOR_AVAILABLE_TEST_PATTERN_MODESandroid.hardware.camera2.CaptureResult#SENSOR_TEST_PATTERN_DATAandroid.hardware.camera2.CaptureResult#SENSOR_TEST_PATTERN_MODE

ผ่าน: รูปแบบการทดสอบสีทึบที่รองรับมีสีถูกต้องและมีความแปรปรวนต่ำในรูปภาพ

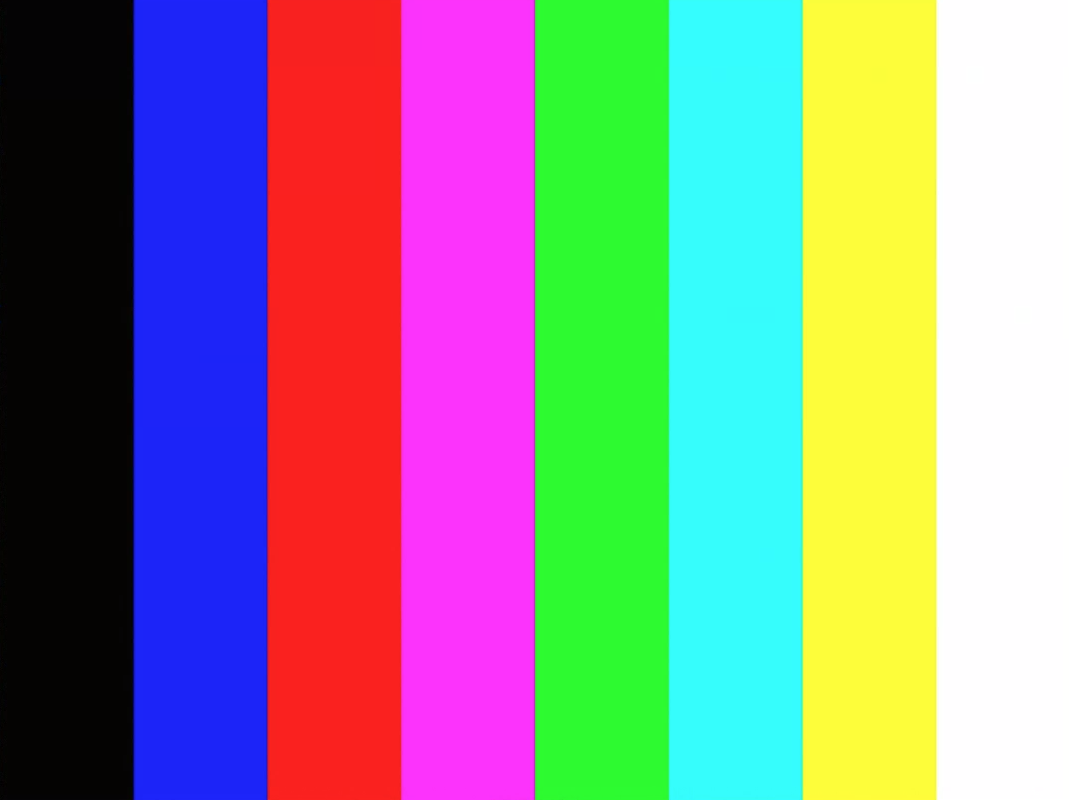

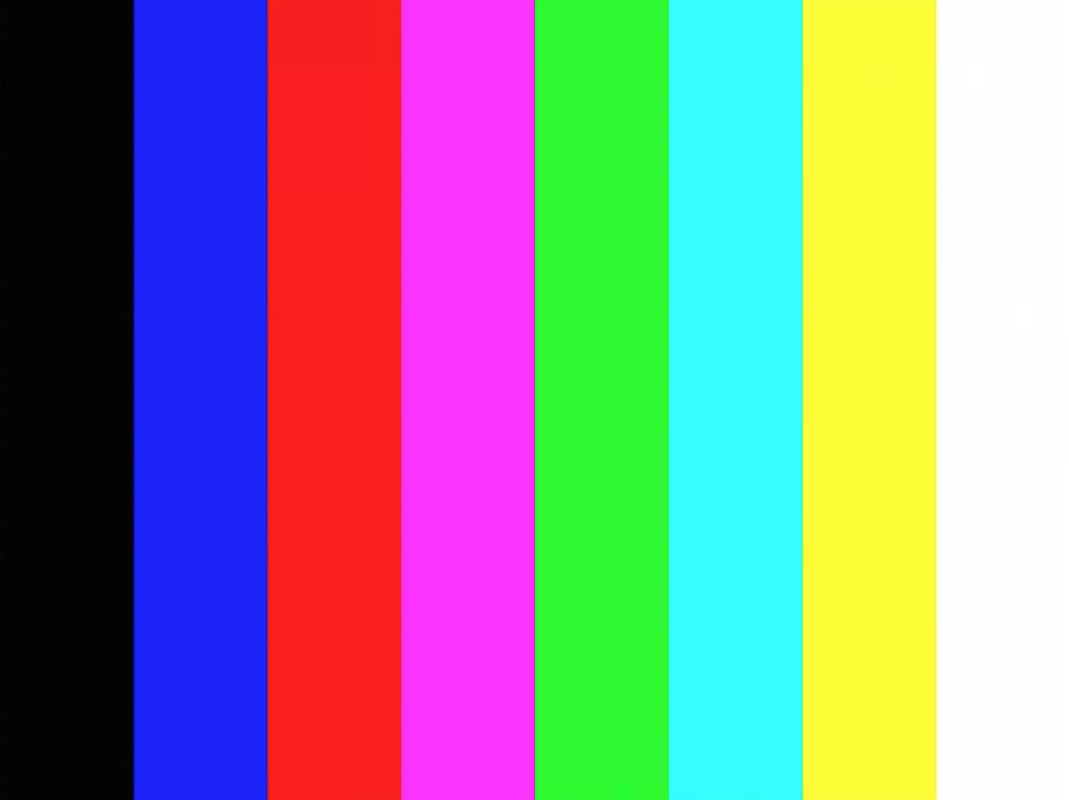

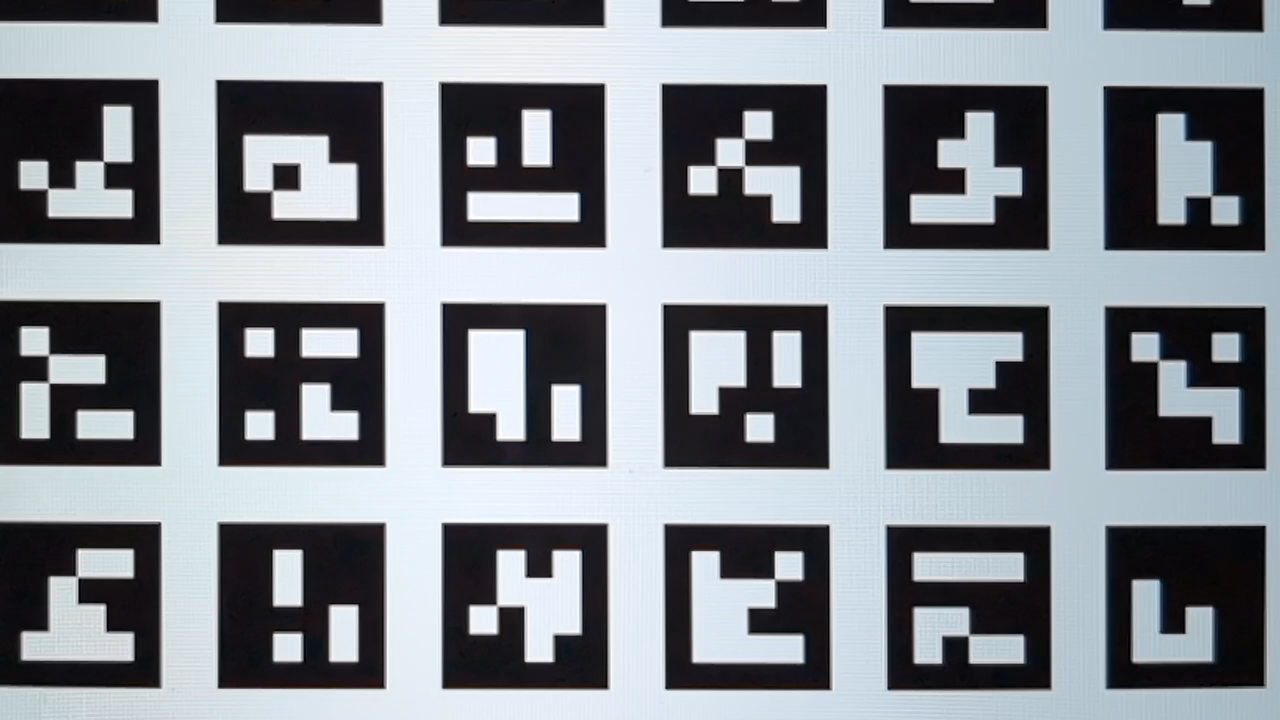

test_test_pattern

ทดสอบพารามิเตอร์ android.sensor.testPatternMode เพื่อบันทึกเฟรมสำหรับรูปแบบการทดสอบที่ถูกต้องแต่ละรูปแบบ และตรวจสอบว่าเฟรมสร้างขึ้นอย่างถูกต้องสำหรับสีทึบและแถบสี การทดสอบนี้มีขั้นตอนต่อไปนี้

- บันทึกรูปภาพสำหรับรูปแบบการทดสอบที่รองรับทั้งหมด

- ทำการตรวจสอบความถูกต้องสำหรับรูปแบบการทดสอบสีเดียวและแถบสี

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristic#SENSOR_AVAILABLE_TEST_PATTERN_MODESandroid.hardware.camera2.CaptureResult#SENSOR_TEST_PATTERN_MODE

ผ่าน: สร้างรูปแบบการทดสอบที่รองรับได้อย่างถูกต้อง

รูปที่ 2 ตัวอย่าง test_test_patterns

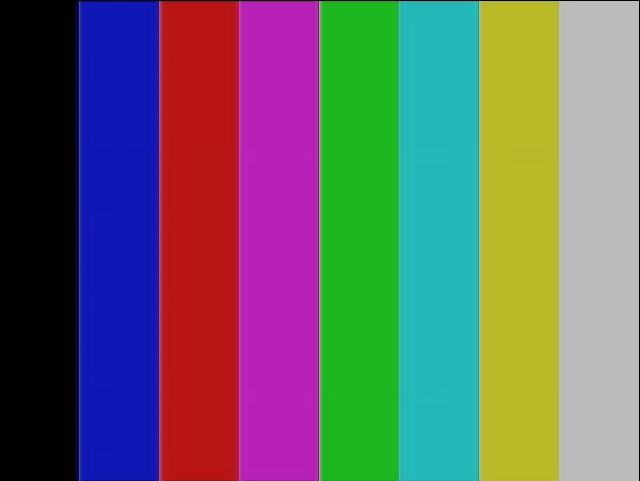

test_tonemap_curve

ทดสอบการแปลงรูปแบบการทดสอบจาก RAW เป็น YUV ด้วยการแมปโทนเชิงเส้น การทดสอบนี้

ต้องใช้ android.sensor.testPatternMode = 2 (COLOR_BARS) เพื่อสร้าง

รูปแบบรูปภาพที่สมบูรณ์แบบสำหรับการแปลงโทนแมป ตรวจสอบว่าไปป์ไลน์มี

เอาต์พุตสีที่เหมาะสมพร้อมการแมปโทนเชิงเส้นและอินพุตรูปภาพที่เหมาะสม (ขึ้นอยู่กับ

test_test_patterns)

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#DISTORTION_CORRECTION_MODEandroid.hardware.camera2.CaptureRequest#SENSOR_TEST_PATTERN_MODEandroid.hardware.camera2.CaptureRequest#TONEMAP_CURVEandroid.hardware.camera2.CaptureRequest#TONEMAP_MODE

ผ่าน: YUV และ RAW ดูคล้ายกัน

รูปที่ 3 ตัวอย่างไฟล์ดิบของ test_tonemap_curve

รูปที่ 4 ตัวอย่าง YUV ของ test_tonemap_curve

test_unified_timestamp

ทดสอบว่าเหตุการณ์เซ็นเซอร์รูปภาพและเซ็นเซอร์ตรวจจับความเคลื่อนไหวอยู่ในโดเมนเวลาเดียวกันหรือไม่

API ที่ทดสอบ:

android.hardware.camera2.CaptureResult#SENSOR_TIMESTAMPandroid.hardware.Sensorandroid.hardware.SensorEventandroid.hardware.Sensor#TYPE_ACCELEROMETERandroid.hardware.Sensor#TYPE_GYROSCOPE

ผ่าน: การประทับเวลาการเคลื่อนไหวอยู่ระหว่างการประทับเวลารูปภาพ 2 รายการ

test_vibration_restriction

ทดสอบว่าการสั่นของอุปกรณ์ทำงานตามที่คาดไว้หรือไม่

API ที่ทดสอบ:

android.hardware.Sensorandroid.hardware.SensorEventandroid.hardware.Sensor#TYPE_ACCELEROMETERandroid.os.Vibratorandroid.hardware.camera2.CameraDevice#setCameraAudioRestriction

ผ่าน: อุปกรณ์ไม่สั่นเมื่อปิดเสียงโดย API การจำกัดเสียงของกล้อง

scene1_1

scene1 เป็นแผนภูมิสีเทา ชาร์ตสีเทาต้องครอบคลุม 30% ตรงกลางของ FoV ของกล้อง คาดว่าแผนภูมิสีเทาจะท้าทาย 3A (AE, AWB และ AF) ในระดับปานกลางเนื่องจากบริเวณตรงกลางไม่มีฟีเจอร์

อย่างไรก็ตาม คำขอจับภาพจะระบุฉากทั้งหมดซึ่งมี

ฟีเจอร์ที่เพียงพอสำหรับ 3A ในการรวมกัน

คุณสามารถทดสอบกล้อง RFoV ได้ในแท่นทดสอบ WFoV หรือ RFoV หากทดสอบกล้อง RFoV ในแท่นทดสอบ WFoV ระบบจะปรับขนาดแผนภูมิเป็น 2/3 เพื่อระบุขอบเขตบางอย่างสำหรับแผนภูมิสีเทาใน FoV เพื่อช่วยให้ 3A ทำงานร่วมกันได้ ดูคำอธิบายโดยละเอียดเพิ่มเติมเกี่ยวกับอุปกรณ์ทดสอบกล้องได้ที่ ITS กล้องในกล่อง

รูปที่ 5 แผนภูมิฉากที่ 1 ขนาดเต็ม (ซ้าย), แผนภูมิที่ปรับขนาด 2/3 (ขวา)

test_ae_precapture_trigger

ทดสอบเครื่องสถานะ AE เมื่อใช้ทริกเกอร์ก่อนการจับภาพ บันทึกคำขอที่ดำเนินการด้วยตนเอง 5 รายการเมื่อปิดใช้ AE คำขอสุดท้ายมีทริกเกอร์การจับภาพก่อน AE ซึ่งควรละเว้นเนื่องจากปิดใช้ AE

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#CONTROL_AE_MODEandroid.hardware.camera2.CaptureRequest#CONTROL_AE_PRECAPTURE_TRIGGERandroid.hardware.camera2.CaptureResult#CONTROL_AE_STATE

ผ่าน: AE บรรจบกัน

test_auto_vs_manual

การทดสอบที่บันทึกภาพอัตโนมัติและภาพที่ถ่ายด้วยตนเองจะดูเหมือนกัน

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#COLOR_CORRECTION_GAINSandroid.hardware.camera2.CaptureRequest#COLOR_CORRECTION_TRANSFORMandroid.hardware.camera2.CaptureResult#TONEMAP_CURVEandroid.hardware.camera2.CaptureResult#TONEMAP_MODE

ผ่าน: การปรับสมดุลสีขาวด้วยตนเองและการแปลงที่รายงานในผลลัพธ์การจับภาพแต่ละรายการ ตรงกับการปรับสมดุลสีขาวอัตโนมัติ estimate จากอัลกอริทึม 3A ของกล้อง

รูปที่ 6. ตัวอย่างการทดสอบอัตโนมัติเทียบกับแคมเปญอัตโนมัติ

รูปที่ 7. ตัวอย่างไวท์บาลานซ์ทดสอบอัตโนมัติเทียบกับแมนนวล

รูปที่ 8. ตัวอย่างการแปลงการปรับสมดุลแสงขาวด้วยตนเอง test_auto_vs_manual

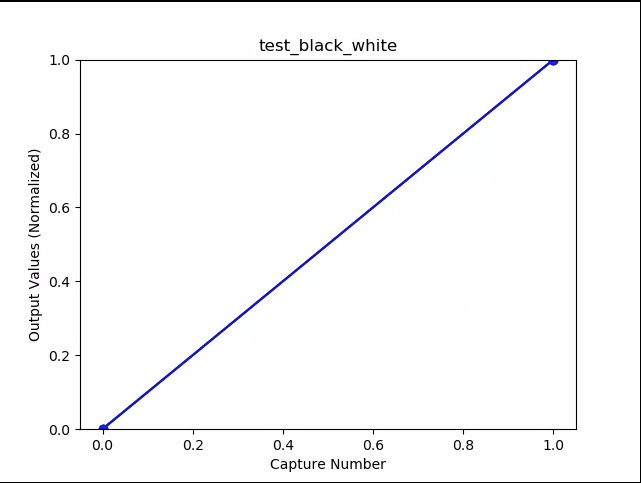

test_black_white

การทดสอบที่อุปกรณ์สร้างรูปภาพขาวดำเต็มรูปแบบ ถ่ายภาพ 2 ครั้ง ครั้งแรกใช้ค่าเกนต่ำมากและค่าแสงสั้น ซึ่งจะทำให้ได้ภาพสีดำ และครั้งที่ 2 ใช้ค่าเกนสูงมากและค่าแสงยาว ซึ่งจะทำให้ได้ภาพสีขาว

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#SENSOR_EXPOSURE_TIMEandroid.hardware.camera2.CaptureRequest#SENSOR_SENSITIVITY

ผ่าน: สร้างรูปภาพขาวดำ ช่องที่อิ่มตัวของรูปภาพสีขาวมีค่า RGB เป็น [255, 255, 255] โดยมีส่วนต่างของข้อผิดพลาดน้อยกว่า 1%

รูปที่ 9 test_black_white, ตัวอย่างสีดำ

รูปที่ 10 test_black_white, ตัวอย่างสีขาว

รูปที่ 11 test_black_white, plot means example

test_burst_capture

ยืนยันว่าไปป์ไลน์การจับภาพทั้งหมดสามารถรองรับความเร็วของ การจับภาพขนาดเต็มและเวลา CPU ได้

API ที่ทดสอบ:

ผ่าน: จับภาพต่อเนื่องขนาดเต็ม ตรวจสอบเฟรมหลุดและความสว่างของรูปภาพ

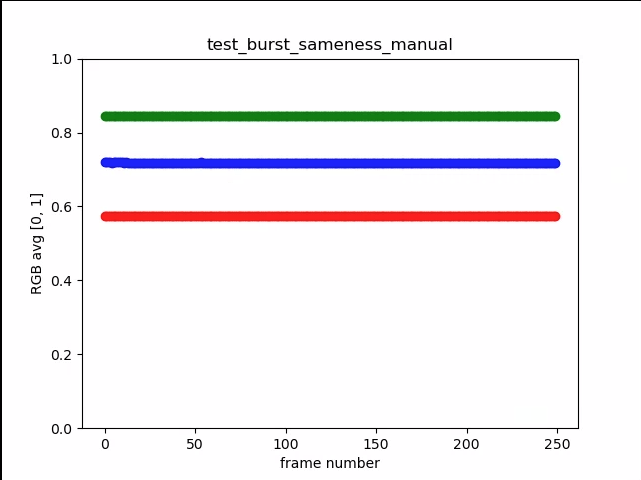

test_burst_sameness_manual

ถ่ายภาพต่อเนื่อง 5 ชุด ชุดละ 50 ภาพด้วยการตั้งค่าการจับภาพด้วยตนเอง และตรวจสอบว่าภาพทั้งหมดเหมือนกัน ใช้การทดสอบนี้เพื่อระบุว่ามีเฟรมเป็นครั้งคราว ที่ประมวลผลแตกต่างกันหรือมีอาร์ติแฟกต์หรือไม่

API ที่ทดสอบ:

android.hardware.camera2.CameraMetadata#REQUEST_AVAILABLE_CAPABILITIES_MANUAL_SENSORandroid.hardware.camera2.CameraMetadata#SYNC_MAX_LATENCY_PER_FRAME_CONTROL

ผ่าน: รูปภาพเหมือนกันทั้งในด้านภาพและค่า RGB

ไม่ผ่าน: แสดงจุดสูงสุดหรือจุดต่ำสุดของแผนภูมิค่าเฉลี่ย RGB ที่จุดเริ่มต้นของ แต่ละการระเบิด

- ความคลาดเคลื่อนคือ 3% สำหรับ

first_API_level< 30 - ความคลาดเคลื่อนคือ 2% สำหรับ

first_API_level>= 30

รูปที่ 12. ตัวอย่างค่าเฉลี่ยของ test_burst_sameness_manual

รูปที่ 13 test_burst_sameness_manual_plot_means

test_crop_region_raw

ทดสอบว่าสตรีม RAW ครอบตัดไม่ได้

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#SENSOR_INFO_ACTIVE_ARRAY_SIZEandroid.hardware.camera2.CaptureResult#SCALER_CROP_REGIONandroid.hardware.camera2.CaptureRequest#SCALER_CROP_REGION

ผ่าน: รูปภาพ YUV จะได้รับการครอบตัดตรงกลาง แต่รูปภาพ RAW จะไม่ได้รับการครอบตัด

รูปที่ 14. test_crop_region_raw comp raw crop example

รูปที่ 15. test_crop_region_raw comp raw full example

รูปที่ 16 ตัวอย่างการครอบตัด YUV ของ test_crop_region_raw comp

รูปที่ 17 ตัวอย่างแบบเต็มของ test_crop_region_raw YUV

test_crop_regions

การทดสอบที่ครอบตัดภูมิภาคทำงาน รับรูปภาพเต็มและสร้างแพตช์ของ 5 ภูมิภาคที่แตกต่างกัน (มุมและตรงกลาง) ถ่ายภาพโดยตั้งค่าการครอบตัดสำหรับ 5 ภูมิภาค เปรียบเทียบค่าของแพตช์และรูปภาพที่ครอบตัด

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#SENSOR_INFO_ACTIVE_ARRAY_SIZEandroid.hardware.camera2.CaptureRequest#SCALER_CROP_REGION

ผ่าน: รูปภาพของภูมิภาคที่ครอบตัดตรงกับแพตช์ที่สอดคล้องกับ รูปภาพที่ครอบตัด

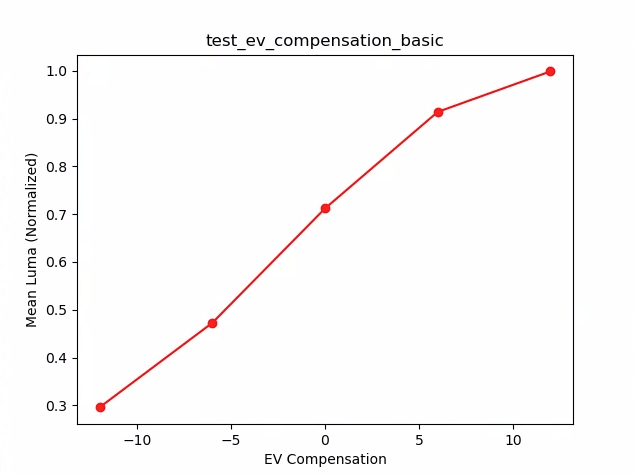

test_ev_compensation

ทดสอบว่ามีการชดเชยค่าการรับแสง (EV) หรือไม่ การทดสอบประกอบด้วย ส่วนพื้นฐานและส่วนขั้นสูง

ส่วนพื้นฐานจะทดสอบว่ามีการชดเชย EV โดยใช้ช่วง

ที่สร้างด้วย CONTROL_AE_COMPENSATION_STEP ระบบจะจับภาพ 8 เฟรมที่ค่า

การชดเชยแต่ละค่า

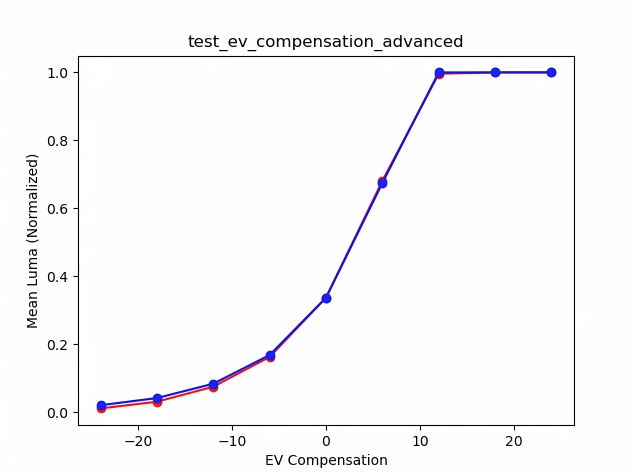

ส่วนขั้นสูงจะเพิ่มการเปิดรับแสงใน 8 ขั้นตอน และตรวจสอบความสว่างที่วัดได้เทียบกับความสว่างที่คาดไว้ ระบบจะคำนวณค่าที่คาดไว้จาก ความสว่างของรูปภาพที่ไม่มีการชดเชย EV และ ค่าที่คาดไว้จะอิ่มตัวหากค่าที่คำนวณเกินช่วงค่าของรูปภาพจริง การทดสอบจะล้มเหลวหากค่าที่คาดไว้และค่าที่วัดได้ไม่ตรงกัน หรือหากรูปภาพสว่างเกินไปภายใน 5 ขั้นตอน

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#CONTROL_AE_COMPENSATION_STEPandroid.hardware.camera2.CaptureRequest#CONTROL_AE_EXPOSURE_COMPENSATIONandroid.hardware.camera2.CaptureRequest#CONTROL_AE_LOCKandroid.hardware.camera2.CaptureResult#CONTROL_AE_STATEandroid.hardware.camera2.CaptureRequest#CONTROL_AWB_LOCKandroid.hardware.camera2.CaptureResult#TONEMAP_CURVEandroid.hardware.camera2.CaptureResult#TONEMAP_MODE

การผ่านส่วนพื้นฐาน: รูปภาพแสดงการเพิ่มการเปิดรับแสงโดยไม่เปิดรับแสงมากเกินไป ภายใน 5 ขั้นตอน

รูปที่ 18 test_ev_compensation_basic

การผ่านส่วนขั้นสูง: จับภาพการเพิ่มขึ้นของลูมาเมื่อการตั้งค่าการชดเชย EV เพิ่มขึ้น เฟรมทั้ง 8 ที่บันทึกไว้สำหรับการตั้งค่าการชดเชย EV แต่ละรายการมีค่าความสว่างที่เสถียร

รูปที่ 19 test_ev_compensation_advanced_plot_means

test_exposure_x_iso

การทดสอบที่แสดงให้เห็นว่าการเปิดรับแสงคงที่เกิดขึ้นเมื่อ ISO และเวลาเปิดรับแสงแตกต่างกัน ถ่ายภาพหลายๆ ช็อตโดยเลือก ISO และเวลาเปิดรับแสงให้สมดุลกัน

ผลลัพธ์ควรมีความสว่างเท่ากัน แต่ภาพควรมีสัญญาณรบกวนมากขึ้นเมื่อเวลาผ่านไป

ยืนยันว่าค่าเฉลี่ยของพิกเซลตัวอย่างอยู่ใกล้กัน ตรวจสอบว่ารูปภาพไม่ได้ถูกจำกัดไว้ที่ 0 หรือ 1 (ซึ่งจะทำให้ดูเหมือนเส้นตรง) นอกจากนี้ คุณยังเรียกใช้การทดสอบกับรูปภาพ RAW ได้โดยตั้งค่าแฟล็ก debug ใน

ไฟล์การกำหนดค่า

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#SENSOR_EXPOSURE_TIMEandroid.hardware.camera2.CaptureRequest#SENSOR_SENSITIVITY

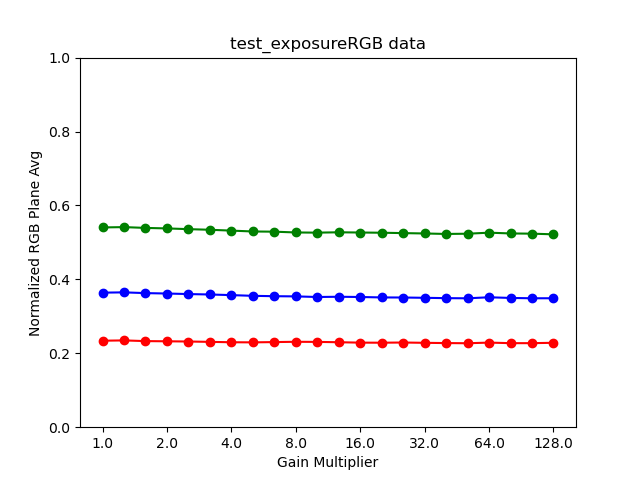

ผ่าน: รูปภาพมีความสว่างเท่ากัน แต่มีสัญญาณรบกวนมากขึ้นเมื่อ ISO สูงขึ้น ระนาบ RGB จะแบนเมื่อค่าของ ISO*exposure คงที่ในพื้นที่เกนที่ทดสอบ

กลไกการล้มเหลว: ในรูปต่อไปนี้ เมื่อค่าตัวคูณเกน (แกน x) เพิ่มขึ้น ค่าเฉลี่ยของระนาบ RGB ที่ปรับให้เป็นมาตรฐาน (แกน y) จะเริ่ม เบี่ยงเบนจากค่าตัวคูณเกนต่ำ

รูปที่ 20 test_exposure_plot_means

รูปที่ 21 test_exposure_mult=1.00

รูปที่ 22 test_exposure_mult=64.00

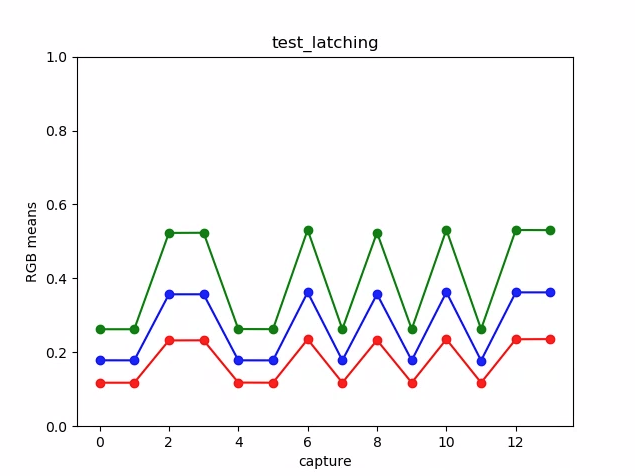

test_latching

การทดสอบที่การตั้งค่า (การรับแสงและอัตราขยาย) จะยึดเฟรมขวาสำหรับกล้อง FULL และ

LEVEL_3 ถ่ายภาพหลายๆ ช็อตโดยใช้คำขอแบบต่อเนื่อง

และเปลี่ยนพารามิเตอร์คำขอจับภาพระหว่างช็อต ตรวจสอบว่ารูปภาพมีพร็อพเพอร์ตี้ที่คาดไว้

API ที่ทดสอบ:

ผ่าน: รูปภาพ [2, 3, 6, 8, 10, 12, 13] มี ISO หรือการเปิดรับแสงเพิ่มขึ้น และแสดงด้วยค่าเฉลี่ย RGB ที่สูงขึ้นในพล็อตในรูปต่อไปนี้

รูปที่ 23 พล็อต test_latching หมายถึงตัวอย่าง

รูปที่ 24 test_latching i=00

รูปที่ 25 test_latching i=01

รูปที่ 26 test_latching i=02

รูปที่ 27. test_latching i=03

รูปที่ 28 test_latching i=04

รูปที่ 29 test_latching i=05

รูปที่ 30 test_latching i=06

รูปที่ 31 test_latching i=07

รูปที่ 32 test_latching i=08

รูปที่ 33 test_latching i=09

รูปที่ 34 test_latching i=10

รูปที่ 35 test_latching i=11

รูปที่ 36 test_latching i=12

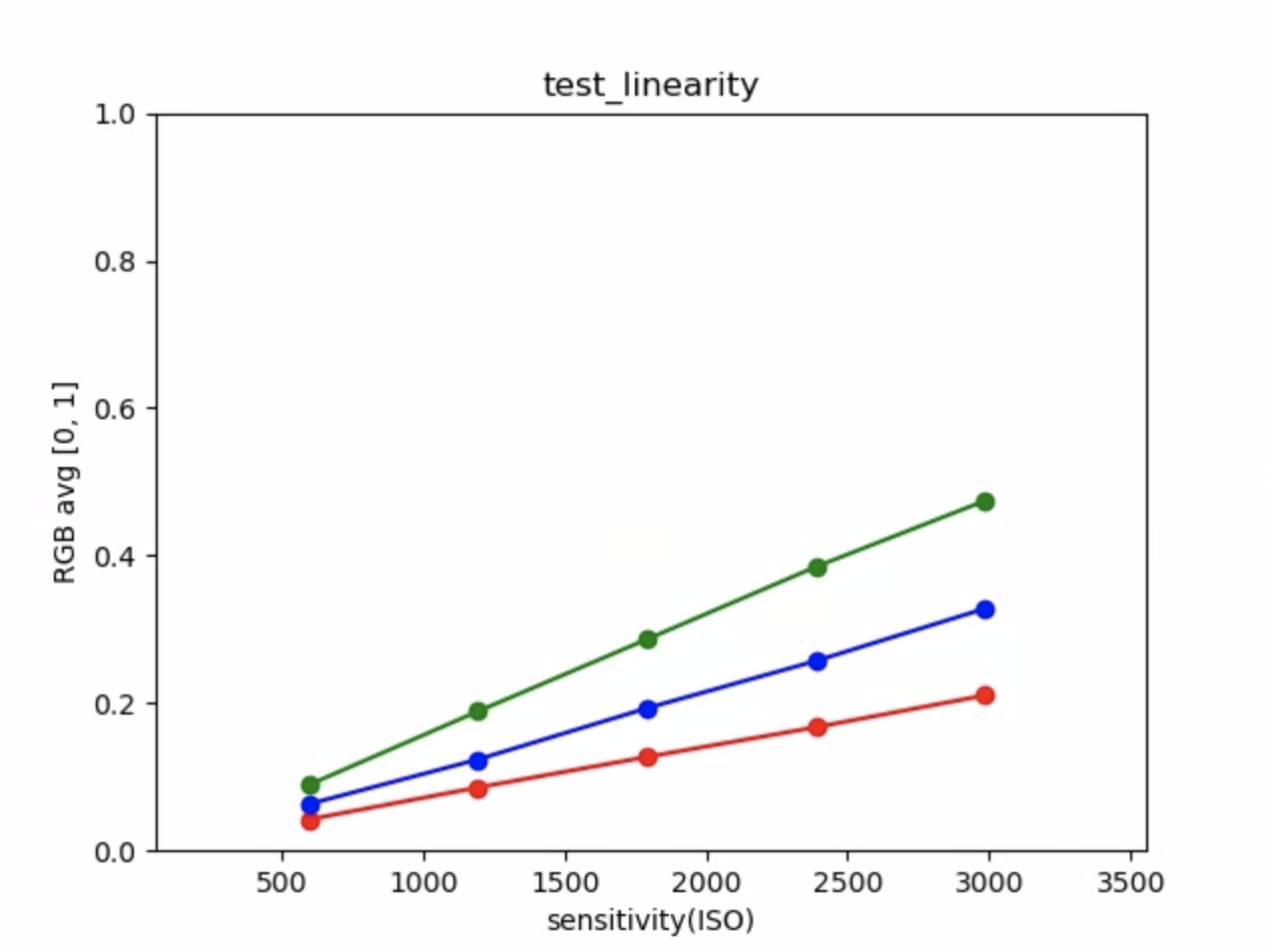

test_linearity

การทดสอบที่สามารถกลับการประมวลผลของอุปกรณ์เป็นพิกเซลเชิงเส้น บันทึกลำดับภาพโดยเล็งอุปกรณ์ไปที่เป้าหมายที่สม่ำเสมอ

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#SENSOR_INFO_SENSITIVITY_RANGEandroid.hardware.camera2.CaptureRequest#BLACK_LEVEL_LOCKandroid.hardware.camera2.CaptureRequest#SENSOR_SENSITIVITYandroid.hardware.camera2.CaptureRequest#TONEMAP_CURVEandroid.hardware.camera2.CaptureRequest#TONEMAP_MODE

ผ่าน: ค่า R, G, B ต้องเพิ่มขึ้นเป็นเส้นตรงเมื่อความไวเพิ่มขึ้น

รูปที่ 37 พล็อต test_linearity หมายถึงตัวอย่าง

test_locked_burst

ทดสอบการล็อก 3A และการถ่ายภาพต่อเนื่อง YUV (ใช้การตั้งค่าอัตโนมัติ) การทดสอบนี้ออกแบบมาให้ผ่าน

แม้ในอุปกรณ์ที่มีข้อจำกัดซึ่งไม่มี MANUAL_SENSOR หรือ PER_FRAME_CONTROLS

การทดสอบจะตรวจสอบความสอดคล้องของรูปภาพ YUV ขณะที่การตรวจสอบอัตราเฟรมอยู่ใน CTS

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#CONTROL_AE_LOCKandroid.hardware.camera2.CaptureRequest#CONTROL_AWB_LOCK

ผ่าน: ภาพที่บันทึกดูสอดคล้องกัน

รูปที่ 38. ตัวอย่างเฟรม 0 ของ test_locked_burst

รูปที่ 39 ตัวอย่างเฟรม 1 ของ test_locked_burst

รูปที่ 40 ตัวอย่างเฟรม test_locked_burst2

scene1_2

scene 1_2 เป็นสำเนาของ scene 1_1 ที่มีฟังก์ชันการทำงานเหมือนกันทุกประการ โดยใช้โครงสร้างฉากย่อยเพื่อลดระยะเวลาที่ยาวนานของ scene 1

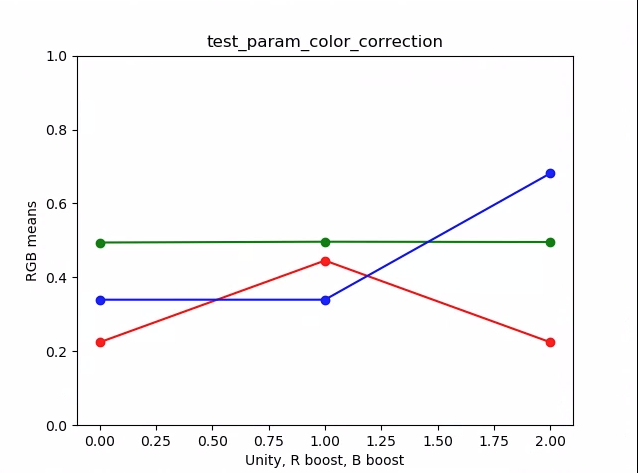

test_param_color_correction

การทดสอบที่ใช้พารามิเตอร์ android.colorCorrection.* เมื่อตั้งค่า

ถ่ายภาพโดยใช้ค่าการแปลงและค่าเกนที่แตกต่างกัน และทดสอบว่าภาพดูแตกต่างกันตามค่าที่ใช้ ระบบจะเลือกการเปลี่ยนรูปและการเพิ่มเพื่อให้เอาต์พุต

มีสีแดงหรือสีน้ำเงินมากขึ้น ใช้การแมปโทนแบบเชิงเส้น

การแมปโทนสีเป็นเทคนิคที่ใช้ในการประมวลผลรูปภาพเพื่อแมปชุดสีหนึ่งไปยังอีกชุดหนึ่งเพื่อประมาณลักษณะของรูปภาพที่มีช่วงไดนามิกสูงในสื่อที่มีช่วงไดนามิกจำกัดกว่า

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#COLOR_CORRECTION_GAINSandroid.hardware.camera2.CaptureRequest#COLOR_CORRECTION_MODEandroid.hardware.camera2.CaptureRequest#COLOR_CORRECTION_TRANSFORM

ผ่าน: ค่า R และ B จะเพิ่มขึ้นตามการแปลง

รูปที่ 41 พล็อต test_param_color_correction หมายถึงตัวอย่าง

ในรูปที่ตามมา แกน x คือคำขอการจับภาพ: 0 = ความเป็นเอกภาพ, 1 = การเพิ่มสีแดง และ 2 = การเพิ่มสีน้ำเงิน

รูปที่ 42. test_param_color_correction req=0 ตัวอย่าง Unity

รูปที่ 43. test_param_color_correctness req=1 ตัวอย่างการเพิ่มสีแดง

รูปที่ 44. test_param_color_correction req=2 ตัวอย่างการเพิ่มสีน้ำเงิน

test_param_flash_mode

การทดสอบที่ใช้พารามิเตอร์ android.flash.mode ตั้งค่าการเปิดรับแสงด้วยตนเองให้เป็นด้านมืด เพื่อให้เห็นได้ชัดว่าแฟลชทำงานหรือไม่ และใช้การแมปโทนแบบเชิงเส้น ตรวจสอบกึ่งกลางด้วยรูปภาพไทล์เพื่อดู

ว่ามีไล่ระดับสีขนาดใหญ่ที่สร้างขึ้นเพื่อยืนยันว่าแฟลชทำงานหรือไม่

API ที่ทดสอบ:

ผ่าน: ตรงกลางของรูปภาพไทล์มีการไล่ระดับสีมาก ซึ่งหมายความว่า แฟลชทำงาน

รูปที่ 45 ตัวอย่าง test_param_flash_mode 1

รูปที่ 46. ตัวอย่างไทล์เดียวของ test_param_flash_mode

รูปที่ 47 ตัวอย่าง test_param_flash_mode 2

รูปที่ 48 ตัวอย่างการ์ด 2 ใบของ test_param_flash_mode

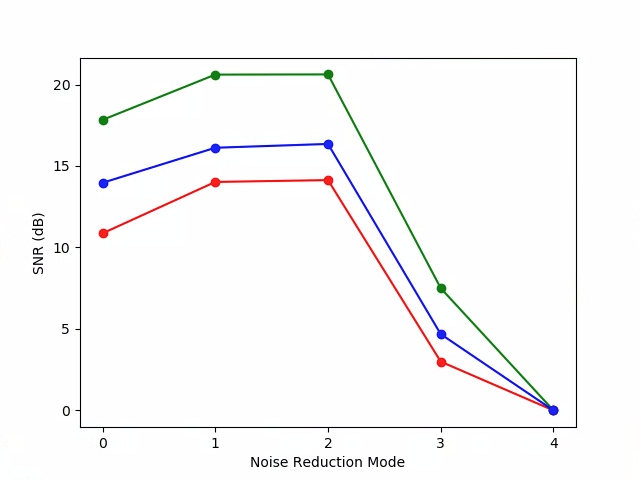

test_param_noise_reduction

ทดสอบว่ามีการใช้พารามิเตอร์ android.noiseReduction.mode อย่างถูกต้อง

เมื่อตั้งค่า ถ่ายภาพด้วยกล้องในที่แสงน้อย ใช้เกนแอนะล็อกสูงเพื่อ

ช่วยให้มั่นใจว่ารูปภาพที่ถ่ายมีสัญญาณรบกวน ถ่ายภาพ 3 ภาพสำหรับปิด NR, เร็ว

และคุณภาพสูง นอกจากนี้ ยังจับภาพที่มีค่าเกนต่ำและปิด NR ไว้ แล้วใช้

ความแปรปรวนของภาพนี้เป็นพื้นฐาน ยิ่งอัตราส่วนสัญญาณต่อสัญญาณรบกวน (SNR)

สูงขึ้น คุณภาพของภาพก็จะยิ่งดีขึ้น

API ที่ทดสอบ:

ผ่าน: SNR จะแตกต่างกันไปตามโหมดการลดเสียงรบกวนต่างๆ และมีลักษณะคล้ายกับกราฟต่อไปนี้

รูปที่ 49 พล็อต test_param_noise_reduction ตัวอย่าง SNR

0: ปิด, 1: เร็ว, 2: คุณภาพสูง, 3: ต่ำสุด , 4: ZSL

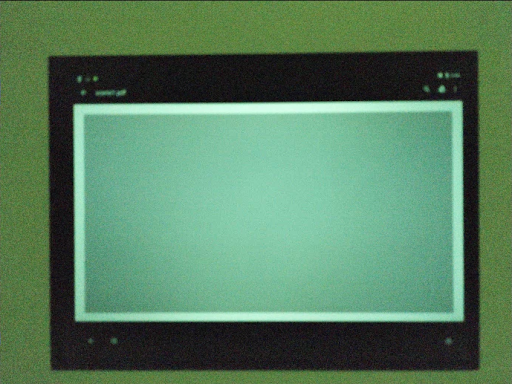

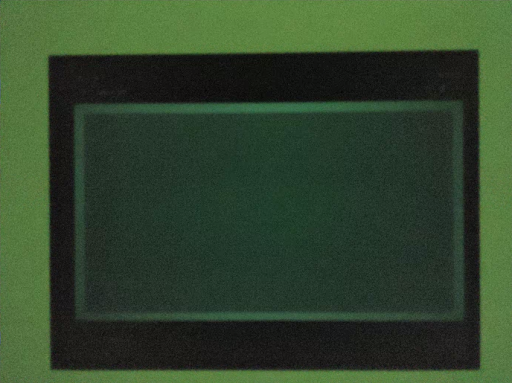

รูปที่ 50 ตัวอย่าง test_param_noise_reduction high gain nr=0

รูปที่ 51. ตัวอย่าง test_param_noise_reduction high gain nr=1

รูปที่ 52. ตัวอย่าง test_param_noise_reduction high gain nr=2

รูปที่ 53 ตัวอย่าง test_param_noise_reduction ที่มี nr=3 และอัตราขยายสูง

รูปที่ 54 ตัวอย่างการลดเสียงรบกวนที่มีการเพิ่มค่า test_param_noise_reduction ต่ำ

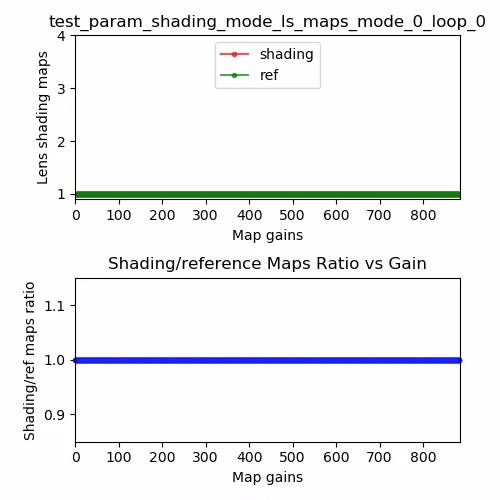

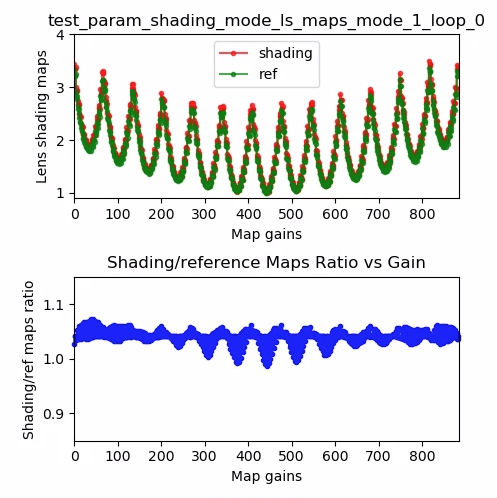

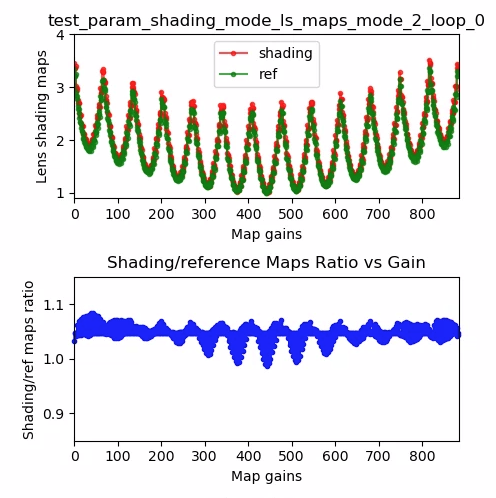

test_param_shading_mode

การทดสอบที่ใช้พารามิเตอร์ android.shading.mode

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#SHADING_MODEandroid.hardware.camera2.CaptureRequest#STATISTICS_LENS_SHADING_MAP_MODEandroid.hardware.camera2.CaptureResult#STATISTICS_LENS_SHADING_CORRECTION_MAP

ผ่าน: ระบบจะสลับโหมดการแรเงาและแก้ไขแผนที่การแรเงาเลนส์ตามที่คาดไว้

รูปที่ 55. แผนที่การแรเงาเลนส์ test_param_shading_mode, ตัวอย่างลูป 0 โหมด 0

รูปที่ 56. แผนที่การแรเงาเลนส์ test_param_shading_mode ตัวอย่างลูป 0 โหมด 1

รูปที่ 57. แผนที่การแรเงาเลนส์ test_param_shading_mode, ตัวอย่างลูป 0 โหมด 2

test_param_tonemap_mode

การทดสอบที่ใช้พารามิเตอร์ android.tonemap.mode ใช้เส้นโค้งการแมปโทนที่แตกต่างกันกับช่อง R, G, B แต่ละช่อง และตรวจสอบว่ารูปภาพเอาต์พุตได้รับการแก้ไขตามที่คาดไว้ การทดสอบนี้ประกอบด้วยการทดสอบ 2 รายการ ได้แก่ test1 และ test2

API ที่ทดสอบ:

android.hardware.camera2.CameraMetadata#TONEMAP_MODE_CONTRAST_MODEandroid.hardware.camera2.CameraMetadata#TONEMAP_MODE_FASTandroid.hardware.camera2.CaptureRequest#TONEMAP_CURVEandroid.hardware.camera2.CaptureRequest#TONEMAP_MODE

บัตร:

test1: รูปภาพทั้ง 2 มีการแมปโทนแบบเส้นตรง แต่n=1มีการไล่ระดับสีที่ชันกว่า ช่อง G (สีเขียว) จะสว่างกว่าสำหรับn=1test2: การแมปโทนเหมือนกัน แต่ความยาวต่างกัน รูปภาพเหมือนกัน

รูปที่ 58 test_param_tonemap_mode โดยมี n=0

รูปที่ 59. test_param_tonemap_mode ที่มี n=1

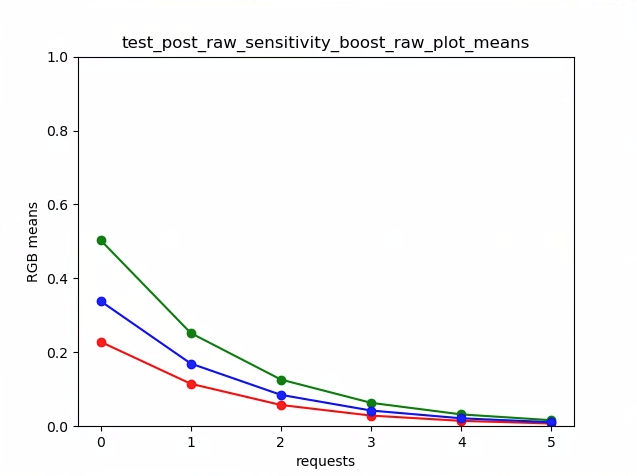

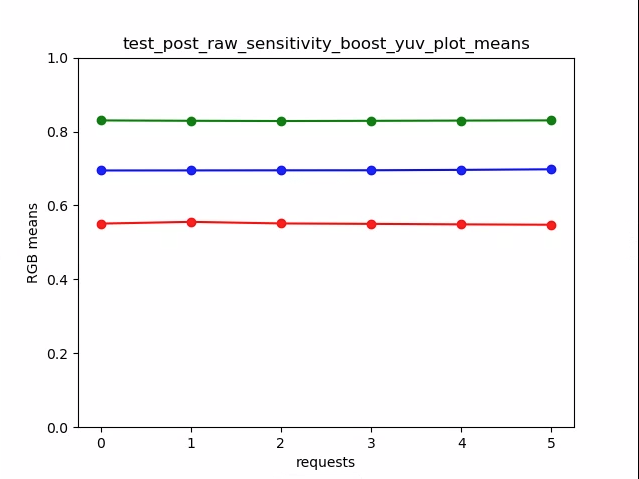

test_post_raw_sensitivity_boost

ตรวจสอบการเพิ่มความไวของโพสต์ดิบ บันทึกชุดรูปภาพ RAW และ YUV ที่มีความไวต่างกัน โพสต์การเพิ่มความไว RAW และตรวจสอบว่า ค่าเฉลี่ยของพิกเซลเอาต์พุตตรงกับการตั้งค่าคำขอหรือไม่

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#CONTROL_POST_RAW_SENSITIVITY_BOOST_RANGEandroid.hardware.camera2.CameraMetadata#REQUEST_AVAILABLE_CAPABILITIES_RAWandroid.hardware.camera2.CaptureRequest#CONTROL_POST_RAW_SENSITIVITY_BOOSTandroid.hardware.camera2.CaptureRequest#SENSOR_SENSITIVITY

ผ่าน: รูปภาพ RAW จะมืดลงเมื่อเพิ่มการบูสต์ ขณะที่ความสว่างของรูปภาพ YUV จะคงที่

รูปที่ 60. test_post_raw_sensitivity_boost raw s=3583 boost=0100 example

รูปที่ 61. test_post_raw_sensitivity_boost raw s=1792 boost=0200 example

รูปที่ 62. ตัวอย่าง test_post_raw_sensitivity_boost raw s=0896 boost=0400

รูปที่ 63. ตัวอย่าง test_post_raw_sensitivity_boost raw s=0448 boost=0800

รูปที่ 64. ตัวอย่าง test_post_raw_sensitivity_boost raw s=0224 boost=1600

รูปที่ 65 ตัวอย่าง test_post_raw_sensitivity_boost raw s=0112 boost=3199

รูปที่ 66 test_post_raw_sensitivity_boost raw plot means example

รูปที่ 67 ตัวอย่าง test_post_raw_sensitivity_boost YUV s=0112 boost=3199

รูปที่ 68. test_post_raw_sensitivity_boost YUV s=0448 boost=0800 example

รูปที่ 69. test_post_raw_sensitivity_boost YUV s=0896 boost=0400 example

รูปที่ 70 test_post_raw_sensitivity_boost YUV s=1792 boost=0200 example

รูปที่ 71. ตัวอย่าง test_post_raw_sensitivity_boost YUV s=3585 boost=0100

รูปที่ 72. test_post_raw_sensitivity_boost_yuv_plot_means

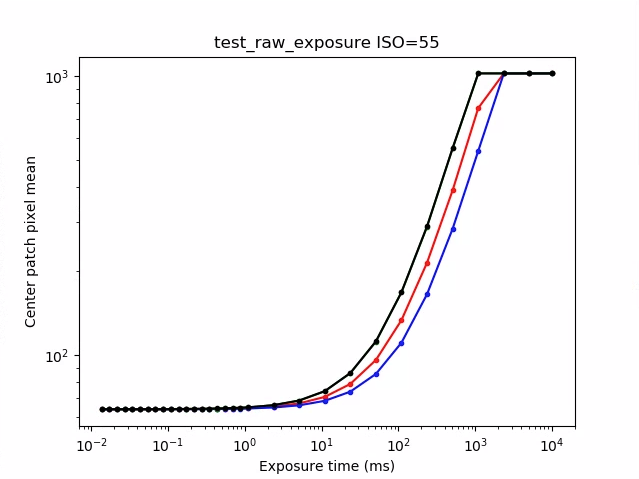

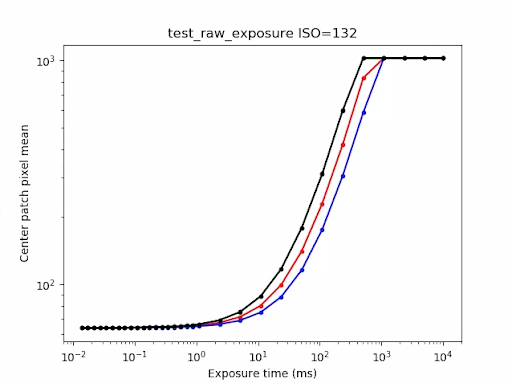

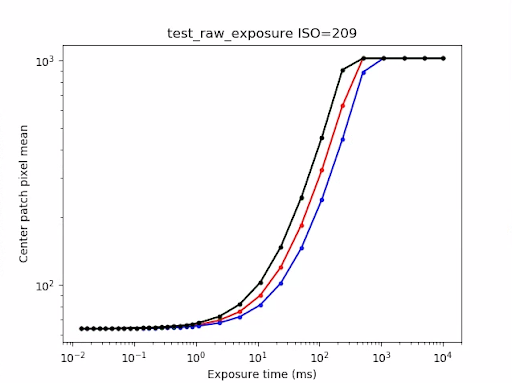

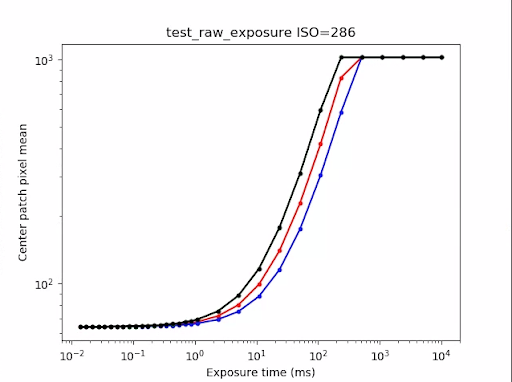

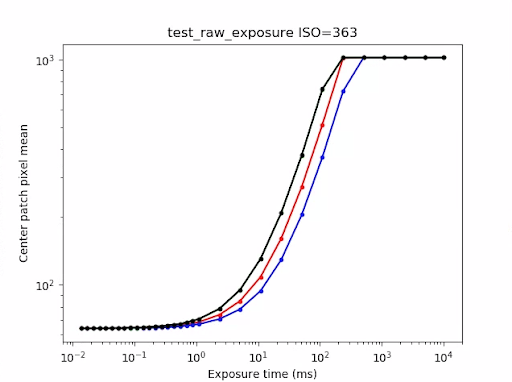

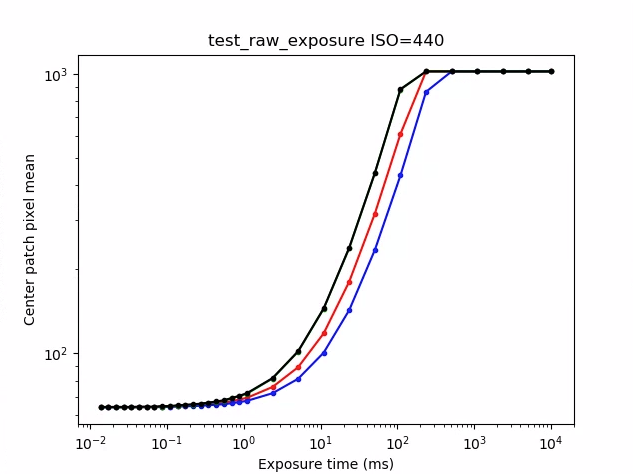

test_raw_exposure

บันทึกชุดรูปภาพ RAW ที่มีเวลาเปิดรับแสงเพิ่มขึ้นและวัดค่าพิกเซล

API ที่ทดสอบ:

android.hardware.camera2.CameraMetadata#REQUEST_AVAILABLE_CAPABILITIES_RAWandroid.hardware.camera2.CaptureRequest#SENSOR_EXPOSURE_TIME

ผ่าน: การเพิ่ม ISO (เกน) จะทำให้พิกเซลมีความไวต่อแสงมากขึ้น ดังนั้นพล็อตจึงเลื่อนไปทางซ้าย

รูปที่ 73 ตัวอย่าง ISO=55 ของ test_raw_exposure

10⁰ คือ 1 มิลลิวินาที, 10¹ คือ 10 มิลลิวินาที และ 10⁻¹ คือ 0.1 มิลลิวินาที

รูปที่ 74 ตัวอย่าง test_raw_exposure ISO=132

รูปที่ 75 ตัวอย่าง test_raw_exposure ISO=209

รูปที่ 76. ตัวอย่าง ISO ของ test_raw_exposure=286

รูปที่ 77. ตัวอย่าง ISO=363 ของ test_raw_exposure

รูปที่ 78. ตัวอย่าง test_raw_exposure ISO=440

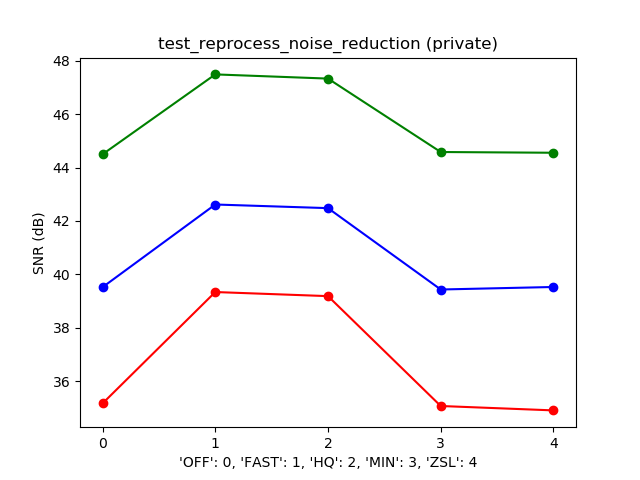

test_reprocess_noise_reduction

การทดสอบที่ใช้กับคำขอประมวลผลซ้ำandroid.noiseReduction.mode

จับภาพที่ประมวลผลซ้ำด้วยกล้องที่มีแสงสลัว ใช้เกนแอนะล็อกสูง

เพื่อยืนยันว่ารูปภาพที่จับภาพมีสัญญาณรบกวน ถ่ายภาพที่ประมวลผลใหม่ 3 ภาพ

สำหรับปิด NR, คุณภาพสูง และรวดเร็ว บันทึกรูปภาพที่ประมวลผลซ้ำโดยมีเกนต่ำ

และปิด NR แล้วใช้ความแปรปรวนของรูปภาพนี้เป็นพื้นฐาน

API ที่ทดสอบ:

ผ่าน: FAST >= OFF, HQ >= FAST และ HQ >> OFF

รูปที่ 79 ตัวอย่างพล็อต SNR ทั่วไปเทียบกับโหมด NR

test_tonemap_sequence

ทดสอบลำดับช็อตด้วยเส้นโค้งการแมปโทนที่แตกต่างกัน ถ่ายภาพด้วยการตั้งค่าด้วยตนเอง 3 ภาพ พร้อมการแมปโทนแบบเส้น ถ่ายภาพด้วยตนเอง 3 ภาพโดยใช้การจับคู่โทนสีเริ่มต้น คำนวณ เดลต้าระหว่างคู่เฟรมที่ต่อเนื่องกันแต่ละคู่

API ที่ทดสอบ:

ผ่าน: มีเฟรมที่เหมือนกัน 3 เฟรม ตามด้วยเฟรมที่เหมือนกัน 3 เฟรมอีกชุดหนึ่ง

รูปที่ 80. ตัวอย่าง test_tonemap_sequence i=0

รูปที่ 81. ตัวอย่าง test_tonemap_sequence i=1

รูปที่ 82. ตัวอย่าง test_tonemap_sequence i=2

รูปที่ 83 ตัวอย่าง test_tonemap_sequence i=3

รูปที่ 84 ตัวอย่าง test_tonemap_sequence i=4

รูปที่ 85 ตัวอย่าง test_tonemap_sequence i=5

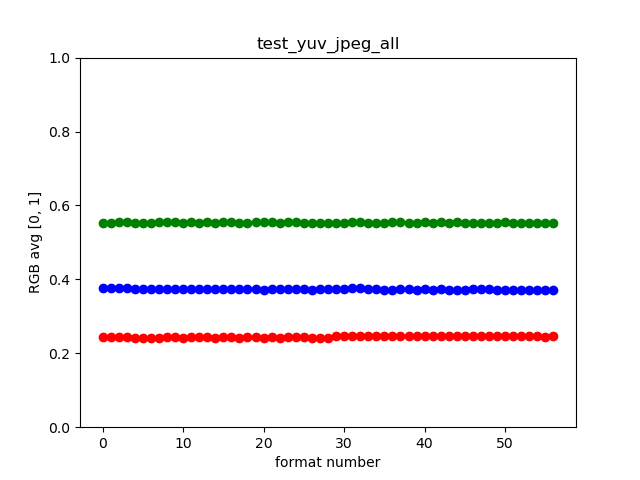

test_yuv_jpeg_all

ทดสอบว่าขนาดและรูปแบบทั้งหมดที่รายงานสำหรับการจับภาพทำงานได้ ใช้คำขอที่กำหนดเอง

พร้อมการทำโทนแมปเชิงเส้นเพื่อให้ YUV และ JPEG มีลักษณะเหมือนกันเมื่อ

แปลงโดยโมดูล image_processing_utils ระบบจะไม่บันทึกรูปภาพโดยค่าเริ่มต้น แต่จะบันทึกได้โดยการเปิดใช้debug_mode

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#TONEMAP_CURVEandroid.hardware.camera2.CaptureRequest#TONEMAP_MODEandroid.graphics.ImageFormat#JPEG

ผ่าน: จุดกึ่งกลางของรูปภาพทั้งหมดมีความแตกต่างของค่าเฉลี่ยความคลาดเคลื่อนกำลังสอง (RMS) สูงสุด (ค่าของสัญญาณ) ในรูปภาพ RGB ที่แปลงแล้ว โดยมีรูปภาพ YUV ที่มีความละเอียดสูงสุด 3%

รูปที่ 86 ตัวอย่าง test_yuv_jpeg_all

test_yuv_plus_dng

ทดสอบว่าขนาดและรูปแบบที่รายงานสำหรับการจับภาพใช้งานได้

API ที่ทดสอบ:

ผ่าน: การทดสอบเสร็จสมบูรณ์และแสดงรูปภาพที่ขอ

รูปที่ 87. ตัวอย่าง test_yuv_plus_dng

scene1_3

scene 1_3 เป็นสำเนาของ scene 1_1 ที่มีฟังก์ชันการทำงานเหมือนกันทุกประการ โดยใช้โครงสร้างฉากย่อยเพื่อลดระยะเวลาที่ยาวนานของ scene 1

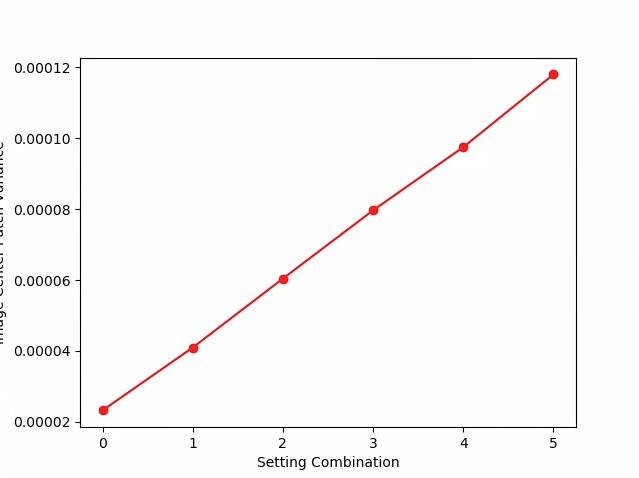

test_capture_result

การทดสอบที่ข้อมูลที่ถูกต้องจะกลับมาในออบเจ็กต์ CaptureResult การทดสอบ

ประกอบด้วยการจับภาพอัตโนมัติ การจับภาพด้วยตนเอง และการจับภาพอัตโนมัติครั้งที่ 2

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#CONTROL_AE_MODEandroid.hardware.camera2.CaptureRequest#CONTROL_AE_REGIONSandroid.hardware.camera2.CaptureRequest#CONTROL_AF_MODEandroid.hardware.camera2.CaptureRequest#CONTROL_AF_REGIONSandroid.hardware.camera2.CaptureRequest#CONTROL_AWB_MODEandroid.hardware.camera2.CaptureRequest#CONTROL_AWB_REGIONSandroid.hardware.camera2.CaptureRequest#CONTROL_MODEandroid.hardware.camera2.CaptureRequest#COLOR_CORRECTION_GAINSandroid.hardware.camera2.CaptureRequest#COLOR_CORRECTION_TRANSFORMandroid.hardware.camera2.CaptureRequest#COLOR_CORRECTION_MODEandroid.hardware.camera2.CaptureRequest#SENSOR_EXPOSURE_TIMEandroid.hardware.camera2.CaptureRequest#SENSOR_SENSITIVITYandroid.hardware.camera2.CaptureResult#STATISTICS_LENS_SHADING_CORRECTION_MAPandroid.hardware.camera2.CaptureRequest#STATISTICS_LENS_SHADING_MAP_MODEandroid.hardware.camera2.CaptureRequest#TONEMAP_CURVEandroid.hardware.camera2.CaptureRequest#TONEMAP_MODE

ผ่าน: ข้อมูลเมตาใช้ได้กับการจับภาพทั้งหมด และการตั้งค่าด้วยตนเองจะไม่รั่วไหล ไปยังการจับภาพอัตโนมัติครั้งที่ 2 กำหนดการแก้ไขการแรเงาของเลนส์สำหรับการ จับภาพ

รูปที่ 88. test_capture_result_plot_lsc_auto_ch0

test_dng_noise_model

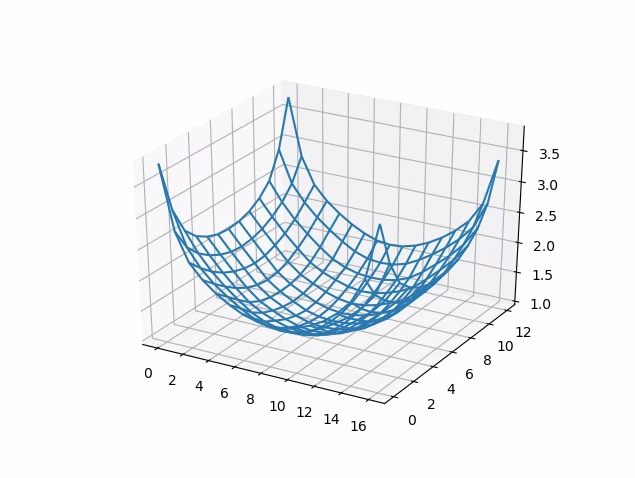

ตรวจสอบว่าพารามิเตอร์โมเดล RAW ของ DNG ถูกต้อง พล็อตแสดงความแปรปรวนที่วัดได้ของแพตช์ตรงกลางของการ์ดสีเทาในภาพดิบที่ถ่ายในช่วงความไวต่างๆ และเปรียบเทียบค่าเหล่านี้กับความแปรปรวนที่คาดไว้ที่ความไวแต่ละระดับโดยโมเดลสัญญาณรบกวน DNG ใน HAL ของกล้อง (อิงตามพารามิเตอร์ O,S ที่แสดงในออบเจ็กต์ผลลัพธ์การจับภาพ) ดูรายละเอียดเพิ่มเติม เกี่ยวกับโมเดลสัญญาณรบกวน DNG ได้โดยดาวน์โหลดเอกสารต่อไปนี้ใน โมเดลสัญญาณรบกวน DNG

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#SENSOR_INFO_SENSITIVITY_RANGEandroid.hardware.camera2.CameraCharacteristics#SENSOR_INFO_WHITE_LEVELandroid.hardware.camera2.CameraCharacteristics#SENSOR_MAX_ANALOG_SENSITIVITYandroid.hardware.camera2.CaptureResult#SENSOR_NOISE_PROFILEandroid.hardware.camera2.CaptureRequest#SENSOR_SENSITIVITY

ผ่าน: พารามิเตอร์โมเดล RAW ของ DNG ถูกต้อง ค่า RGB ที่คาดไว้ตรงกับค่า RGB จริงที่วัดได้

รูปที่ 89. test_dng_noise_model_plog

test_jpeg

การทดสอบที่แปลงรูปภาพ YUV และรูปภาพ JPEG ของอุปกรณ์จะมีลักษณะเหมือนกัน การทดสอบจะใช้ ส่วนกลาง 10% ของรูปภาพและคำนวณค่า RGB แล้วตรวจสอบว่าค่าเหล่านั้น ตรงกัน

API ที่ทดสอบ:

ผ่าน: ความแตกต่างของ RGB โดยเฉลี่ยระหว่างแต่ละรูปภาพน้อยกว่า 3%

รูปที่ 90 test_jpeg_fmt=jpg.jpg

รูปที่ 91. test_jpeg=fmt=yuv.jpg

test_raw_burst_sensitivity

บันทึกชุดรูปภาพ RAW ที่มีค่าเกนเพิ่มขึ้นและวัดสัญญาณรบกวน จับภาพเฉพาะไฟล์ RAW ในโหมดถ่ายภาพต่อเนื่อง

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#SENSOR_INFO_ACTIVE_ARRAY_SIZEandroid.hardware.camera2.CameraCharacteristics#SENSOR_INFO_SENSITIVITY_RANGEandroid.hardware.camera2.CameraCharacteristics#SENSOR_INFO_WHITE_LEVELandroid.hardware.camera2.CameraCharacteristics#SENSOR_MAX_ANALOG_SENSITIVITYandroid.hardware.camera2.CameraMetadata#REQUEST_AVAILABLE_CAPABILITIES_RAW

ผ่าน: ภาพแต่ละภาพมีสัญญาณรบกวนมากกว่าภาพก่อนหน้า เนื่องจากมีการเพิ่มค่าเกน

ใช้ความแปรปรวนของเซลล์ตารางสถิติส่วนกลาง

รูปที่ 92. test_raw_burst_sensitivity_variance

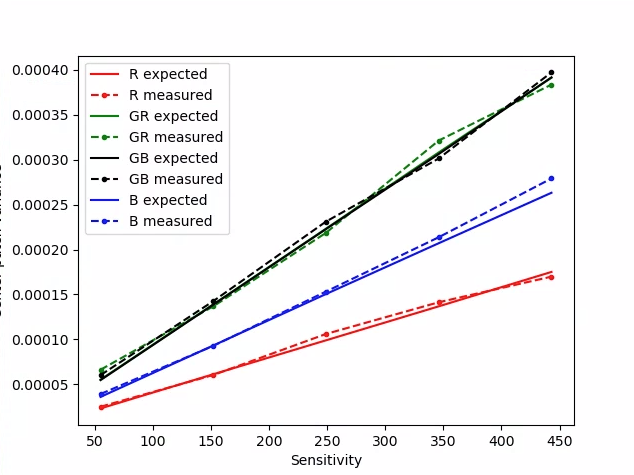

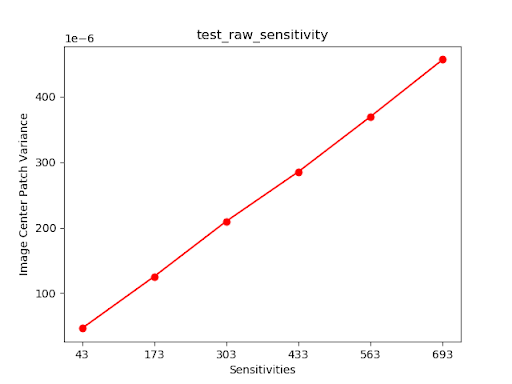

test_raw_sensitivity

บันทึกชุดรูปภาพ RAW ที่มีความไวเพิ่มขึ้นและวัด สัญญาณรบกวน (ความแปรปรวน) ในส่วนกลาง 10% ของรูปภาพ การทดสอบที่แต่ละช็อตมีสัญญาณรบกวนมากกว่าช็อตก่อนหน้า

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#SENSOR_INFO_PRE_CORRECTION_ACTIVE_ARRAY_SIZEandroid.hardware.camera2.CameraCharacteristics#SENSOR_INFO_SENSITIVITY_RANGEandroid.hardware.camera2.CameraCharacteristics#SENSOR_INFO_WHITE_LEVELandroid.hardware.camera2.CameraCharacteristics#SENSOR_MAX_ANALOG_SENSITIVITYandroid.hardware.camera2.CameraMetadata#REQUEST_AVAILABLE_CAPABILITIES_RAW

ผ่าน: ความแปรปรวนจะเพิ่มขึ้นตามการยิงแต่ละครั้ง

รูปที่ 93. test_raw_sensitivity_variance

test_yuv_plus_jpeg

ทดสอบการจับภาพเฟรมเดียวเป็นเอาต์พุตทั้ง YUV และ JPEG ใช้คำขอที่กำหนดเอง

พร้อมการทำโทนแมปเชิงเส้นเพื่อให้ YUV และ JPEG มีลักษณะเหมือนกันเมื่อ

แปลงโดยโมดูล image_processing_utils

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#TONEMAP_CURVEandroid.hardware.camera2.CaptureRequest#TONEMAP_MODEandroid.graphics.ImageFormat#JPEG

ผ่าน: รูปภาพ YUV และ JPEG มีความคล้ายคลึงกันและมีค่า RMS (ค่าของสัญญาณ) แตกต่างกันน้อยกว่า 1%

รูปที่ 94. test_yuv_plus_jpeg ในรูปแบบ JPEG

รูปที่ 95. test_yuv_plus_jpeg ที่มีรูปแบบ YUV

test_yuv_plus_raw

ทดสอบการจับภาพเฟรมเดียวเป็นทั้งเอาต์พุต RAW (RAW 10 บิตและ 12 บิต) และ YUV หากรองรับ

ใช้คำขอที่สร้างขึ้นด้วยตนเองที่มีการแมปโทนเชิงเส้น ดังนั้นจึงคาดว่ารูปแบบ RAW และ YUV จะเหมือนกัน เปรียบเทียบค่า RGB ที่กึ่งกลางของรูปภาพที่แปลงเป็น RGB

10% บันทึกandroid.shading.mode

API ที่ทดสอบ:

android.hardware.camera2.CameraMetadata#REQUEST_AVAILABLE_CAPABILITIES_RAWandroid.hardware.camera2.CaptureResult#STATISTICS_LENS_SHADING_CORRECTION_MAPandroid.hardware.camera2.CaptureRequest#COLOR_CORRECTION_MODEandroid.hardware.camera2.CaptureRequest#COLOR_CORRECTION_GAINSandroid.hardware.camera2.CaptureRequest#COLOR_CORRECTION_TRANSFORMandroid.hardware.camera2.CaptureRequest#CONTROL_AWB_MODEandroid.hardware.camera2.CaptureRequest#CONTROL_MODEandroid.hardware.camera2.CaptureRequest#SHADING_MODEandroid.hardware.camera2.CaptureRequest#TONEMAP_CURVEandroid.hardware.camera2.CaptureRequest#TONEMAP_MODEandroid.hardware.graphics.ImageFormat#RAW10android.hardware.graphics.ImageFormat#RAW12

ผ่าน: รูปภาพ YUV และรูปภาพดิบมีความคล้ายคลึงกันและมีค่า RMS (ค่ารูทมีนสแควร์ของสัญญาณ) แตกต่างกันน้อยกว่า 3.5%

รูปที่ 96. test_yuv_plus_raw_shading=1_raw.jpg

รูปที่ 97. test_yuv_plus_raw_shading=1_yuv.jpg

test_sensitivity_priority

ทดสอบ CONTROL_AE_PRIORITY_MODE_SENSOR_SENSITIVITY_PRIORITY

ในการตั้งค่า ISO ต่างๆ เพื่อยืนยันความสัมพันธ์ระหว่าง ISO ที่สูงขึ้นกับ

ระดับสัญญาณรบกวนที่เพิ่มขึ้น

API ที่ทดสอบ:

android.hardware.camera2.CameraMetadata#CONTROL_AE_PRIORITY_MODE_SENSOR_SENSITIVITY_PRIORITYandroid.hardware.camera2.CaptureRequest#SENSOR_SENSITIVITYandroid.hardware.camera2.CaptureResult#SENSOR_SENSITIVITYandroid.hardware.camera2.CaptureRequest#CONTROL_AE_PRIORITY_MODEandroid.hardware.camera2.CaptureResult#CONTROL_AE_PRIORITY_MODEandroid.hardware.camera2.CameraCharacteristics#SENSOR_INFO_SENSITIVITY_RANGEandroid.hardware.camera2.CaptureRequest#CONTROL_AE_MODEandroid.hardware.camera2.CaptureResult#CONTROL_AE_MODEandroid.hardware.camera2.CameraMetadata#CONTROL_AE_MODE_ONandroid.hardware.camera2.CameraCharacteristics#CONTROL_AE_AVAILABLE_PRIORITY_MODES

ผ่าน: ISO ที่สูงขึ้นจะทำให้ระดับสัญญาณรบกวนเพิ่มขึ้น

เกณฑ์การข้ามการทดสอบ

ระบบจะข้ามการทดสอบ test_sensitivity_priority.py หากเป็นไปตามเกณฑ์ต่อไปนี้

- อุปกรณ์มีระดับ API แรก (

first_api_level) เป็น 35 หรือต่ำกว่า - อุปกรณ์ไม่โฆษณา

CONTROL_AE_PRIORITY_MODE_SENSOR_SENSITIVITY_PRIORITYในCONTROL_AE_AVAILABLE_PRIORITY_MODES

test_exposure_time_priority

การทดสอบ CONTROL_AE_PRIORITY_MODE_SENSOR_EXPOSURE_TIME_PRIORITY

ในเวลาเปิดรับแสงต่างๆ เพื่อตรวจสอบความสว่างที่คงที่ในช่วง

ที่ ISO สามารถชดเชยได้

API ที่ทดสอบ:

android.hardware.camera2.CameraMetadata#CONTROL_AE_PRIORITY_MODE_SENSOR_EXPOSURE_TIME_PRIORITYandroid.hardware.camera2.CaptureRequest#SENSOR_EXPOSURE_TIMEandroid.hardware.camera2.CaptureResult#SENSOR_EXPOSURE_TIMEandroid.hardware.camera2.CaptureRequest#CONTROL_AE_PRIORITY_MODEandroid.hardware.camera2.CaptureResult#CONTROL_AE_PRIORITY_MODEandroid.hardware.camera2.CameraCharacteristics#SENSOR_INFO_SENSITIVITY_RANGEandroid.hardware.camera2.CaptureResult#SENSOR_SENSITIVITYandroid.hardware.camera2.CaptureRequest#CONTROL_AE_MODEandroid.hardware.camera2.CaptureResult#CONTROL_AE_MODEandroid.hardware.camera2.CameraMetadata#CONTROL_AE_MODE_ONandroid.hardware.camera2.CameraCharacteristics#CONTROL_AE_AVAILABLE_PRIORITY_MODES

ผ่าน: ความสว่างคงที่ (อยู่ในค่าความคลาดเคลื่อน) ในช่วงเวลาการเปิดรับแสง หาก ISO อยู่ในช่วงการชดเชย

เกณฑ์การข้ามการทดสอบ

ระบบจะข้ามการทดสอบ test_exposure_time_priority หากเป็นไปตามเกณฑ์ต่อไปนี้

- อุปกรณ์มีระดับ API แรก (

first_api_level) เป็น 35 หรือต่ำกว่า - อุปกรณ์ไม่โฆษณา

CONTROL_AE_PRIORITY_MODE_SENSOR_EXPOSURE_TIME_PRIORITYในCONTROL_AE_AVAILABLE_PRIORITY_MODES

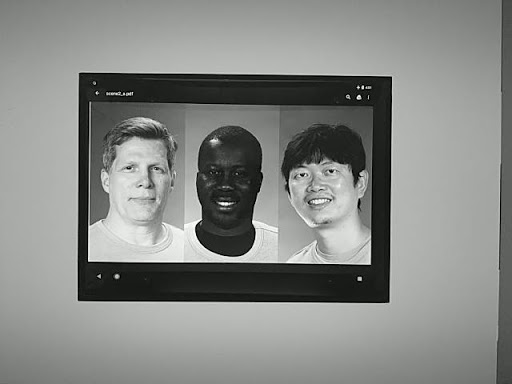

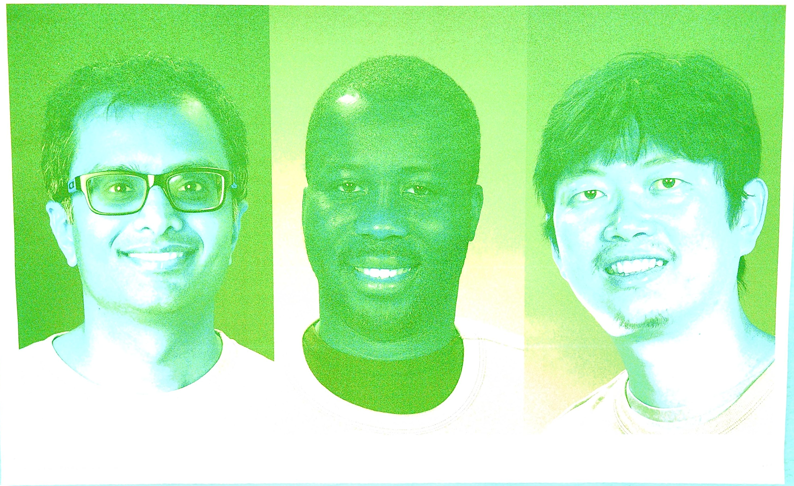

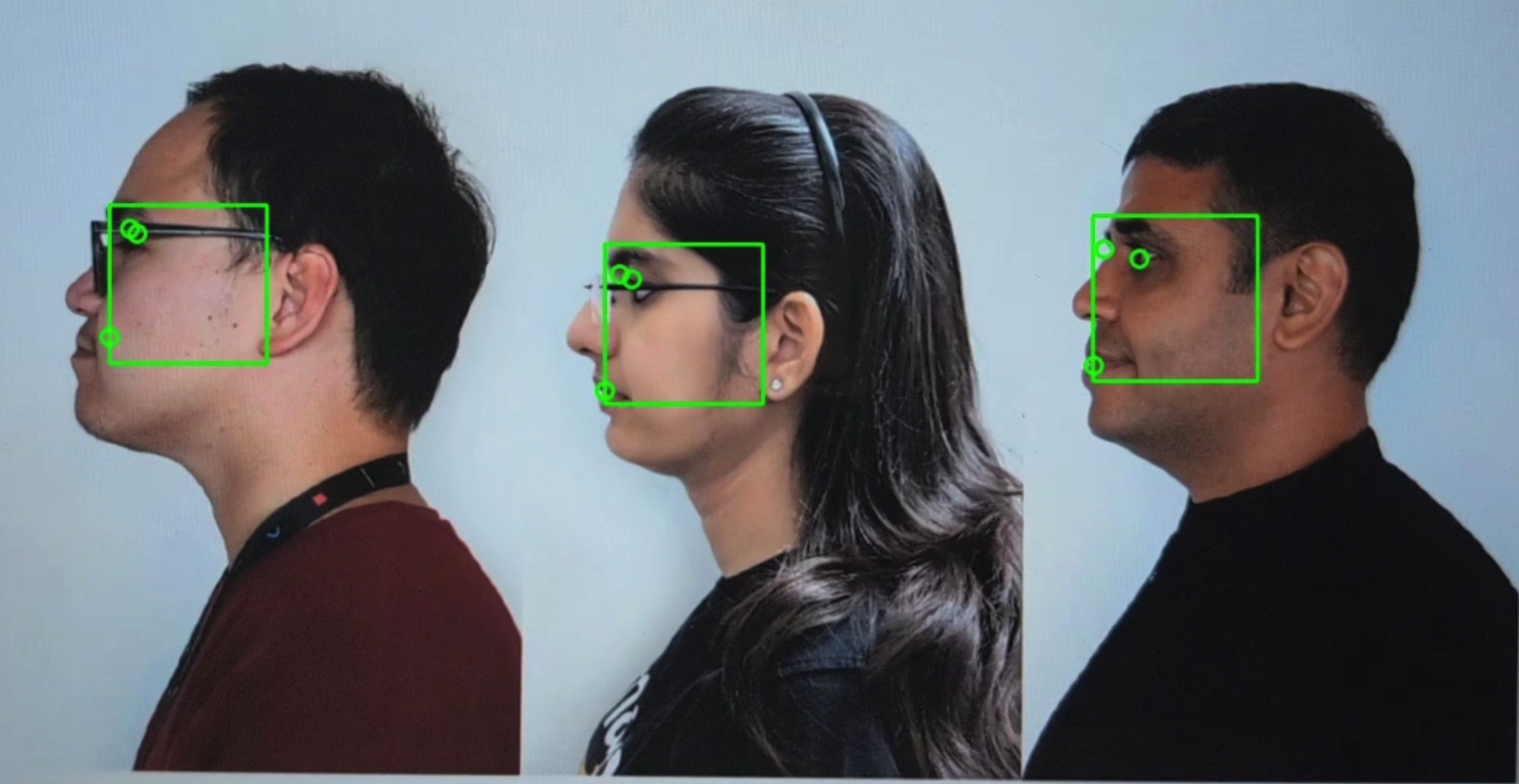

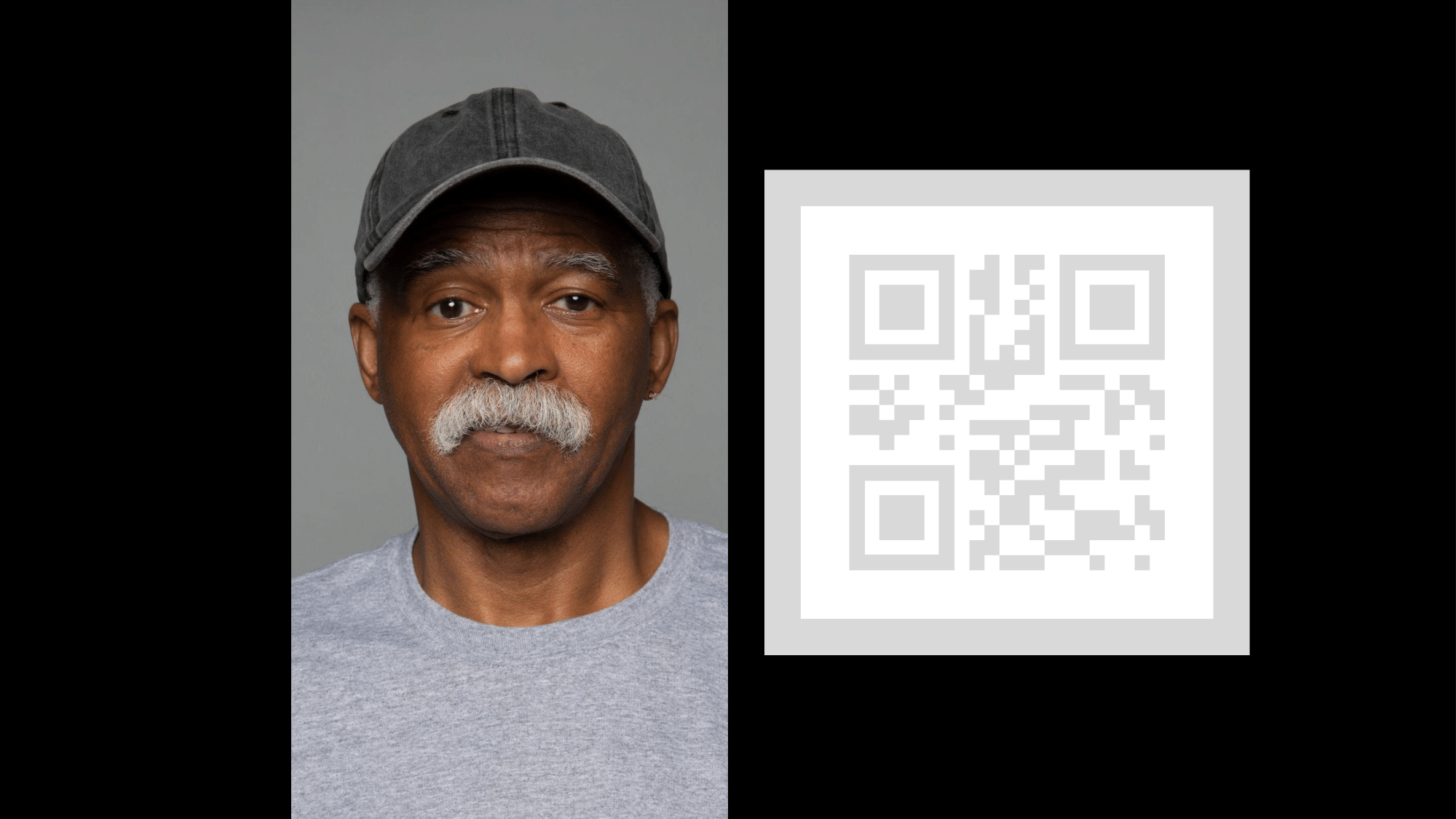

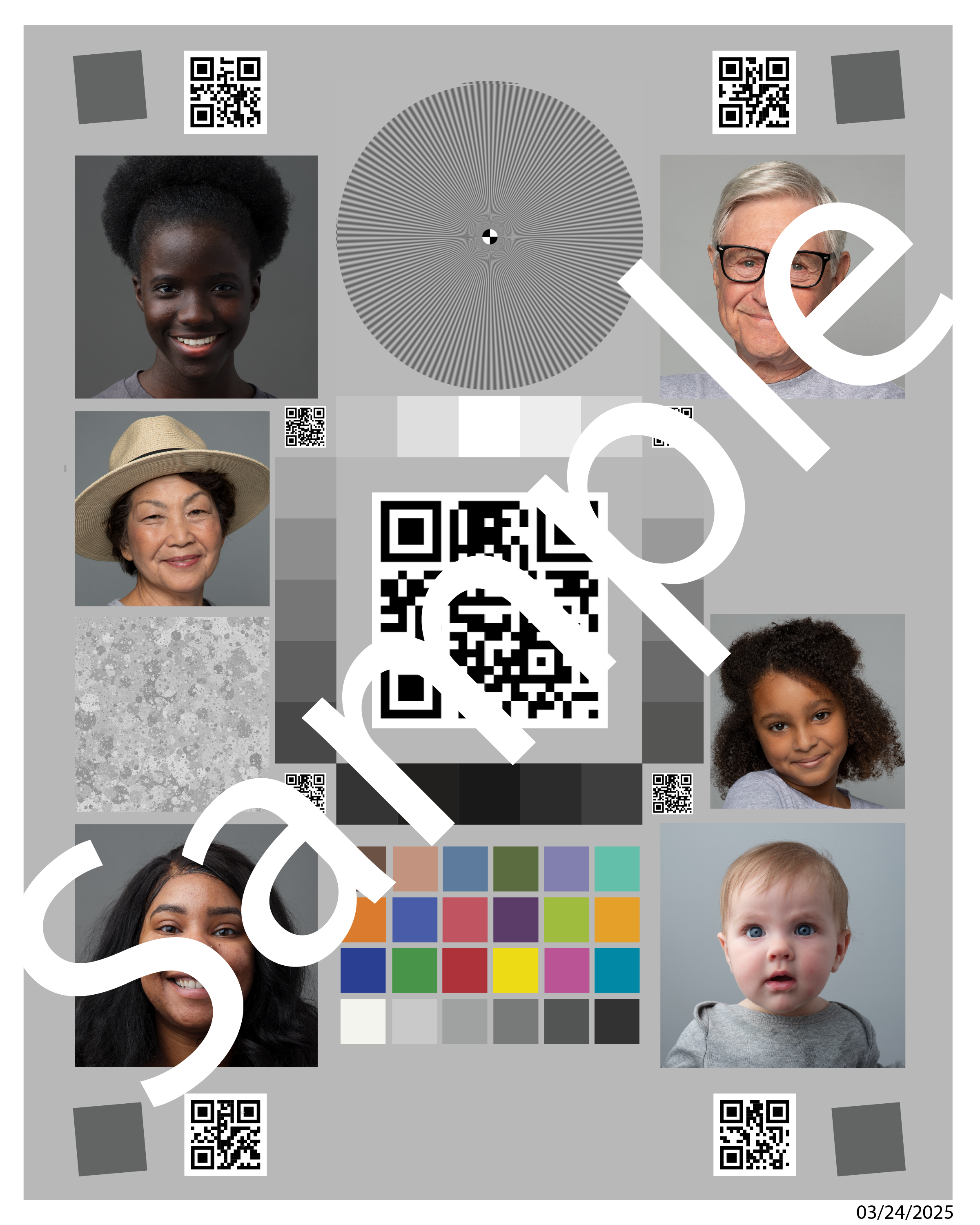

scene2_a

scene2_a มี 3 หน้าพร้อมพื้นหลังสีเทาและเสื้อผ้าสีกลาง โดยเราเลือกใบหน้าที่มีสีผิวหลากหลาย แผนภูมิจะต้องมี

การวางแนวที่ถูกต้องเพื่อให้การตรวจจับใบหน้าทำงานได้อย่างเหมาะสมที่สุด

รูปที่ 98 ตัวอย่าง scene2_a

test_autoframing

ทดสอบลักษณะการทำงานของการจัดเฟรมอัตโนมัติของอุปกรณ์กล้อง ซูมภาพมากจนมองไม่เห็นใบหน้าใดๆ ในฉาก เปิดใช้โหมดการจัดเฟรมอัตโนมัติโดยตั้งค่า AUTOFRAMING ใน CaptureRequest เป็น True และตรวจสอบว่าระบบตรวจจับใบหน้าทั้งหมดในฉากต้นฉบับได้หรือไม่เมื่อสถานะบรรจบกัน (กล่าวคือ เมื่อตั้งค่า AUTOFRAMING_STATE ใน CaptureResult เป็น AUTOFRAMING_STATE_CONVERGED)

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#CONTROL_AUTOFRAMING_AVAILABLEandroid.hardware.camera2.CaptureRequest#CONTROL_AUTOFRAMINGandroid.hardware.camera2.CaptureResult#CONTROL_AUTOFRAMINGandroid.hardware.camera2.CaptureResult#CONTROL_AUTOFRAMING_STATE

ผ่าน: ตรวจพบใบหน้าทั้ง 3

test_display_p3

การทดสอบ

Display P3

บันทึกในรูปแบบ JPEG โดยใช้ ColorSpaceProfiles API ทดสอบว่า JPEG ที่แคปเจอร์มี

โปรไฟล์ ICC ที่เหมาะสม

ในส่วนหัว และรูปภาพมีสีที่อยู่นอกขอบเขตสี sRGB

API ที่ทดสอบ:

android.hardware.camera2.params.ColorSpaceProfilesandroid.hardware.camera2.params.SessionConfiguration#setColorSpace

ผ่าน: JPEG มีโปรไฟล์ ICC ของ Display P3 และสีที่อยู่นอกขอบเขตสี sRGB

test_effects

จับภาพเฟรมสำหรับเอฟเฟกต์กล้องที่รองรับและตรวจสอบว่าระบบสร้างเอฟเฟกต์อย่างถูกต้องหรือไม่

การทดสอบจะตรวจสอบเฉพาะเอฟเฟกต์ OFF และ MONO แต่จะบันทึกรูปภาพสำหรับ

เอฟเฟกต์ที่รองรับทั้งหมด

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#CONTROL_AVAILABLE_EFFECTSandroid.hardware.camera2.CaptureRequest#CONTROL_EFFECT_MODE

ผ่าน: จับภาพฉากพร้อมเอฟเฟกต์ OFF และภาพขาวดำ

พร้อมเอฟเฟกต์ที่ตั้งค่าเป็น MONO

รูปที่ 99. test_effects_MONO

test_exposure_keys_consistent

การทดสอบนี้จะเปรียบเทียบค่าความสว่างเฉลี่ยของการจับภาพที่เปิดใช้ AE กับการจับภาพที่ปิดใช้ AE ซึ่งใช้พารามิเตอร์การรับแสง (ความไว

เวลาในการรับแสง ระยะเวลาของเฟรม การเพิ่มความไวหลังการประมวลผล RAW) ที่ได้รับใน

CaptureResult

ของการจับภาพที่เปิดใช้ AE

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#SENSOR_SENSITIVITYandroid.hardware.camera2.CaptureRequest#SENSOR_EXPOSURE_TIMEandroid.hardware.camera2.CaptureRequest#SENSOR_FRAME_DURATIONandroid.hardware.camera2.CaptureRequest#CONTROL_POST_RAW_SENSITIVITY_BOOSTandroid.hardware.camera2.CaptureResult#SENSOR_SENSITIVITYandroid.hardware.camera2.CaptureResult#SENSOR_EXPOSURE_TIMEandroid.hardware.camera2.CaptureResult#SENSOR_FRAME_DURATIONandroid.hardware.camera2.CaptureResult#CONTROL_POST_RAW_SENSITIVITY_BOOST

ผ่าน: ความแตกต่างสัมพัทธ์ของความสว่างระหว่างการจับภาพ 2 ครั้งน้อยกว่า 4 เปอร์เซ็นต์

test_format_combos

ทดสอบการผสมผสานรูปแบบเอาต์พุตต่างๆ

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#SCALER_STREAM_CONFIGURATION_MAPandroid.hardware.camera2.params.StreamConfigurationMap#getOutputSizes()android.hardware.camera2.CameraCaptureSession#captureBurst()

ผ่าน: บันทึกการผสมผสานทั้งหมดเรียบร้อยแล้ว

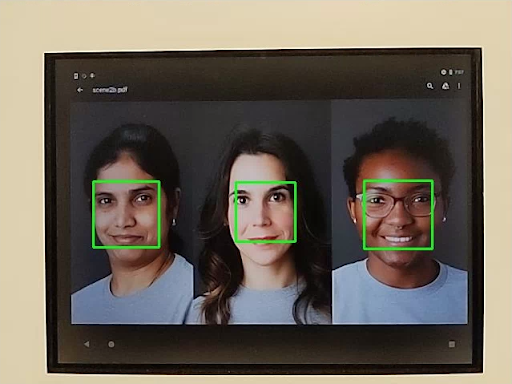

test_num_faces

ทดสอบการตรวจจับใบหน้า

API ที่ทดสอบ:

android.hardware.camera2.CaptureResult#STATISTICS_FACESandroid.hardware.camera2.CaptureResult#STATISTICS_FACE_DETECT_MODE

ผ่าน: ค้นหาใบหน้า 3 ใบ

รูปที่ 100. ตัวอย่างโหมดการตรวจจับใบหน้า test_num_faces 1

test_reprocess_uv_swap

การทดสอบที่การประมวลผล YUV ซ้ำไม่ได้สลับระนาบ U และ V ระบบจะตรวจหาความแตกต่างนี้โดยการคำนวณผลรวมของความแตกต่างสัมบูรณ์ (SAD) ระหว่างรูปภาพที่ประมวลผลซ้ำกับภาพที่ไม่ได้ประมวลผลซ้ำ หากการสลับระนาบ U และ V ของเอาต์พุตในผลลัพธ์การจับภาพที่ประมวลผลซ้ำทำให้ SAD เพิ่มขึ้น ระบบจะถือว่าเอาต์พุตมีระนาบ U และ V ที่ถูกต้อง

API ที่ทดสอบ:

android.hardware.camera2.CameraDevice#createCaptureSessionandroid.hardware.camera2.CameraMetadata#REQUEST_AVAILABLE_CAPABILITIES_YUV_REPROCESSINGandroid.hardware.camera2.CaptureRequest#EDGE_MODEandroid.hardware.camera2.CaptureResult#NOISE_REDUCTION_MODE

ผ่าน: ไม่มีการสลับระนาบ U และ V

รูปที่ 101. ตัวอย่าง test_reprocess_uv_swap

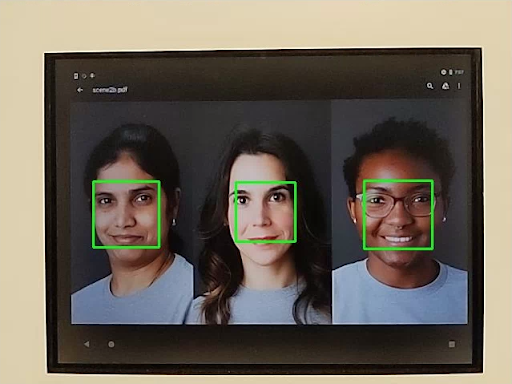

scene2_b

test_preview_num_faces

ทดสอบการตรวจจับใบหน้าในตัวอย่างโดยเพิ่มความหลากหลายของโทนสีผิวในฉากที่มีใบหน้า

API ที่ทดสอบ:

android.hardware.camera2.CaptureResult#STATISTICS_FACESandroid.hardware.camera2.CaptureResult#STATISTICS_FACE_DETECT_MODE

ผ่าน: ค้นหาใบหน้า 3 ใบหน้าที่มีจุดสังเกตใบหน้าในกรอบล้อมรอบใบหน้า

รูปที่ 102. ตัวอย่างโหมดการตรวจจับใบหน้า test_num_faces 1

test_yuv_jpeg_capture_sameness

ถ่ายภาพ 2 ภาพโดยใช้รูปแบบ YUV และ JPEG ทั่วไปที่ใหญ่ที่สุดซึ่งมี

สัดส่วนภาพเดียวกันกับรูปแบบ JPEG ที่ใหญ่ที่สุดซึ่งมีความละเอียดไม่เกิน 1920x1440

ตั้งค่า jpeg.quality เป็น 100 และบันทึกคำขอแบบ 2 พื้นผิว แปลงทั้ง 2 รูปภาพเป็นอาร์เรย์ RGB และคำนวณความแตกต่างของค่าเฉลี่ยกำลังสอง (RMS) แบบ 3 มิติ ระหว่างรูปภาพ 2 รูป

นอกจากนี้ การทดสอบนี้ยังยืนยันว่าเอาต์พุต YUV สำหรับ Use Case ของสตรีมที่รองรับทั้งหมด

มีความคล้ายคลึงกับ YUV ที่มี Use Case STILL_CAPTURE อย่างสมเหตุสมผล

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#SCALER_AVAILABLE_STREAM_USE_CASESandroid.hardware.camera2.CaptureRequest#JPEG_QUALITYandroid.graphics.ImageFormat#JPEG

ผ่าน: รูปภาพ YUV และ JPEG สำหรับกรณีการใช้งาน STILL_CAPTURE มีความแตกต่างของ RMS (ค่ารูทมีนสแควร์ของสัญญาณ) น้อยกว่า 3% รูปภาพ YUV สำหรับกรณีการใช้งานที่รองรับทั้งหมดมีความแตกต่างของ RMS น้อยกว่า 10% จากรูปภาพ YUV ที่มีกรณีการใช้งาน STILL_CAPTURE

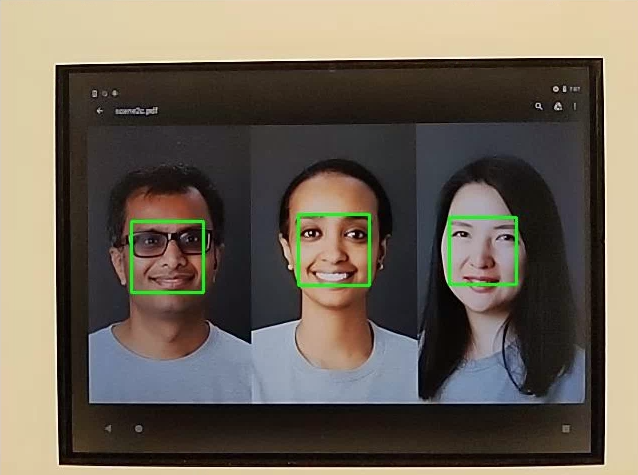

scene2_c

test_num_faces

ทดสอบการตรวจจับใบหน้าด้วยโทนสีผิวที่หลากหลายมากขึ้นในฉากที่มีใบหน้า

API ที่ทดสอบ:

android.hardware.camera2.CaptureResult#STATISTICS_FACESandroid.hardware.camera2.CaptureResult#STATISTICS_FACE_DETECT_MODE

ผ่าน: ค้นหาใบหน้า 3 ใบ

รูปที่ 103 ตัวอย่างโหมดการตรวจจับใบหน้า test_num_faces

test_jpeg_capture_perf_class

ทดสอบเวลาในการตอบสนองของการจับภาพ JPEG สำหรับคลาสประสิทธิภาพ S ตามที่ระบุไว้ในส่วน 2.2.7.2 กล้อง ใน CDD

ผ่าน: ต้องมีเวลาในการตอบสนองการจับภาพ JPEG ของ camera2 น้อยกว่า 1,000 มิลลิวินาทีสำหรับความละเอียด 1080p ตามที่วัดโดย Camera PerformanceTest ของ CTS ภายใต้สภาพแสง ITS (3000K) สำหรับกล้องหลักทั้ง 2 ตัว

test_camera_launch_perf_class

ทดสอบเวลาในการตอบสนองของการเปิดกล้องสำหรับคลาสประสิทธิภาพ S ตามที่ระบุไว้ใน ส่วน 2.2.7.2 กล้อง ใน CDD

ผ่าน: ต้องมีเวลาในการตอบสนองเมื่อเริ่มต้น camera2 (เปิดกล้องไปยังเฟรมตัวอย่างแรก) น้อยกว่า 600 มิลลิวินาทีตามที่วัดโดย CTS camera PerformanceTest ภายใต้สภาพแสง ITS (3000K) สำหรับกล้องหลักทั้ง 2 ตัว

test_default_camera_hdr

ทดสอบว่าการจับภาพจากกล้องเริ่มต้นเป็น Ultra HDR เพื่อประสิทธิภาพ คลาส 15 ตามที่ระบุไว้ใน ส่วน 2.2.7.2 กล้อง ของ CDD

ผ่าน: การจับภาพแพ็กเกจกล้องเริ่มต้นต้องเป็น Ultra HDR สำหรับอุปกรณ์ที่มีประสิทธิภาพคลาส 15

scene2_d

test_preview_num_faces

ทดสอบการตรวจจับใบหน้าในตัวอย่างโดยเพิ่มความหลากหลายของโทนสีผิวในฉากที่มีใบหน้า

API ที่ทดสอบ:

android.hardware.camera2.CaptureResult#STATISTICS_FACESandroid.hardware.camera2.CaptureResult#STATISTICS_FACE_DETECT_MODE

ผ่าน: ค้นหาใบหน้า 3 ใบหน้าที่มีจุดสังเกตใบหน้าในกรอบล้อมรอบใบหน้า

scene2_e

test_continuous_picture

ระบบจะจับภาพเฟรมความละเอียด VGA 50 เฟรมโดยใช้การตั้งค่าคำขอการจับภาพครั้งแรก

android.control.afMode = 4 (CONTINUOUS_PICTURE).

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#CONTROL_AF_MODEandroid.hardware.camera2.CaptureResult#CONTROL_AE_STATEandroid.hardware.camera2.CaptureResult#CONTROL_AF_STATEandroid.hardware.camera2.CaptureResult#CONTROL_AWB_STATE

ผ่าน: ระบบ 3A จะปรับค่าภายในสิ้นสุดการจับภาพ 50 เฟรม

test_num_faces

ทดสอบการตรวจจับใบหน้าด้วยโทนสีผิวที่หลากหลายมากขึ้นในฉากที่มีใบหน้า

API ที่ทดสอบ:

android.hardware.camera2.CaptureResult#STATISTICS_FACESandroid.hardware.camera2.CaptureResult#STATISTICS_FACE_DETECT_MODE

ผ่าน: พบใบหน้า 3 ใบ

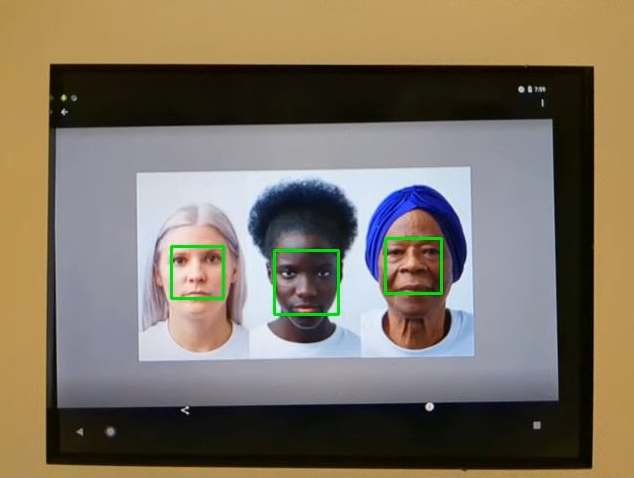

scene2_f

scene2_f มี 3 หน้าโดยมีพื้นหลังสีขาวและเสื้อผ้าสีขาว ใบหน้า

มีโทนสีผิวที่หลากหลายและมีคอนทราสต์สูงกับพื้นหลัง

รูปที่ 104 ตัวอย่าง scene2_f

test_preview_num_faces

ทดสอบการตรวจจับใบหน้าด้วยโทนสีผิวที่หลากหลายมากขึ้นในฉากที่มีใบหน้า

API ที่ทดสอบ:

android.hardware.camera2.CaptureResult#STATISTICS_FACESandroid.hardware.camera2.CaptureResult#STATISTICS_FACE_DETECT_MODE

ผ่าน: ค้นหาใบหน้า 3 ใบหน้าที่มีจุดสังเกตใบหน้าในกรอบล้อมรอบใบหน้า

รูปที่ 105 ตัวอย่าง test_num_faces_fd_mode_1

scene2_g

scene2_g มีภาพใบหน้าโปรไฟล์ 3 ภาพที่มีพื้นหลังสีขาวและเสื้อผ้าสีขาว

ใบหน้ามีโทนสีผิวที่หลากหลายและมีคอนทราสต์สูงกับพื้นหลัง

รูปที่ 106 ตัวอย่าง scene2_g

test_preview_num_faces

ทดสอบการตรวจจับใบหน้าด้วยโทนสีผิวที่หลากหลายมากขึ้นในฉากที่มีใบหน้า

API ที่ทดสอบ:

android.hardware.camera2.CaptureResult#STATISTICS_FACESandroid.hardware.camera2.CaptureResult#STATISTICS_FACE_DETECT_MODE

ผ่าน: ค้นหาใบหน้า 3 ใบหน้าที่มีจุดสังเกตใบหน้าในกรอบล้อมรอบใบหน้า

รูปที่ 107 ตัวอย่าง test_preview_num_faces

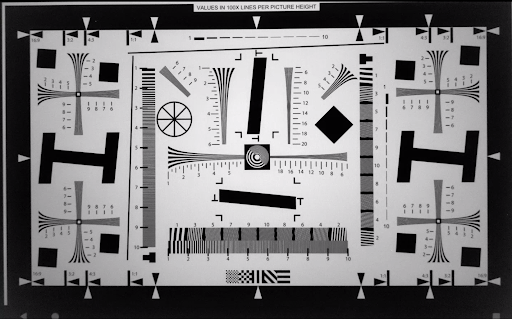

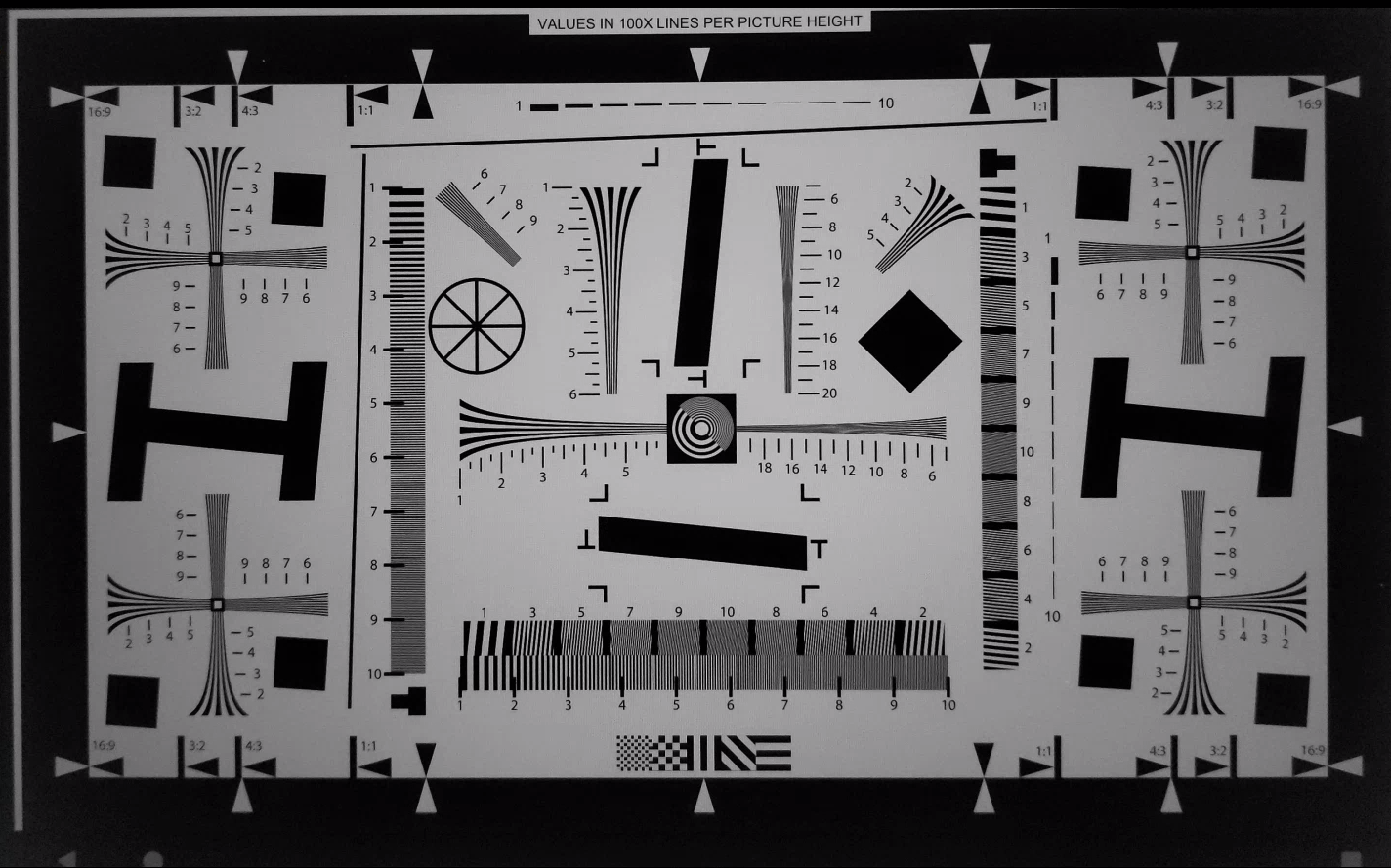

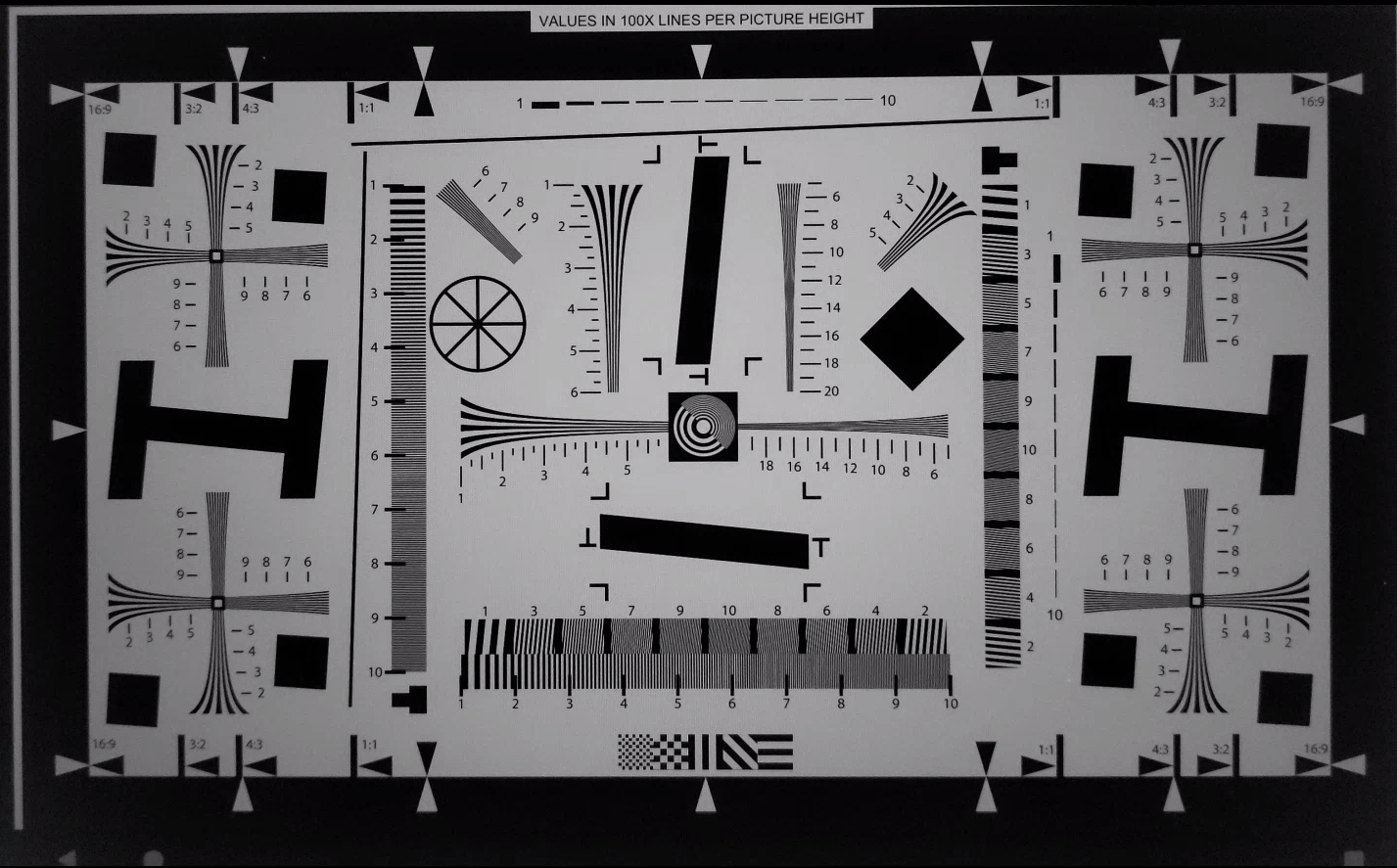

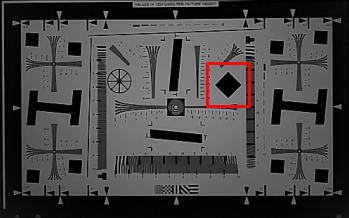

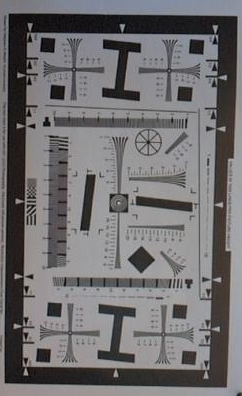

ฉากที่ 3

scene3 ใช้ชาร์ต ISO12233 และการทดสอบส่วนใหญ่ใช้วิธีการแยกชาร์ตเพื่อ

ค้นหาชาร์ตในฉาก ด้วยเหตุนี้ รูปภาพที่บันทึกไว้ส่วนใหญ่จึงไม่มี

ขอบเหมือนรูปภาพสำหรับฉากที่ 1, 2 หรือ 4 แต่มีเพียงแผนภูมิเท่านั้น แผนภูมิต้องอยู่ในแนวนอนที่ถูกต้องเพื่อให้เครื่องมือค้นหาแผนภูมิทำงานได้อย่างมีประสิทธิภาพสูงสุด

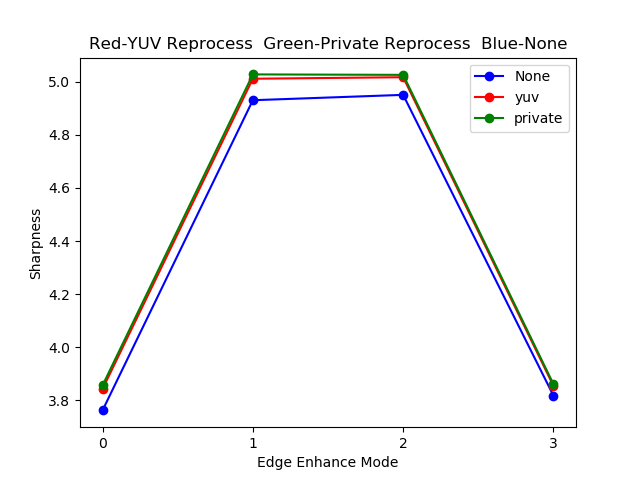

test_edge_enhancement

ทดสอบว่าใช้พารามิเตอร์ android.edge.mode อย่างถูกต้อง จับภาพ

รูปภาพที่ไม่ได้ประมวลผลซ้ำสำหรับโหมดขอบแต่ละโหมด และแสดงความคมชัดของรูปภาพเอาต์พุต

และข้อมูลเมตาของผลลัพธ์การจับภาพ ประมวลผลคำขอการจับภาพด้วย

โหมดขอบ ความไว เวลาเปิดรับแสง ระยะโฟกัส และพารามิเตอร์พื้นผิวเอาต์พุต

ที่ระบุ

ผ่าน: HQ โหมด (2) คมชัดกว่า OFF โหมด (0) FAST โหมด (1) คมชัดกว่าOFF โหมด HQ โหมดคมชัดกว่าหรือเท่ากับ FAST โหมด

API ที่ทดสอบ:

พารามิเตอร์ของกล้องที่ได้รับผลกระทบ

EDGE_MODE

รูปที่ 108. ตัวอย่าง test_edge_enhancement edge=0

รูปที่ 109. ตัวอย่าง test_edge_enhancement edge=1 (โหมดเร็ว)

รูปที่ 110. ตัวอย่างการทดสอบการเพิ่มขอบ edge=2 (โหมดคุณภาพสูง)

test_flip_mirror

ทดสอบว่ารูปภาพวางแนวอย่างถูกต้องตาม 7.5.2 กล้องหน้าใน CDD

รูปภาพที่กลับด้าน พลิก หรือหมุนจะระบุได้ด้วยฟีเจอร์สี่เหลี่ยมข้าวหลามตัด ใกล้กับกึ่งกลาง

ผ่าน: รูปภาพไม่ได้พลิก กลับด้าน หรือหมุน

รูปที่ 111 ตัวอย่างแพตช์ฉาก test_flip_mirror

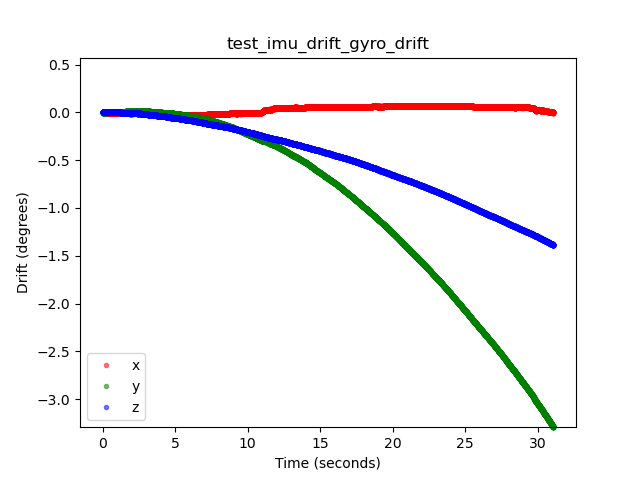

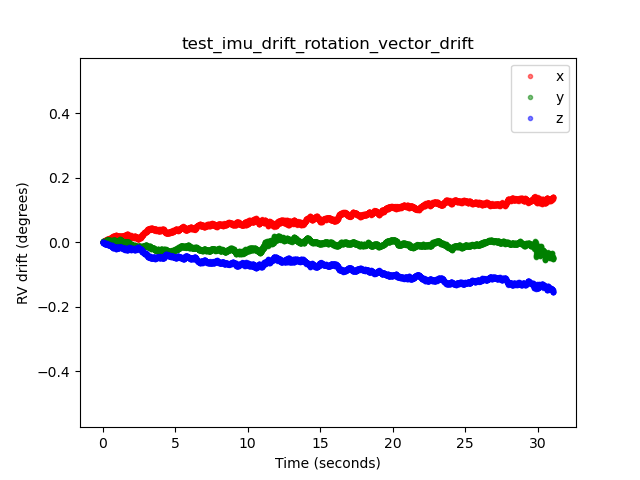

test_imu_drift

ทดสอบว่าหน่วยวัดความเฉื่อย (IMU) มีเอาต์พุตที่เสถียรเป็นเวลา 30 วินาทีหรือไม่ ขณะที่อุปกรณ์อยู่กับที่และบันทึกตัวอย่างความละเอียดสูง

API ที่ทดสอบ:

android.hardware.Sensorandroid.hardware.SensorEventandroid.hardware.Sensor#TYPE_GYROSCOPEandroid.hardware.Sensor#TYPE_ROTATION_VECTOR

บัตร:

- ดริฟต์ของไจโรสโคปน้อยกว่า 0.01 เรเดียนในช่วงเวลาทดสอบ

- ความแปรปรวนของการอ่านค่าไจโรสโคปน้อยกว่า 1E-7 rad2/s2/Hz ในช่วงเวลาทดสอบ

- การดริฟต์ของเวกเตอร์การหมุนน้อยกว่า 0.01 เรเดียนในช่วงเวลาทดสอบ

- (ยังไม่มีข้อกำหนด) การดริฟต์ของไจโรสโคปน้อยกว่า 1 องศา ต่อวินาที

รูปที่ 112. ตัวอย่างการดริฟต์ของไจโรสโคป test_imu_drift

รูปที่ 113. ตัวอย่างการดริฟต์เวกเตอร์การหมุนของ test_imu_drift

test_landscape_to_portrait

ทดสอบว่าการลบล้างจากแนวนอนเป็นแนวตั้งทำงานได้อย่างถูกต้องสำหรับ เซ็นเซอร์ที่วางในแนวนอนหรือไม่

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#SCALER_AVAILABLE_ROTATE_AND_CROP_MODESandroid.hardware.camera2.CameraCharacteristics#SENSOR_ORIENTATIONandroid.hardware.camera2.CameraCharacteristics#getCameraCharacteristics

ผ่าน: การทดสอบจะค้นหาแผนภูมิที่มีการหมุนตามที่คาดไว้ (0 องศา เมื่อปิดใช้การลบล้างจากแนวนอนเป็นแนวตั้ง และ 90 องศาเมื่อ เปิดใช้)

รูปที่ 114 ตัวอย่าง test_landscape_to_portrait

test_lens_movement_reporting

ทดสอบว่ามีการรายงานแฟล็กการเคลื่อนที่ของเลนส์อย่างถูกต้องหรือไม่ จับภาพต่อเนื่อง 24 ภาพ โดย 12 เฟรมแรกจะอยู่ที่ระยะโฟกัสที่เหมาะสมที่สุด (ตามที่ 3A พบ) และ 12 เฟรมสุดท้ายจะอยู่ที่ระยะโฟกัสต่ำสุด ที่เฟรมประมาณ 12 เลนส์ จะเคลื่อนที่ทำให้ความคมชัดลดลง ความคมชัดจะคงที่ในที่สุดเมื่อ เลนส์เคลื่อนไปยังตำแหน่งสุดท้าย

ควรยืนยันแฟล็กการเคลื่อนที่ของเลนส์ในทุกเฟรมที่ความคมชัด อยู่ระหว่างความคมชัดใน 2-3 เฟรมแรกที่เลนส์อยู่กับที่ ในระยะโฟกัสที่เหมาะสม และ 2-3 เฟรมสุดท้ายที่เลนส์อยู่กับที่ ในระยะโฟกัสต่ำสุด เฟรมที่เลนส์เคลื่อนที่นั้นไม่สำคัญ สิ่งที่สำคัญคือต้องมีการยืนยันแฟล็กการเคลื่อนที่เมื่อเลนส์เคลื่อนที่

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#LENS_INFO_MINIMUM_FOCUS_DISTANCEandroid.hardware.camera2.CaptureResult#LENS_STATEandroid.hardware.camera2.CaptureResult#LENS_FOCUS_DISTANCEandroid.hardware.camera2.CaptureResult#SENSOR_TIMESTAMPandroid.hardware.camera2.CaptureRequest#LENS_FOCUS_DISTANCE

ผ่าน: แฟล็กการเคลื่อนไหวของเลนส์เป็น True ในเฟรมที่มีการเปลี่ยนแปลงความคมชัด

กลไกการทำงานที่ล้มเหลว

lens_moving: True(android.hardware.camera2.CaptureResult#LENS_STATE= 1) ในtest_log.DEBUGจะได้รับการยืนยันในเฟรมที่ความคมชัดไม่เปลี่ยนแปลงเท่านั้น- เฟรมที่มี

lens_moving: False(android.hardware.camera2.CaptureResult#LENS_STATE= 0) ในtest_log.DEBUGมีความคมชัดแตกต่างจาก 2-3 เฟรมแรก ที่ระยะโฟกัสที่เหมาะสมหรือ 2-3 เฟรมสุดท้ายที่ระยะโฟกัสต่ำสุด

test_reprocess_edge_enhancement

ทดสอบว่าวิธีการประมวลผลซ้ำที่รองรับสำหรับการเพิ่มประสิทธิภาพที่ขอบทำงานได้อย่างถูกต้องหรือไม่ ประมวลผลคำขอการจับภาพด้วยโหมด Edge การประมวลผลซ้ำที่ระบุและเปรียบเทียบ โหมดต่างๆ เพื่อจับภาพโดยปิดใช้โหมด Edge การประมวลผลซ้ำ

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#EDGE_MODEandroid.hardware.camera2.CaptureRequest#REPROCESS_EFFECTIVE_EXPOSURE_FACTOR

ผ่าน: ความคมชัดสำหรับโหมดขอบต่างๆ ถูกต้อง HQ (โหมด 2) มีความคมชัด

กว่า OFF (โหมด 0) และการปรับปรุงระหว่างโหมดต่างๆ นั้นคล้ายกัน

รูปที่ 115. ตัวอย่างพล็อต test_reprocess_edge_enhancement

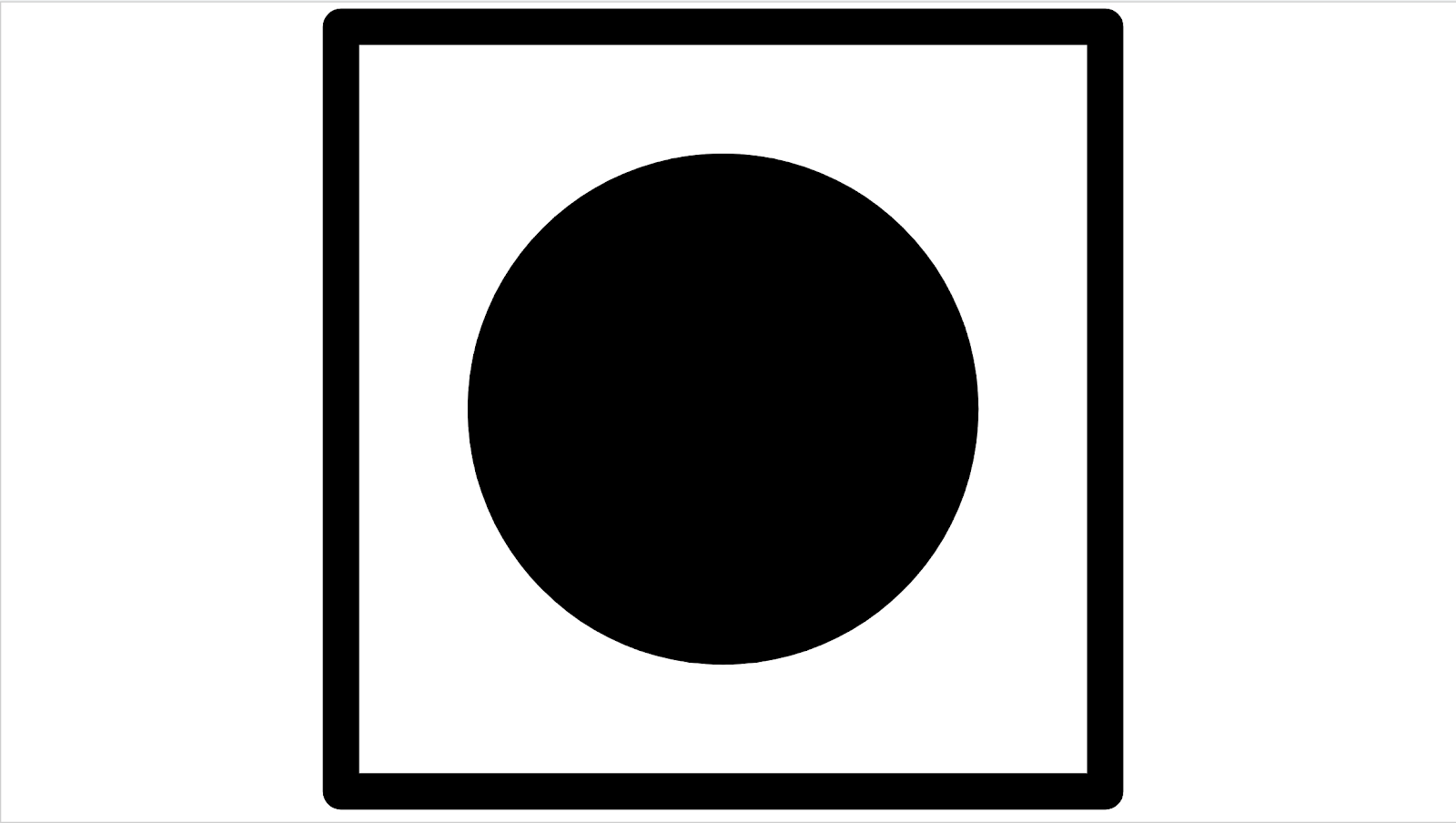

ฉากที่ 4

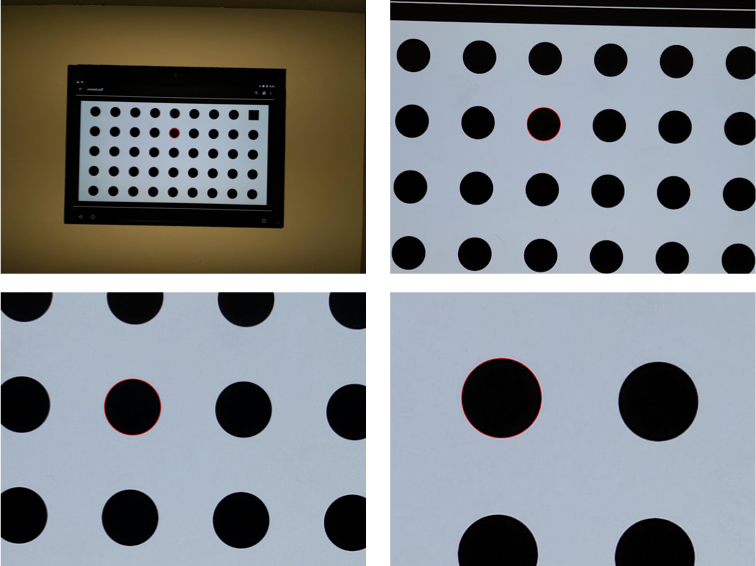

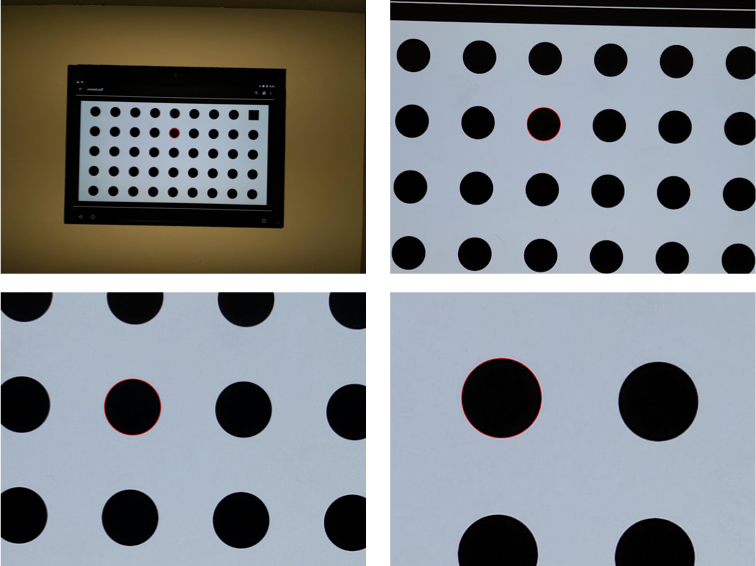

scene4 ประกอบด้วยวงกลมสีดำบนพื้นหลังสีขาวภายในสี่เหลี่ยมจัตุรัส

การทดสอบใน Scene4 อาจมีความไวต่อการจัดแนว ดังนั้นตั้งแต่ Android

15 เป็นต้นไป คุณจะใช้ check_alignment.py ในไดเรกทอรี

เครื่องมือเพื่อเปิดใช้การตรวจสอบการจัดแนว DUT และแผนภูมิได้

รูปที่ 116 ตัวอย่าง scene4

test_30_60fps_preview_fov_match

ทดสอบว่าวิดีโอตัวอย่าง 30 FPS และ 60 FPS มี FoV เดียวกัน การทดสอบจะบันทึกวิดีโอ 2 รายการ โดยรายการหนึ่งมี 30 FPS และอีกรายการมี 60 FPS ระบบจะเลือกเฟรมตัวแทนจากวิดีโอแต่ละรายการและวิเคราะห์เพื่อยืนยัน ว่าการเปลี่ยนแปลง FoV ในวิดีโอทั้ง 2 รายการเป็นไปตามข้อกำหนด ทดสอบว่าสัดส่วนภาพของวงกลมยังคงที่ จุดศูนย์กลางของวงกลมยังคง เสถียร และรัศมีของวงกลมยังคงที่

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#CONTROL_AE_TARGET_FPS_RANGEandroid.hardware.camera2.CaptureRequest#SENSOR_FRAME_DURATIONandroid.hardware.camera2.CaptureRequest#SENSOR_EXPOSURE_TIMEandroid.hardware.camera2.CaptureResult#LENS_DISTORTIONandroid.hardware.camera2.CaptureResult#LENS_FOCAL_LENGTHandroid.hardware.camera2.CaptureResult#LENS_INTRINSIC_CALIBRATION

ผ่าน: รูปภาพไม่ยืดออก จุดกึ่งกลางของรูปภาพไม่แตกต่างกันเกิน 3% และการเปลี่ยนแปลงสัดส่วนภาพสูงสุดระหว่างวิดีโอ 30 FPS กับ 60 FPS ไม่เกิน 7.5%

กลไกการทำงานที่ล้มเหลว

- วงกลมจากวิดีโอ 30 FPS มีขนาดแตกต่างจากวิดีโอ 60 FPS อย่างเห็นได้ชัด

- วงกลมในรูปภาพที่จับภาพไว้จะบิดเบี้ยวเนื่องจากไปป์ไลน์การประมวลผล

- วงกลมในรูปภาพที่บันทึกไว้จะถูกครอบตัดเนื่องจากคำขอจับภาพที่มีสัดส่วนภาพไม่ปกติ ซึ่งจะลดความสูงหรือความกว้างของรูปภาพ

- วงกลมในรูปภาพที่จับภาพมีแสงสะท้อนตรงกลางและดูเหมือนว่าไม่ได้เติมสีจนเต็ม

test_aspect_ratio_and_crop

ทดสอบว่ารูปภาพบิดเบี้ยวหรือถูกครอบตัดโดยไม่คาดคิดในไปป์ไลน์รูปภาพหรือไม่ ถ่ายภาพวงกลมในทุกรูปแบบ ตรวจสอบว่าวงกลมไม่บิดเบี้ยว วงกลมไม่เคลื่อนที่จากกึ่งกลางของรูปภาพ และวงกลมไม่เปลี่ยนขนาดอย่างไม่ถูกต้องเมื่อใช้สัดส่วนภาพหรือความละเอียดที่แตกต่างกัน

API ที่ทดสอบ:

android.hardware.camera2.CaptureResult#LENS_DISTORTIONandroid.hardware.camera2.CaptureResult#LENS_FOCAL_LENGTHandroid.hardware.camera2.CaptureResult#LENS_INTRINSIC_CALIBRATION

ผ่าน: รูปภาพไม่ยืดออก จุดกึ่งกลางของรูปภาพไม่แตกต่างกันเกิน 3% และรักษา FoV ที่เป็นไปได้สูงสุดไว้

กลไกการทำงานที่ล้มเหลว

- กล้องไม่ได้อยู่ในแนวเดียวกับวงกลมที่แสดงบน แท็บเล็ตตรงกลางฉากที่จับภาพ

- วงกลมในรูปภาพที่จับภาพไว้จะบิดเบี้ยวเนื่องจากไปป์ไลน์การประมวลผล

- รูปภาพความละเอียดต่ำจะได้รับการครอบตัดซ้ำในไปป์ไลน์รูปภาพ ซึ่งจะทำให้เกิด FoV ที่แตกต่างกันระหว่างรูปภาพความละเอียดสูงและต่ำ

- วงกลมในรูปภาพที่บันทึกไว้จะถูกครอบตัดเนื่องจากคำขอจับภาพที่มีสัดส่วนภาพไม่ปกติ ซึ่งจะลดความสูงหรือความกว้างของรูปภาพ

- วงกลมในรูปภาพที่จับภาพมีแสงสะท้อนตรงกลางและดูเหมือนว่าไม่ได้เติมสีจนเต็ม

test_multi_camera_alignment

ทดสอบพารามิเตอร์การปรับเทียบกล้องที่เกี่ยวข้องกับการวางตำแหน่งกล้องสำหรับ ระบบกล้องหลายตัว ใช้กล้องย่อยจริงแบบหลายกล้องเพื่อถ่าย รูปด้วยกล้องจริงตัวใดตัวหนึ่ง ค้นหาจุดศูนย์กลางของวงกลม โปรเจ็กต์ จุดศูนย์กลางวงกลมไปยังพิกัดโลกสำหรับกล้องแต่ละตัว เปรียบเทียบความแตกต่าง ระหว่างจุดศูนย์กลางของวงกลมของกล้องในพิกัดโลก ฉายพิกัดโลกกลับไปเป็นพิกัดพิกเซลและเปรียบเทียบกับพิกัดเดิมเพื่อตรวจสอบความถูกต้อง เปรียบเทียบขนาดวงกลมเพื่อตรวจสอบว่าทางยาวโฟกัสของ กล้องแตกต่างกันหรือไม่

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#getPhysicalCameraIds()android.hardware.camera2.CameraCharacteristics#LENS_DISTORTIONandroid.hardware.camera2.CameraCharacteristics#LENS_INFO_AVAILABLE_FOCAL_LENGTHSandroid.hardware.camera2.CameraCharacteristics#LENS_INTRINSIC_CALIBRATIONandroid.hardware.camera2.CameraCharacteristics#LENS_POSE_ROTATIONandroid.hardware.camera2.CameraCharacteristics#LENS_POSE_TRANSLATIONandroid.hardware.camera2.CameraMetadata#REQUEST_AVAILABLE_CAPABILITIES_LOGICAL_MULTI_CAMERAandroid.hardware.camera2.CaptureRequest#SCALER_CROP_REGIONandroid.hardware.camera2.CaptureRequest#DISTORTION_CORRECTION_MODE

ผ่าน: วงกลมมีจุดศูนย์กลางและขนาดตามที่คาดไว้ในรูปภาพที่ฉาย เมื่อเทียบกับรูปภาพที่ถ่ายโดยใช้ข้อมูลการปรับเทียบกล้องและความยาวโฟกัส

กลไกการทำงานที่ล้มเหลว

LENS_INTRINSIC_CALIBRATION,LENS_POSE_TRANSLATIONและLENS_POSE_ROTATIONเป็นค่าการออกแบบ ไม่ใช่ข้อมูลการปรับเทียบจริง- ระบบกล้องไม่เหมาะกับการตั้งค่าการทดสอบ เช่น การทดสอบระบบกล้องมุมกว้างและมุมกว้างพิเศษด้วยแท่นทดสอบ RFoV ดูข้อมูลเพิ่มเติมได้ที่ คำถามที่พบบ่อยเกี่ยวกับ ITS-in-a-box ของกล้อง Q1

test_preview_aspect_ratio_and_crop

คล้ายกับการทดสอบtest_aspect_ratio_and_crop

สำหรับภาพนิ่ง การทดสอบนี้จะตรวจสอบรูปแบบตัวอย่างที่รองรับเพื่อยืนยันว่า

เฟรมตัวอย่างไม่ได้ยืดหรือครอบตัดอย่างไม่เหมาะสม ตรวจสอบว่า สัดส่วนภาพของวงกลมไม่เปลี่ยนแปลง รูปภาพที่ครอบตัดจะคงวงกลมไว้ที่ กึ่งกลางของเฟรม และขนาดวงกลมจะไม่เปลี่ยนแปลงสำหรับรูปแบบคงที่หรือ ความละเอียดที่แตกต่างกัน (การตรวจสอบ FoV)

API ที่ทดสอบ:

android.hardware.camera2.CaptureResult#LENS_DISTORTIONandroid.hardware.camera2.CaptureResult#LENS_FOCAL_LENGTHandroid.hardware.camera2.CaptureResult#LENS_INTRINSIC_CALIBRATIONandroid.hardware.camera2.CameraCharacteristics#SCALAR_AVAILABLE_CAPABILITIES_STREAM_USE_CASESandroid.media.MediaRecorderandroid.media.CamcorderProfile

ผ่าน: รูปภาพไม่ยืดออก จุดกึ่งกลางของรูปภาพไม่แตกต่างกันเกิน 3% และรักษา FoV ที่เป็นไปได้สูงสุดไว้

test_preview_stabilization_fov

ตรวจสอบขนาดตัวอย่างที่รองรับเพื่อให้มั่นใจว่า FoV จะได้รับการครอบตัด

อย่างเหมาะสม การทดสอบจะบันทึกวิดีโอ 2 รายการ รายการหนึ่งมีระบบกันภาพสั่นขณะแสดงตัวอย่าง

ON และอีกรายการหนึ่งมีระบบกันภาพสั่นขณะแสดงตัวอย่างOFF ระบบจะเลือกเฟรมตัวแทนจากวิดีโอแต่ละรายการและวิเคราะห์เพื่อยืนยันว่าการเปลี่ยนแปลง FoV ในวิดีโอทั้ง 2 รายการเป็นไปตามข้อกำหนด

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#SCALAR_AVAILABLE_CAPABILITIES_STREAM_USE_CASESandroid.media.MediaRecorderandroid.media.CamcorderProfile

ผ่าน: สัดส่วนภาพของวงกลมยังคงเกือบคงที่ ตำแหน่งกึ่งกลางของ วงกลมยังคงเสถียร และขนาดของวงกลมเปลี่ยนแปลงไม่เกิน 20%

test_video_aspect_ratio_and_crop

ถ่ายวิดีโอวงกลมภายในสี่เหลี่ยมจัตุรัสในรูปแบบวิดีโอทั้งหมด แยก คีย์เฟรม และตรวจสอบว่าสัดส่วนภาพของวงกลมไม่เปลี่ยนแปลง รูปภาพที่ครอบตัดจะคงวงกลมไว้ตรงกลาง และขนาดของวงกลมไม่ เปลี่ยนแปลงสำหรับรูปแบบคงที่หรือที่มีความละเอียดต่างกัน (การตรวจสอบ FoV)

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#SCALAR_AVAILABLE_CAPABILITIES_STREAM_USE_CASESandroid.hardware.camera2.CaptureResult#LENS_DISTORTIONandroid.hardware.camera2.CaptureResult#LENS_FOCAL_LENGTHandroid.hardware.camera2.CaptureResult#LENS_INTRINSIC_CALIBRATIONandroid.media.MediaRecorderandroid.media.CamcorderProfile

ผ่าน: เฟรมวิดีโอไม่ยืด กึ่งกลางของเฟรมไม่แตกต่างกันเกิน 3% และรักษา FoV ที่เป็นไปได้สูงสุดไว้

ฉากที่ 5

scene5 ต้องใช้ฉากสีเทาที่มีแสงสว่างสม่ำเสมอ ซึ่งทำได้โดยใช้แผ่นกระจายแสง

วางไว้เหนือเลนส์กล้อง เราขอแนะนำให้ใช้ตัวกระจายแสงต่อไปนี้

www.edmundoptics.com/optics/window-diffusers/optical-diffusers/opal-diffusing-glass/46168

หากต้องการเตรียมฉาก ให้ติดตัวกระจายแสงไว้หน้ากล้องและเล็งกล้องไปยังแหล่งกำเนิดแสงที่มีความสว่างประมาณ 2, 000 ลักซ์ รูปภาพที่ถ่ายสำหรับ

scene5 ต้องมีแสงแบบกระจายโดยไม่มีฟีเจอร์ที่ชัดเจน ต่อไปนี้คือ

รูปภาพตัวอย่าง

รูปที่ 117 ตัวอย่างการจับภาพ scene5

เนื่องจากไม่จำเป็นต้องใช้แท็บเล็ตหรือตัวควบคุมในฉากนี้ การทดสอบจึงใช้แท่นทดสอบ TEST_BED_MANUAL ดูตัวอย่างได้ที่

ไฟล์ config.yml ของการทดสอบด้วยตนเอง

ไฟล์ config.yml เริ่มต้นไม่มี TEST_BED_MANUAL แต่คุณสามารถ

แก้ไขไฟล์ให้มีได้

test_lens_shading_and_color_uniformity

ทดสอบว่ามีการใช้การแก้ไขการแรเงาของเลนส์อย่างเหมาะสม และ สีของฉากที่มีสีเดียวสม่ำเสมอมีการกระจายอย่างเท่าเทียมกัน ทำการทดสอบนี้ใน เฟรม YUV ที่มี 3A อัตโนมัติ การประเมินการไล่ระดับสีของเลนส์จะอิงตามช่อง y วัดค่า y เฉลี่ยสำหรับแต่ละบล็อกตัวอย่างที่ระบุ และกำหนด ผ่านหรือไม่ผ่านโดยการเปรียบเทียบกับค่า y ตรงกลาง การทดสอบความสม่ำเสมอของสีจะ ได้รับการประเมินในพื้นที่สีแดง-เขียวและน้ำเงิน-เขียว

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#CONTROL_AE_MODEandroid.hardware.camera2.CaptureRequest#CONTROL_AWB_MODE

ผ่าน: ที่รัศมีที่ระบุของรูปภาพ ความแปรปรวนของค่าสีแดง-เขียวและ สีน้ำเงิน-เขียวต้องน้อยกว่า 20% จึงจะผ่านการทดสอบ

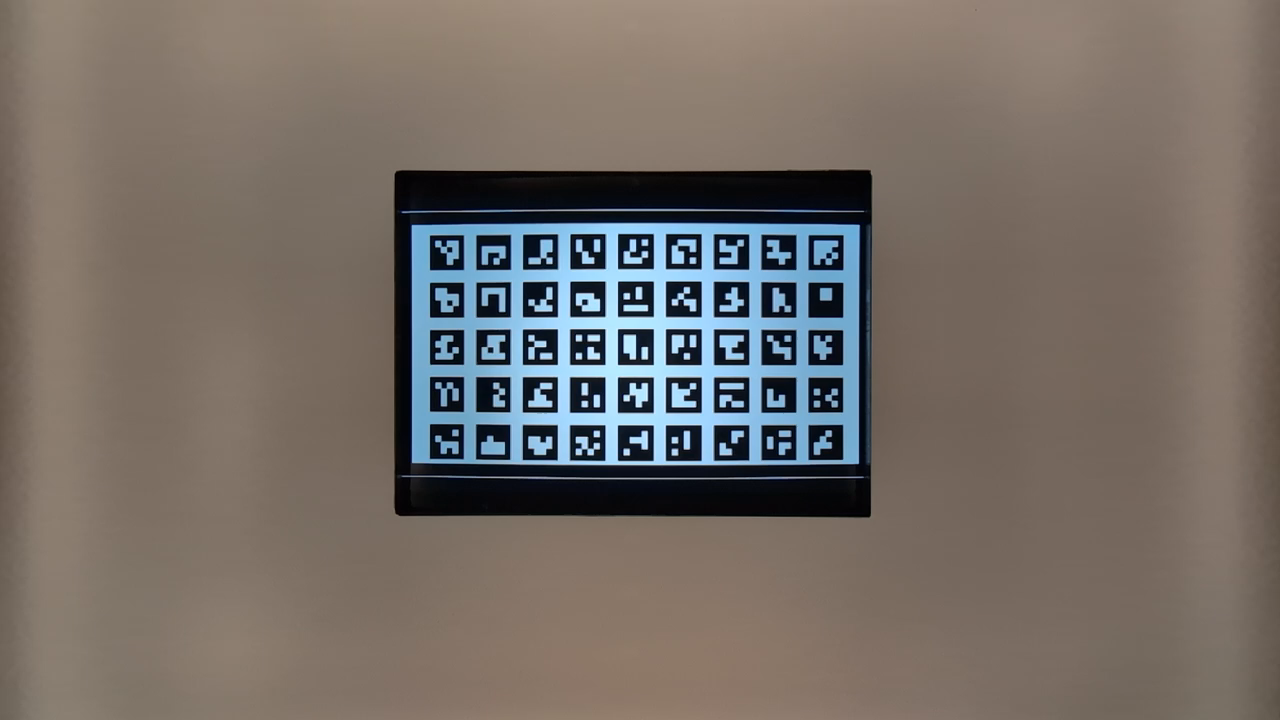

scene6

scene6 คือตารางเครื่องหมาย ArUco ที่ระบุตัวตนได้อย่างแน่ชัด

การทดสอบใน scene6 อาจไวต่อการจัดแนว ดังนั้นตั้งแต่เวอร์ชัน 15 เป็นต้นไป คุณสามารถใช้ check_alignment.py ในไดเรกทอรีเครื่องมือเพื่อเปิดใช้การตรวจสอบการจัดแนว DUT และแผนภูมิได้

รูปที่ 118 ตัวอย่าง scene6

test_in_sensor_zoom

ทดสอบลักษณะการทำงานของฟีเจอร์ซูมในเซ็นเซอร์ของกล้อง ซึ่งจะสร้าง รูปภาพ RAW ที่ครอบตัด

เมื่อตั้งค่ากรณีการใช้งานสตรีมเป็น

CROPPED_RAW

การทดสอบจะจับภาพ 2 ภาพในช่วงการซูม ได้แก่ ภาพ RAW ที่มี FoV เต็ม

และภาพ RAW ที่ครอบตัด การทดสอบจะแปลงรูปภาพเป็นอาร์เรย์ RGB

ลดขนาดรูปภาพ RAW ที่ครอบตัดขนาดเต็มให้เป็นขนาดที่รายงานโดย

SCALER_RAW_CROP_REGION และคำนวณความแตกต่างของ RMS 3 มิติ

ระหว่างรูปภาพ 2 รูป

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#CONTROL_ZOOM_RATIO_RANGEandroid.hardware.camera2.CameraCharacteristics#SCALAR_AVAILABLE_CAPABILITIES_STREAM_USE_CASESandroid.hardware.camera2.CameraMetadata#SCALER_AVAILABLE_STREAM_USE_CASES_CROPPED_RAWandroid.hardware.camera2.CaptureRequest#CONTROL_ZOOM_RATIOandroid.hardware.camera2.CaptureResult#SCALER_RAW_CROP_REGION

ผ่าน: ความแตกต่างของ RMS แบบ 3 มิติระหว่างรูปภาพ RAW ที่ครอบตัดและลดขนาด กับรูปภาพ RAW แบบ FoV เต็มน้อยกว่าเกณฑ์ที่ตั้งไว้ในการทดสอบ

test_zoom

ทดสอบลักษณะการซูมของกล้องจากเลนส์มุมกว้างพิเศษไปยังเลนส์มุมกว้าง ถ่ายภาพ ในช่วงการซูมและตรวจสอบว่าเครื่องหมาย ArUco มีขนาดใหญ่ขึ้นเมื่อ กล้องซูมเข้าหรือไม่ การทดสอบยังตรวจสอบว่าตำแหน่งของเครื่องหมายกึ่งกลางเปลี่ยนแปลง อย่างคาดการณ์ได้ในแต่ละการจับภาพหรือไม่ ระยะห่างจากกึ่งกลางของเครื่องหมายกึ่งกลางถึง กึ่งกลางของรูปภาพอาจเปลี่ยนแปลงในอัตราคงที่เมื่อเทียบกับอัตราส่วนการซูม จนกว่าจะมีการสลับกล้องจริง หรืออาจเปลี่ยนแปลงแบบโมโนโทนไปยัง ตำแหน่งของเครื่องหมายเดียวกันหลังจากสลับกล้องจริง ต้องติดตั้ง Jetpack Camera App (JCA) ในอุปกรณ์ก่อนทำการทดสอบ

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#CONTROL_ZOOM_RATIO_RANGEandroid.hardware.camera2.CameraCharacteristics#LENS_INFO_AVAILABLE_FOCAL_LENGTHSandroid.hardware.camera2.CaptureRequest#CONTROL_ZOOM_RATIOandroid.hardware.camera2.CaptureResult#LENS_FOCAL_LENGTH

ผ่าน: ขนาดสัมพัทธ์ของเครื่องหมาย ArUco ที่จับได้ถูกต้องตามอัตราส่วนการซูมที่ขอ เพื่อยืนยันว่ากล้องซูมได้อย่างถูกต้อง และระยะห่างของเครื่องหมาย จากกึ่งกลางของรูปภาพเปลี่ยนแปลงตามเกณฑ์ที่ระบุไว้ในคำอธิบายการทดสอบ

รูปที่ 119. test_zoom เพื่อค้นหาเส้นชั้นความสูงของเครื่องหมาย ArUco ที่ใกล้กับกึ่งกลางมากที่สุด

test_low_latency_zoom

ทดสอบลักษณะการทำงานของการซูมที่มีเวลาในการตอบสนองที่รวดเร็วของกล้อง ถ่ายภาพในช่วงการซูม

ด้วย android.control.settingsOverride = 1 (SETTINGS_OVERRIDE_ZOOM) และตรวจสอบ

ว่าเครื่องหมายในรูปภาพเอาต์พุตตรงกับอัตราส่วนการซูมในข้อมูลเมตา

ของการจับภาพหรือไม่ ระบบจะใช้เซสชันการจับภาพจากกล้องเดียวกันเพื่อรวม 3A และ

ถ่ายภาพ

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#CONTROL_AVAILABLE_SETTINGS_OVERRIDESandroid.hardware.camera2.CameraCharacteristics#CONTROL_ZOOM_RATIO_RANGEandroid.hardware.camera2.CaptureRequest#CONTROL_SETTINGS_OVERRIDEandroid.hardware.camera2.CaptureRequest#CONTROL_ZOOM_RATIOandroid.hardware.camera2.CaptureResult#CONTROL_SETTINGS_OVERRIDE

ผ่าน: ขนาดสัมพัทธ์ของเครื่องหมายที่จับได้ถูกต้องเมื่อเทียบกับอัตราส่วนการซูม ข้อมูลเมตาของผลลัพธ์

test_preview_video_zoom_match

การทดสอบขณะบันทึกและซูม ตัวอย่างวิดีโอและเอาต์พุตวิดีโอจะแสดง และบันทึกเอาต์พุตเดียวกัน คำนวณขนาดของตัวทำเครื่องหมายที่ใกล้กับ กึ่งกลางมากที่สุดที่อัตราส่วนการซูมต่างๆ และตรวจสอบว่าขนาดของตัวทำเครื่องหมาย เพิ่มขึ้นเมื่ออัตราส่วนการซูมเพิ่มขึ้นหรือไม่

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#CONTROL_ZOOM_RATIO_RANGEandroid.hardware.camera2.CameraCharacteristics#LENS_INFO_AVAILABLE_FOCAL_LENGTHSandroid.hardware.camera2.CaptureRequest#CONTROL_ZOOM_RATIOandroid.hardware.camera2.CaptureResult#LENS_FOCAL_LENGTH

ผ่าน: ขนาดสัมพัทธ์ของเครื่องหมายที่จับภาพถูกต้องเมื่อเทียบกับอัตราส่วนการซูมที่ขอในวิดีโอและตัวอย่าง

รูปที่ 120 HD_1280x720_key_frame.png (ก่อนซูม)

รูปที่ 121. preview_1280x720_key_frame.png (ก่อนซูม)

รูปที่ 122 HD_1280x720_key_frame.png (หลังซูม)

รูปที่ 123. preview_1280x720_key_frame.png (หลังซูม)

test_preview_zoom

การทดสอบที่อัตราส่วนการซูมของเฟรมตัวอย่างแต่ละเฟรมตรงกับข้อมูลเมตาของการจับภาพที่เกี่ยวข้องจากเลนส์มุมกว้างพิเศษไปยังเลนส์ไวด์ การทดสอบจะใช้เฟรมตัวอย่างในช่วงการซูมและค้นหาเครื่องหมาย ArUco ที่อยู่ใกล้กับกึ่งกลางมากที่สุด จากนั้นการทดสอบจะตรวจสอบว่าตำแหน่งของเครื่องหมายกึ่งกลางเปลี่ยนแปลง อย่างคาดการณ์ได้ในแต่ละการจับภาพหรือไม่ ระยะห่างจากกึ่งกลางของเครื่องหมายกึ่งกลางถึง กึ่งกลางของรูปภาพอาจเปลี่ยนแปลงในอัตราคงที่เมื่อเทียบกับอัตราส่วนการซูม จนกว่าจะมีการสลับกล้องจริง หรืออาจเปลี่ยนแปลงแบบโมโนโทนไปยัง ตำแหน่งของเครื่องหมายเดียวกันหลังจากสลับกล้องจริง

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#CONTROL_ZOOM_RATIO_RANGEandroid.hardware.camera2.CameraCharacteristics#LENS_INFO_AVAILABLE_FOCAL_LENGTHSandroid.hardware.camera2.CaptureRequest#CONTROL_ZOOM_RATIOandroid.hardware.camera2.CaptureResult#LENS_FOCAL_LENGTH

ผ่าน: ขนาดสัมพัทธ์ของเครื่องหมาย ArUco ที่เลือกถูกต้องสำหรับอัตราส่วนการซูมที่รายงานของผลลัพธ์การจับภาพที่เกี่ยวข้องสำหรับเฟรมตัวอย่างทั้งหมด ระยะทางสัมพัทธ์ของตัวทำเครื่องหมายที่เลือกจากกึ่งกลางของรูปภาพจะมีความแม่นยำสำหรับอัตราส่วนการซูมที่รายงานของผลการจับภาพที่เกี่ยวข้องของเฟรมตัวอย่างทั้งหมด

รูปที่ 124. รูปภาพ test_preview_zoom ที่แสดงเครื่องหมายที่เลือกซึ่งอยู่ใกล้กึ่งกลางมากที่สุด

test_session_characteristics_zoom

ทดสอบช่วงอัตราส่วนการซูมสำหรับการกำหนดค่าเซสชันที่รองรับทั้งหมดซึ่งแสดงอยู่ใน

CameraCharacteristics#INFO_SESSION_CONFIGURATION_QUERY_VERSION

สำหรับการกำหนดค่าแต่ละรายการ หาก

CameraDeviceSetup#isSessionConfigurationSupported

แสดงผลเป็น true การทดสอบจะยืนยันว่าช่วงอัตราส่วนการซูมที่แสดงผลใน

CameraDeviceSetup#getSessionCharacteristics

สามารถเข้าถึงได้

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#INFO_SESSION_CONFIGURATION_QUERY_VERSIONandroid.hardware.camera2.CameraDevice.CameraDeviceSetup#isSessionConfigurationSupportedandroid.hardware.camera2.CameraDevice.CameraDeviceSetup#getSessionCharacteristics

ผ่าน: อัตราส่วนการซูมทั้งขั้นต่ำและสูงสุดสามารถเข้าถึงได้สำหรับSessionConfigurationที่รองรับแต่ละรายการซึ่งระบุไว้ใน

CameraCharacteristics#INFO_SESSION_CONFIGURATION_QUERY_VERSION

scene7

scene7 คือกรอบสี่เหลี่ยมผืนผ้าที่แบ่งออกเป็น 4 ส่วนเท่าๆ กัน โดยแต่ละส่วนจะเติมด้วยสีที่แตกต่างกัน ตรงกลางสี่เหลี่ยมผืนผ้าคือแผนภูมิขอบเอียง

สำหรับการตรวจสอบความคมชัด เครื่องหมาย ArUco 4 อันจะจัดแนวให้ตรงกับมุมด้านนอกทั้ง 4 มุม

ของสี่เหลี่ยมผืนผ้าเพื่อช่วยในการรับพิกัดที่ถูกต้องของกรอบสี่เหลี่ยมผืนผ้าหลัก

ที่อัตราส่วนการซูมต่างๆ

รูปที่ 125 scene7

test_multi_camera_switch

การทดสอบนี้จะยืนยันว่าในระหว่างการบันทึกตัวอย่างที่อัตราส่วนการซูมต่างๆ การสลับระหว่างเลนส์อัลตร้าไวด์ (UW) กับเลนส์ไวด์ (W) จะส่งผลให้ค่า RGB คล้ายกัน

การทดสอบจะใช้อัตราส่วนการซูมที่แตกต่างกันภายในช่วงที่กำหนดไว้ล่วงหน้าเพื่อทำการ บันทึกตัวอย่างแบบไดนามิกและระบุจุดที่กล้องจริง เปลี่ยน จุดนี้เป็นจุดที่เลนส์ UW เปลี่ยนเป็นเลนส์ W

ระบบจะวิเคราะห์เฟรมที่จับภาพ ณ จุดครอสโอเวอร์และก่อนหน้านั้นเพื่อหา การเปิดรับแสงอัตโนมัติ (AE), สมดุลสีขาวอัตโนมัติ (AWB) และโฟกัสอัตโนมัติ (AF)

การตรวจสอบ AE จะยืนยันว่าการเปลี่ยนแปลงความสว่างอยู่ในช่วงที่คาดไว้สำหรับ ทั้งรูปภาพเลนส์ UW และ W การตรวจสอบ AWB จะยืนยันว่าอัตราส่วนของสีแดง-เขียว และสีน้ำเงิน-เขียวอยู่ภายในค่าเกณฑ์สำหรับทั้งรูปภาพเลนส์ UW และ W การตรวจสอบ AF จะประเมินค่าการประมาณความคมชัดตามขนาดการไล่ระดับเฉลี่ยระหว่างภาพเลนส์ UW และ W

ขณะทำการทดสอบนี้ หากเอฟเฟกต์มัวเร่รบกวนผลลัพธ์ ให้ใช้แท็บเล็ตที่มีความละเอียดสูงกว่าจากรายการรายการแท็บเล็ตที่ผ่านการรับรอง ITS ของกล้อง

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#CONTROL_ZOOM_RATIO_RANGEandroid.hardware.camera2.CaptureRequest#CONTROL_ZOOM_RATIOandroid.media.CamcorderProfileandroid.media.MediaRecorder

ผ่าน: การทดสอบจะผ่านเมื่อการตรวจสอบ AE และ AWB ผ่าน ผลการตรวจสอบ AF จะใช้เพื่อวัตถุประสงค์ในการบันทึกเท่านั้น เกณฑ์สำหรับการตรวจสอบแต่ละรายการมีดังนี้

- การตรวจสอบ AE: การเปลี่ยนแปลงความสว่าง (ค่า Y) ระหว่างรูปภาพเลนส์ UW และ W ต้องน้อยกว่า 4% สำหรับแพตช์สีทั้งหมด หากอุปกรณ์รองรับทั้ง

ae_regionsและawb_regionsหากรองรับเฉพาะae_regionsค่าแพตช์สีเทาเท่านั้นที่ต้องเป็นไปตามเกณฑ์ - การตรวจสอบ AWB: ความแตกต่างระหว่างค่าสีแดง-เขียวและสีน้ำเงิน-เขียวสำหรับรูปภาพเลนส์ UW และ W ต้องน้อยกว่า 3% สำหรับแพตช์สีเทา และต้องน้อยกว่า 10% สำหรับแพตช์สีอื่นๆ หากอุปกรณ์รองรับทั้ง

ae_regionsและawb_regions - การตรวจสอบ AF: ความคมชัดของรูปภาพที่ถ่ายด้วยเลนส์ W ต้องสูงกว่าความคมชัดที่ถ่ายด้วยเลนส์ UW

รูปที่ 126 แพตช์สีเทาที่ถ่ายด้วยเลนส์ UW

รูปที่ 127 แพตช์สีเทาที่ถ่ายด้วยเลนส์ W

ฉากที่ 8

scene8 คือกรอบสี่เหลี่ยมผืนผ้าที่แบ่งออกเป็น 4 ส่วนเท่าๆ กัน โดยแต่ละส่วนมี

ภาพบุคคลที่ถ่ายด้วยค่าแสงที่แตกต่างกันหรือซ้อนทับด้วยเฉดสีที่แตกต่างกัน (เฉดสีน้ำเงิน ค่าแสงที่เพิ่มขึ้น ค่าแสงที่ลดลง เฉดสีเหลือง)

เครื่องหมาย ArUco 4 อันจะอยู่ในแนวเดียวกับมุมด้านนอกทั้ง 4 ของสี่เหลี่ยมผืนผ้า

เพื่อให้ได้พิกัดที่ถูกต้องของกรอบสี่เหลี่ยมผืนผ้าหลัก

รูปที่ 128 ตัวอย่าง scene8

test_ae_awb_regions

การทดสอบว่าค่า RGB และค่าความสว่างแตกต่างกันเมื่อดูตัวอย่างการบันทึกในภูมิภาค AE และ AWB ที่ต่างกัน

การทดสอบจะบันทึกตัวอย่างการบันทึก 8 วินาที โดยจะทำการวัดแสง AE และ AWB ในแต่ละช่องเป็นเวลา 2 วินาที จากนั้นการทดสอบจะดึง เฟรมจากการบันทึกตัวอย่างของแต่ละภูมิภาค และใช้เฟรมที่ดึงมาเพื่อ ทำการตรวจสอบ AE และ AWB ต่อไปนี้

- การตรวจสอบ AE: ตรวจสอบว่าเฟรมที่วัดแสงในภูมิภาคที่มีการลด ค่าแสงมีค่าความสว่างเพิ่มขึ้นมากกว่า 1% เมื่อเทียบกับเฟรม ที่วัดแสงในภูมิภาคที่มีการเพิ่มค่าแสง ซึ่งจะยืนยันว่าระบบจะ เพิ่มความสว่างให้รูปภาพเมื่อวัดแสงในพื้นที่มืด

- การตรวจสอบ AWB: ตรวจสอบว่าอัตราส่วนของสีแดงต่อสีน้ำเงิน (ของค่า RGB เฉลี่ยของรูปภาพ) ในเฟรมที่มีพื้นที่วัดแสงสีน้ำเงินสูงกว่าเฟรมที่มีพื้นที่วัดแสงสีเหลืองมากกว่า 2% ซึ่งจะยืนยันว่า รูปภาพมีค่า RGB ที่สมดุลเมื่อวัดแสงในพื้นที่สีเหลือง (โทนอุ่น) หรือสีน้ำเงิน (โทนเย็น)

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#CONTROL_AWB_REGIONSandroid.hardware.camera2.CaptureRequest#CONTROL_AE_REGIONSandroid.hardware.camera2.CameraCharacteristics#CONTROL_MAX_REGIONS_AEandroid.hardware.camera2.CameraCharacteristics#CONTROL_MAX_REGIONS_AWB

ผ่าน: การตรวจสอบ AE และ AWB ผ่านทั้ง 2 รายการ

รูปที่ 129 วัดแสงในเฟรมของพื้นที่มืดโดยเพิ่มค่าแสง

รูปที่ 130 การวัดแสงตามเฟรมในบริเวณที่สว่างขึ้นโดยลดการเปิดรับแสง

กลไกการทำงานที่ล้มเหลว

การตรวจจับเครื่องหมาย ArUco ทั้ง 4 อย่างได้อย่างแม่นยำเป็นสิ่งสำคัญสำหรับการทดสอบนี้ หาก การตรวจจับครั้งแรกไม่สำเร็จ ระบบจะพยายามตรวจจับครั้งที่ 2 โดยใช้รูปภาพเวอร์ชันขาวดำ รูปภาพระดับสีเทาต่อไปนี้ แสดงขั้นตอนการประมวลผลรอง

รูปที่ 131 เครื่องหมาย ArUco ไม่ตรงกัน

test_color_correction_mode_cct

การทดสอบ COLOR_CORRECTION_MODE

ในอุณหภูมิสีและเฉดสีต่างๆ โดยตรวจสอบการเปลี่ยนแปลงในอัตราส่วน RGB

เทียบกับฉากที่บันทึก scene8

API ที่ทดสอบ:

android.hardware.camera2.CaptureRequest#COLOR_CORRECTION_MODEandroid.hardware.camera2.CaptureResult#COLOR_CORRECTION_MODEandroid.hardware.camera2.CaptureRequest#COLOR_CORRECTION_COLOR_TEMPERATUREandroid.hardware.camera2.CaptureResult#COLOR_CORRECTION_COLOR_TEMPERATUREandroid.hardware.camera2.CaptureRequest#COLOR_CORRECTION_COLOR_TINTandroid.hardware.camera2.CaptureResult#COLOR_CORRECTION_COLOR_TINTandroid.hardware.camera2.CameraCharacteristics#COLOR_CORRECTION_COLOR_TEMPERATURE_RANGEandroid.hardware.camera2.CameraMetadata#COLOR_CORRECTION_MODE_CCTandroid.hardware.camera2.CameraCharacteristics#COLOR_CORRECTION_AVAILABLE_ABERRATION_MODES

ผ่าน: อัตราส่วน RGB แสดงการเพิ่มขึ้นหรือลดลงตามที่คาดการณ์ไว้เมื่อเทียบกับ อุณหภูมิสีและสีที่เลือก

เกณฑ์การข้ามการทดสอบ

ระบบจะข้ามการทดสอบ test_color_correction_mode_cct หากเป็นไปตามเกณฑ์ต่อไปนี้

- อุปกรณ์มีระดับ API แรก (

first_api_level) เป็น 35 หรือต่ำกว่า - อุปกรณ์ไม่โฆษณา

COLOR_CORRECTION_MODE_CCTในCOLOR_CORRECTION_AVAILABLE_ABERRATION_MODES

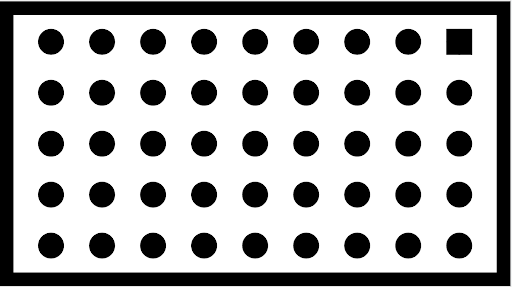

ฉากที่ 9

scene9 ประกอบด้วยวงกลมหลายพันวงที่มีขนาดและสีแบบสุ่มเพื่อสร้างฉากที่มีความซ้ำซ้อนต่ำมากเพื่อทดสอบอัลกอริทึมการบีบอัด JPEG

รูปที่ 132 ตัวอย่าง scene9

test_jpeg_high_entropy

การทดสอบที่การบีบอัด JPEG ของกล้องทำงานบน scene9 ที่มีเอนโทรปีสูงและ

ตั้งค่าปัจจัยคุณภาพ JPEG เป็น 100% เพิ่มปัจจัยการซูมเพื่อยืนยันว่า

ฉากที่แสดงบนแท็บเล็ตจะเติมเต็ม FoV ของกล้อง

API ที่ทดสอบ:

ผ่าน: บีบอัดไฟล์ JPEG อย่างถูกต้อง เขียน และอ่านจากดิสก์

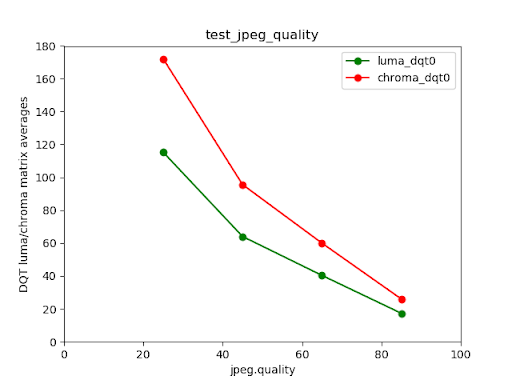

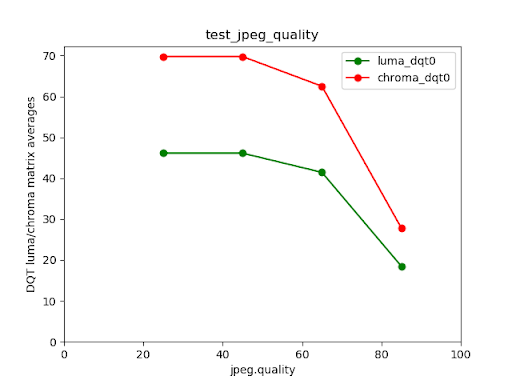

test_jpeg_quality

ทดสอบคุณภาพการบีบอัด JPEG ของกล้อง คุณภาพ JPEG ผ่าน android.jpeg.quality และยืนยันว่าตารางการหาปริมาณเปลี่ยนแปลง

อย่างถูกต้อง

API ที่ทดสอบ:

ผ่าน: เมทริกซ์การหาปริมาณจะลดลงเมื่อคุณภาพเพิ่มขึ้น (เมทริกซ์ แสดงถึงปัจจัยการหาร)

รูปที่ 133 ค่าเฉลี่ยเมทริกซ์ DQT ของความสว่างและสีของกล้องหลัง Pixel 4 เทียบกับคุณภาพ JPEG

รูปที่ 134 ตัวอย่างการทดสอบที่ไม่สำเร็จ

scene_video

scene_video เป็นฉากวิดีโอที่มีวงกลมสีต่างกัน 4 วง

เคลื่อนที่ไปมาด้วยอัตราเฟรมที่ต่างกันบนพื้นหลังสีขาว

รูปที่ 135 ตัวอย่าง scene_video

test_preview_frame_drop

ทดสอบว่าอัตราเฟรมตัวอย่างที่ขอจะยังคงอยู่กับฉากแบบไดนามิก การทดสอบนี้จะทำงานในกล้องทั้งหมดที่แอปของบุคคลที่สามเข้าถึงได้

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#CONTROL_AE_AVAILABLE_TARGET_FPS_RANGESandroid.hardware.camera2.CameraCharacteristics#SCALAR_AVAILABLE_CAPABILITIES_STREAM_USE_CASESandroid.hardware.camera2.CaptureResult#CONTROL_AE_TARGET_FPS_RANGEandroid.media.CamcorderProfileandroid.media.MediaRecorder

ผ่าน: อัตราเฟรมของตัวอย่างอยู่ที่อัตราเฟรมสูงสุดของช่วงอัตราเฟรมที่ขอ และความผันผวนโดยเฉลี่ยระหว่างเฟรมที่ต่อเนื่องกันน้อยกว่าค่าความคลาดเคลื่อนสัมพัทธ์ที่ตั้งไว้ในการทดสอบ

scene_extensions

การทดสอบ scene_extensions มีไว้สำหรับส่วนขยายของกล้องและต้องใช้ Camera ITS-in-a-Box เนื่องจากต้องมีการควบคุมสภาพแวดล้อมการทดสอบอย่างแม่นยำ นอกจากนี้

ต้องควบคุมการรั่วไหลของแสงทั้งหมด ซึ่งอาจต้องคลุมแท่นทดสอบ

DUT และแท็บเล็ตด้วยผ้าคลุม รวมถึงป้องกันไม่ให้แสงรั่วจาก

หน้าจอด้านหน้าของ DUT

scene_hdr

ฉาก scene_hdr ประกอบด้วยภาพบุคคลทางด้านซ้ายและคิวอาร์โค้ดที่มีคอนทราสต์ต่ำ

ทางด้านขวา

รูปที่ 136 ตัวอย่าง scene_hdr

test_hdr_extension

ทดสอบส่วนขยาย HDR ถ่ายภาพโดยเปิดและปิดใช้ส่วนขยาย แล้วตรวจสอบว่าส่วนขยายช่วยให้ตรวจหาคิวอาร์โค้ดได้ง่ายขึ้นหรือไม่

API ที่ทดสอบ:

android.hardware.camera2.CameraExtensionCharacteristics#getSupportedExtensionsandroid.hardware.camera2.CameraExtensionSession#capture

ผ่าน: ส่วนขยาย HDR จะลดจำนวนการเปลี่ยนแปลงคอนทราสต์ที่จำเป็นต่อการ ตรวจหาคิวอาร์โค้ดหรือลดการไล่ระดับสีในคิวอาร์โค้ด

scene_low_light

ฉาก scene_low_light ประกอบด้วยตารางสี่เหลี่ยมจัตุรัสที่มีเฉดสีเทาแตกต่างกัน

บนพื้นหลังสีดำ และตารางสี่เหลี่ยมจัตุรัสมีเส้นขอบสีแดง

โดยสี่เหลี่ยมจัตุรัสจะจัดเรียงตามเส้นโค้งฮิลเบิร์ต

รูปที่ 137 ตัวอย่าง scene_low_light

test_night_extension

ทดสอบส่วนขยาย กลางคืน ถ่ายภาพโดยเปิดใช้ส่วนขยาย แล้วดำเนินการต่อไปนี้

- ตรวจจับการมีอยู่ของสี่เหลี่ยม 20 รูป

- คำนวณความสว่างที่ล้อมรอบด้วยแต่ละสี่เหลี่ยม

- คำนวณค่าความสว่างเฉลี่ยของสี่เหลี่ยมจัตุรัส 6 ช่องแรกตาม การวางแนวตารางเส้นโค้งฮิลเบิร์ต

- คำนวณความแตกต่างของค่าความสว่างของสี่เหลี่ยมจัตุรัสที่อยู่ติดกัน (เช่น square2 - square1) จนถึงสี่เหลี่ยมจัตุรัสที่ 5 และ 6 (square6 - square5) และหา ค่าเฉลี่ยของความแตกต่างที่คำนวณได้ 5 ค่า

สำหรับอุปกรณ์ที่ใช้ Android 16 ขึ้นไป คำขอจับภาพ จะมีภูมิภาคที่วัดการใช้งานซึ่งสอดคล้องกับสี่เหลี่ยมผืนผ้าที่ล้อมรอบ ตารางสี่เหลี่ยม การเพิ่มนี้จะเปลี่ยนเกณฑ์การผ่าน

API ที่ทดสอบ:

android.hardware.camera2.CameraExtensionCharacteristics#getSupportedExtensionsandroid.hardware.camera2.CameraExtensionSession#capture

บัตร:

- สำหรับอุปกรณ์ที่ใช้ Android 16 ขึ้นไป ค่าความสว่างเฉลี่ยของ 6 ช่องแรกต้องมีค่าอย่างน้อย 80 และค่าความแตกต่างเฉลี่ยของค่าความสว่างของช่องที่อยู่ติดกันจนถึงช่องที่ 5 และ 6 ต้องมีค่าอย่างน้อย 18.75

- สำหรับอุปกรณ์ที่ใช้ Android 15 และต่ำกว่า ค่าความสว่างเฉลี่ย ของสี่เหลี่ยมจัตุรัส 6 ช่องแรกต้องมีค่าอย่างน้อย 85 และความแตกต่างเฉลี่ย ของค่าความสว่างของสี่เหลี่ยมจัตุรัสที่อยู่ติดกันจนถึงสี่เหลี่ยมจัตุรัสช่องที่ 5 และ 6 ต้องมีค่าอย่างน้อย 17

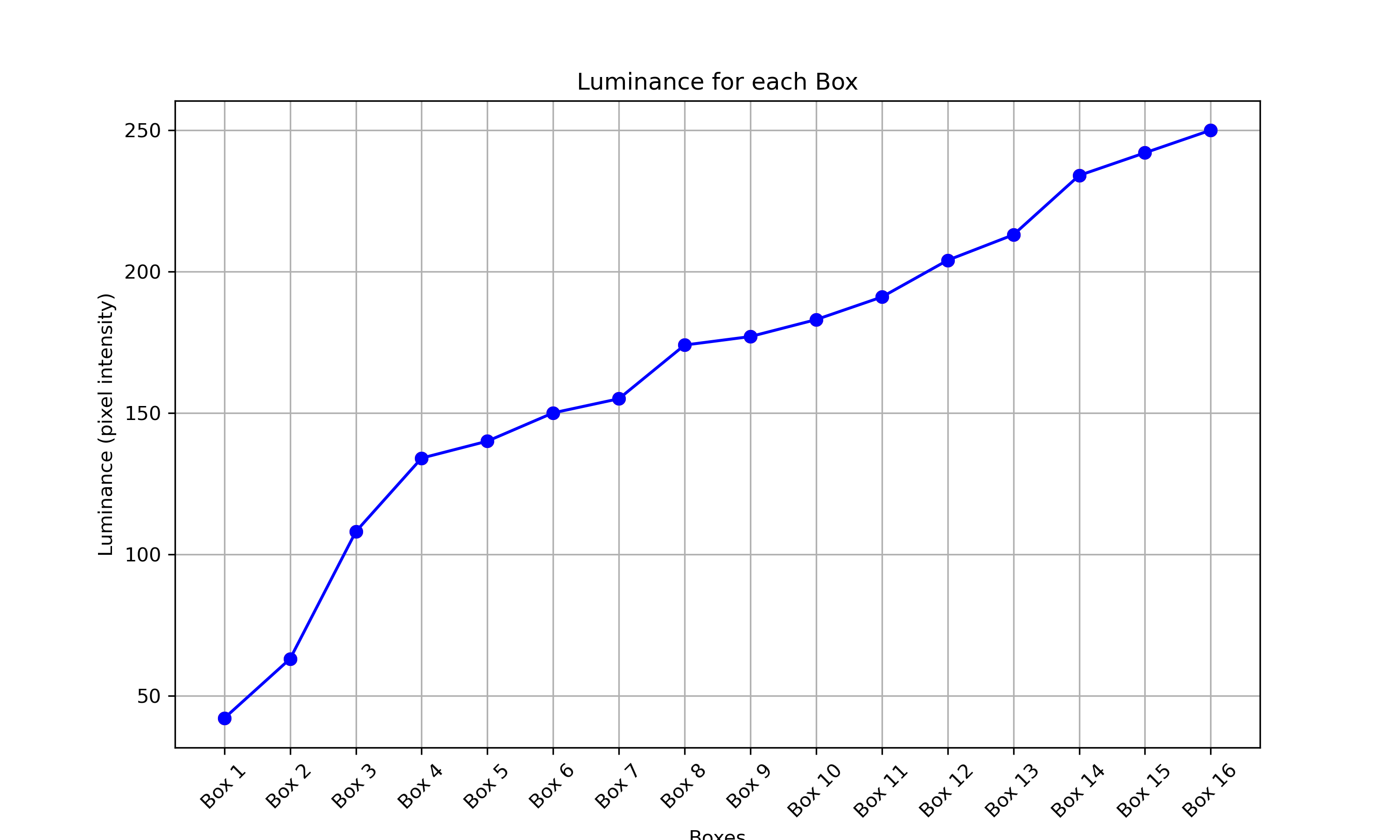

แผนภาพความสว่างต่อไปนี้แสดงลักษณะของผลการทดสอบที่ผ่าน

รูปที่ 138 ตัวอย่างการผ่านการทดสอบฉากกลางคืนที่มีแสงน้อย

test_low_light_boost_extension

ทดสอบ โหมด AE การเพิ่มแสงในสภาวะแสงน้อย หาก Camera2 รองรับโหมด AE ที่เพิ่มประสิทธิภาพในที่แสงน้อย ระบบจะทำการทดสอบนี้สำหรับ Camera2 หากส่วนขยายกล้องโหมดกลางคืนรองรับและส่วนขยายรองรับโหมด AE ที่เพิ่มประสิทธิภาพในสภาวะแสงน้อย ระบบจะทำการทดสอบนี้กับส่วนขยายกล้องโหมดกลางคืนด้วย การทดสอบนี้จะตั้งค่าโหมด AE เป็นการเพิ่มแสงน้อย ถ่ายเฟรมจากตัวอย่าง และดำเนินการต่อไปนี้

- ตรวจพบกล่อง 20 กล่อง

- คำนวณความสว่างที่ล้อมรอบด้วยแต่ละกรอบ

- คำนวณค่าความสว่างเฉลี่ยของสี่เหลี่ยมจัตุรัส 6 ช่องแรกตาม การวางแนวตารางเส้นโค้งฮิลเบิร์ต

- คำนวณความแตกต่างของค่าความสว่างของสี่เหลี่ยมจัตุรัสที่อยู่ติดกัน (เช่น square2 - square1) จนถึงสี่เหลี่ยมจัตุรัสที่ 5 และ 6 (square6 - square5) และหา ค่าเฉลี่ยของความแตกต่างที่คำนวณได้ 5 ค่า

สำหรับอุปกรณ์ที่ใช้ Android 16 ขึ้นไป คำขอจับภาพ จะมีภูมิภาคที่วัดการใช้งานซึ่งสอดคล้องกับสี่เหลี่ยมผืนผ้าที่ล้อมรอบ ตารางสี่เหลี่ยม การเพิ่มนี้จะเปลี่ยนเกณฑ์การผ่าน

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics.CONTROL_AE_AVAILABLE_MODESandroid.hardware.camera2.CameraMetadata#CONTROL_AE_MODE_ON_LOW_LIGHT_BOOST_BRIGHTNESS_PRIORITYandroid.hardware.camera2.CameraExtensionCharacteristics#getSupportedExtensions

บัตร:

สำหรับอุปกรณ์ที่ใช้ Android 16 ขึ้นไป ค่าความสว่างเฉลี่ยของ 6 ช่องแรกต้องมีอย่างน้อย 54 และความแตกต่างเฉลี่ยของค่าความสว่างของช่องที่อยู่ติดกันจนถึงช่องที่ 5 และ 6 ต้องมีอย่างน้อย 17

สำหรับอุปกรณ์ที่ใช้ Android 15 และต่ำกว่า ค่าความสว่างเฉลี่ย ของสี่เหลี่ยมจัตุรัส 6 ช่องแรกต้องมีค่าอย่างน้อย 70 และความแตกต่างเฉลี่ย ของค่าความสว่างของสี่เหลี่ยมจัตุรัสที่อยู่ติดกันจนถึงสี่เหลี่ยมจัตุรัสช่องที่ 5 และ 6 ต้องมีค่าอย่างน้อย 18

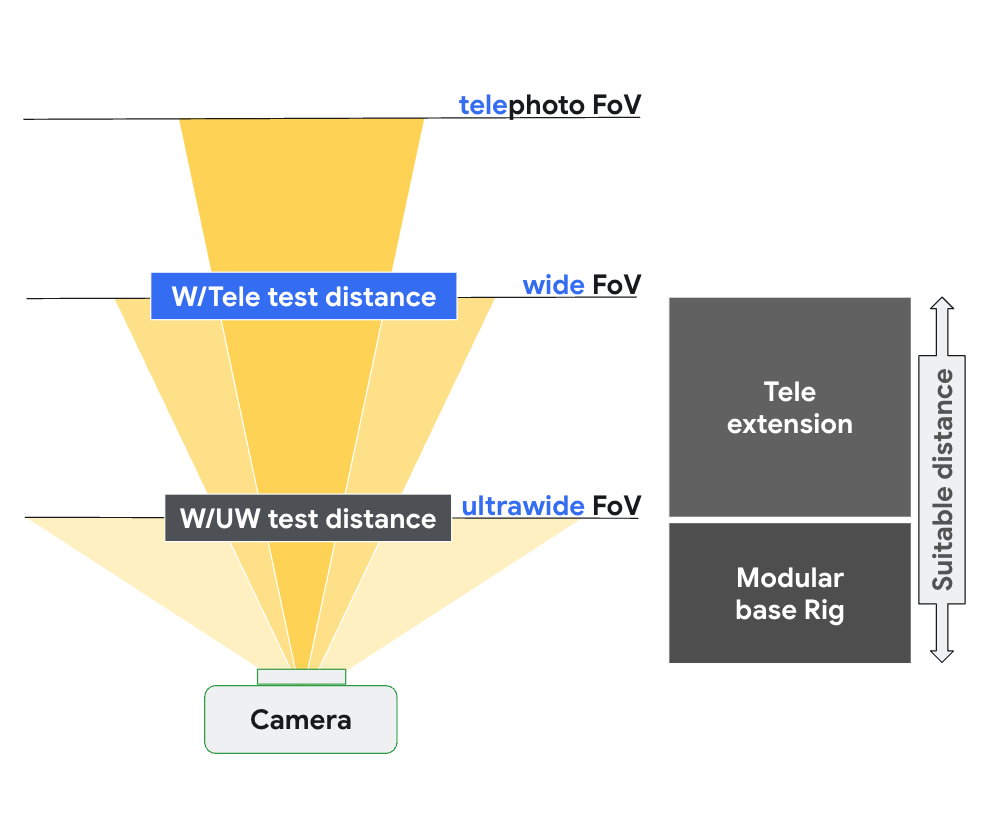

scene_tele

ข้อกำหนดที่สำคัญสำหรับการทดสอบ scene_tele คือระยะห่างของชาร์ตต้องเป็นระยะโฟกัสต่ำสุดของเลนส์เทเลโฟโต้เป็นอย่างน้อย เนื่องจากระยะโฟกัสต่ำสุดนี้อาจแตกต่างกันไปในแต่ละอุปกรณ์ คุณจึงต้องกำหนดค่าการตั้งค่า

ให้เหมาะกับกล้องเทเลโฟโต้เฉพาะ

รูปที่ 139 การตั้งค่า scene_tele ตามระยะโฟกัสของกล้องมุมกว้างและกล้องเทเล

ดูข้อมูลเพิ่มเติมเกี่ยวกับการตั้งค่าฮาร์ดแวร์ทดสอบได้ที่ การตั้งค่าอุปกรณ์เสริมสำหรับ Tele

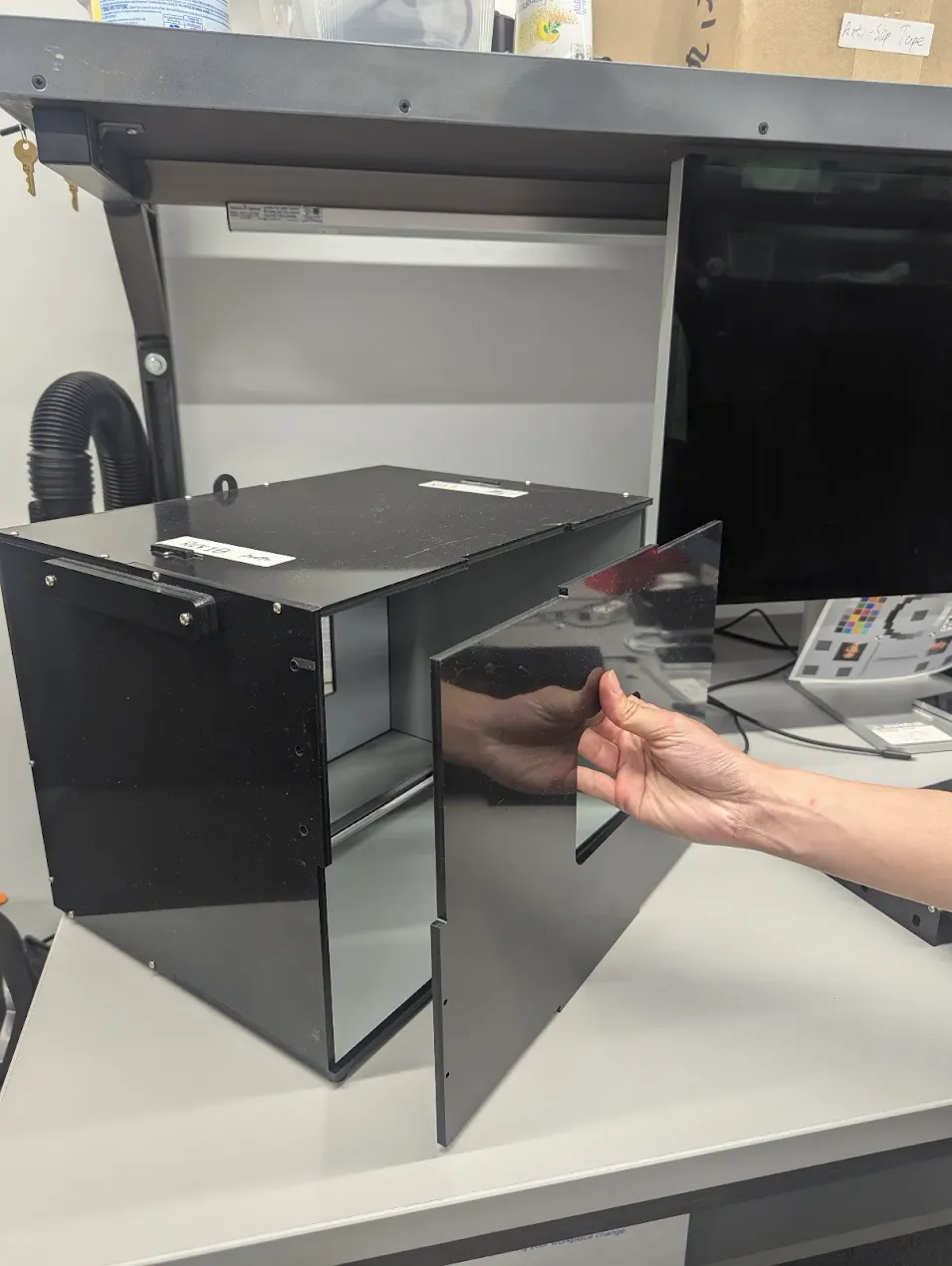

scene6_tele

ฉาก scene6_tele ประกอบด้วยตารางเครื่องหมาย ArUco บนพื้นหลังสีขาว

หากscene6_teleที่บันทึกดูสว่างเกินไปในอุปกรณ์เสริมแบบโมดูลาร์ ให้นำแผ่นด้านหน้าของอุปกรณ์เสริมแบบโมดูลาร์ออก

ถอดแท่นทดสอบ WFoV ออกจากส่วนขยายและถอดที่ยึดโทรศัพท์ออก

รูปที่ 140 ถอดแท่นทดสอบ WFoV ออกจากส่วนขยายและถอดที่ยึดโทรศัพท์ออก

รูปที่ 141 ถอดเพลตด้านหน้าออก

test_zoom_tele

ทดสอบลักษณะการซูมของกล้องจากเลนส์มุมกว้างไปยังเลนส์เทเลโฟโต้ การทดสอบนี้เหมือนกับ test_zoom แต่จะทดสอบลักษณะการทำงานของการซูมกล้อง

จากเลนส์มุมกว้างไปยังเลนส์เทเลโฟโต้

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#CONTROL_ZOOM_RATIO_RANGEandroid.hardware.camera2.CameraCharacteristics#LENS_INFO_AVAILABLE_FOCAL_LENGTHSandroid.hardware.camera2.CaptureRequest#CONTROL_ZOOM_RATIOandroid.hardware.camera2.CaptureResult#LENS_FOCAL_LENGTH

ผ่าน: ขนาดสัมพัทธ์ของเครื่องหมาย ArUco ที่จับภาพนั้นถูกต้องเมื่อเทียบกับอัตราส่วนการซูมที่ขอเพื่อยืนยันว่ากล้องซูมได้อย่างถูกต้อง และระยะห่างของเครื่องหมาย

จากกึ่งกลางของภาพเปลี่ยนแปลงตามเกณฑ์ที่ระบุไว้ใน

test_zoom

test_preview_zoom_tele

ทดสอบลักษณะการซูมของกล้องสำหรับเฟรมตัวอย่างจากเลนส์มุมกว้างไปยัง

เลนส์เทเลโฟโต้ การทดสอบนี้เหมือนกับ

test_preview_zoom แต่จะทดสอบการซูมกล้อง

สำหรับเฟรมตัวอย่างจากเลนส์มุมกว้างไปยังเลนส์เทเลโฟโต้

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#CONTROL_ZOOM_RATIO_RANGEandroid.hardware.camera2.CameraCharacteristics#LENS_INFO_AVAILABLE_FOCAL_LENGTHSandroid.hardware.camera2.CaptureRequest#CONTROL_ZOOM_RATIOandroid.hardware.camera2.CaptureResult#LENS_FOCAL_LENGTH

ผ่าน: ขนาดสัมพัทธ์ของเครื่องหมาย ArUco ที่จับภาพถูกต้องตามอัตราส่วนการซูมที่ขอ เพื่อยืนยันว่ากล้องซูมได้อย่างถูกต้อง และระยะห่างของเครื่องหมาย จากกึ่งกลางของภาพเปลี่ยนแปลงตามเกณฑ์ที่ระบุไว้ใน test_preview_zoom

scene7_tele

scene7_tele เหมือนกับ scene7 แต่ตั้งค่าสำหรับการทดสอบเลนส์เทเลโฟโต้

โดยเป็นกรอบสี่เหลี่ยมผืนผ้าที่แบ่งออกเป็น 4 ส่วนเท่าๆ กัน ซึ่งแต่ละส่วนจะเติมด้วยสีที่แตกต่างกัน ตรงกลางสี่เหลี่ยมผืนผ้าคือแผนภูมิขอบเอียง

สำหรับการตรวจสอบความคมชัด เครื่องหมาย ArUco 4 อันจะจัดแนวให้ตรงกับมุมด้านนอกทั้ง 4 มุม

ของสี่เหลี่ยมผืนผ้าเพื่อช่วยในการรับพิกัดที่ถูกต้องของกรอบสี่เหลี่ยมผืนผ้าหลัก

ที่อัตราส่วนการซูมต่างๆ

test_multi_camera_switch_tele

การทดสอบนี้จะยืนยันว่าในระหว่างการบันทึกตัวอย่างที่อัตราส่วนการซูมต่างๆ การสลับระหว่างเลนส์ไวด์ (W) กับเลนส์เทเลโฟโต้ (tele) จะส่งผลให้ค่า RGB คล้ายกัน

การทดสอบจะใช้อัตราส่วนการซูมที่แตกต่างกันภายในช่วงที่กำหนดไว้ล่วงหน้าเพื่อทำการ บันทึกตัวอย่างแบบไดนามิกและระบุจุดที่กล้องจริง เปลี่ยน จุดนี้เป็นจุดที่เปลี่ยนจากเลนส์ W เป็นเลนส์เทเล

เฟรมที่จับภาพ ณ จุดครอสโอเวอร์และก่อนหน้านั้นจะได้รับการวิเคราะห์เพื่อหา AE, AWB และ AF

การตรวจสอบ AE จะยืนยันว่าการเปลี่ยนแปลงความสว่างอยู่ในช่วงที่คาดไว้สำหรับ ทั้งรูปภาพเลนส์ W และเลนส์เทเล การตรวจสอบ AWB จะยืนยันว่าอัตราส่วนของสีแดง-เขียว และสีน้ำเงิน-เขียวอยู่ในค่าเกณฑ์สำหรับทั้งรูปภาพเลนส์ W และเลนส์เทเล การตรวจสอบ AF จะประเมินค่าการประมาณความคมชัดตามขนาดการไล่ระดับเฉลี่ย ระหว่างภาพเลนส์ W และเลนส์เทเล

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#CONTROL_ZOOM_RATIO_RANGEandroid.hardware.camera2.CaptureRequest#CONTROL_ZOOM_RATIOandroid.media.CamcorderProfileandroid.media.MediaRecorder

ผ่าน: การทดสอบจะผ่านได้ก็ต่อเมื่อการตรวจสอบ AE, AWB และ AF ผ่านทั้งหมด เกณฑ์สำหรับการตรวจสอบแต่ละรายการมีดังนี้

- การตรวจสอบ AE: การเปลี่ยนแปลงความสว่างระหว่างรูปภาพเลนส์ W และเลนส์เทเลโฟโต้ต้องน้อยกว่า 4%

- การตรวจสอบ AWB: ในพื้นที่สี LAB ค่าเดลต้า C ระหว่างสีแดง-เขียวและ สีน้ำเงิน-เขียวสำหรับเลนส์ไวด์และเทเลโฟโต้ต้องไม่เกิน 10

- การตรวจสอบ AF: ความคมชัดของภาพจากเลนส์เทเลต้องสูงกว่าเลนส์ W

scene_flash

scene_flash การทดสอบต้องใช้ฉากมืดในกล่อง Sensor Fusion

test_auto_flash

การทดสอบที่ทริกเกอร์แฟลชอัตโนมัติในฉากมืดสำหรับกล้องหลังและ กล้องหน้า สำหรับกล้องหน้า แฟลชอัตโนมัติจะใช้หน้าจอเพื่อ ส่องสว่างฉาก ไม่ใช่หน่วยแฟลชจริง การทดสอบจะยืนยันว่า เปิดใช้แฟลชอัตโนมัติโดยตรวจสอบว่ากึ่งกลางของรูปภาพไทล์ สว่างขึ้นเมื่อเปิดใช้แฟลชอัตโนมัติ หากต้องการทริกเกอร์แฟลชอัตโนมัติ คุณต้องปิดไฟใน แท่นทดสอบ และปิดไฟได้โดยอัตโนมัติด้วย ตัวควบคุม Arduino ฉากต้องมืดสนิทเพื่อให้การทดสอบทำงานได้อย่างถูกต้อง ต้องติดตั้ง Jetpack Camera App (JCA) ในอุปกรณ์ก่อนทำการทดสอบ แฟลชอัตโนมัติสำหรับกล้องหลัง จะขึ้นอยู่กับสถานะ AE ในการทริกเกอร์ แต่แฟลชอัตโนมัติสำหรับกล้องหน้า จะไม่ขึ้นอยู่กับ AE และจะทริกเกอร์เสมอ

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#FLASH_INFO_AVAILABLEandroid.hardware.camera2.CaptureRequest#CONTROL_AE_MODEandroid.hardware.camera2.CaptureRequest#CONTROL_AE_PRECAPTURE_TRIGGERandroid.hardware.camera2.CaptureResult#CONTROL_AE_STATEandroid.hardware.camera2.CaptureRequest#FLASH_MODE

ผ่าน: ตรงกลางของรูปภาพไทล์ที่เปิดใช้แฟลชอัตโนมัติจะสว่างกว่า รูปภาพฉากต้นฉบับสำหรับกล้องทุกรุ่น

test_flash_strength

ทดสอบว่ามีการควบคุมความแรงของแฟลชในโหมด

SINGLE

อย่างถูกต้อง

ตรวจสอบว่าหากอุปกรณ์รองรับการควบคุมความแรงของแฟลชขณะใช้กล้องในโหมด SINGLE ความแรงของแฟลชจะเปลี่ยนไปตามระดับความแรงที่ขอแตกต่างกัน ยืนยันว่าการควบคุมความแรงของแฟลชทำงานร่วมกับ

AE_MODESต่างๆ ได้

เช่น หากโหมดการรับแสงอัตโนมัติเป็น ON หรือ OFF ระดับความแรงของแฟลช จะมีผลต่อความสว่าง และหากโหมดเป็น ON_AUTO_FLASH ระดับความแรงของแฟลช จะไม่มีผลต่อความสว่าง

หากต้องการทำการทดสอบ ต้องปิดไฟในแท่นทดสอบ คุณสามารถปิดไฟได้โดยอัตโนมัติด้วยตัวควบคุม Arduino ฉากต้องมืดสนิทเพื่อให้การทดสอบทำงานได้อย่างถูกต้อง

API ที่ทดสอบ:

android.hardware.camera2.CameraCharacteristics#FLASH_INFO_STRENGTH_DEFAULT_LEVELandroid.hardware.camera2.CameraCharacteristics#FLASH_INFO_STRENGTH_MAXIMUM_LEVELandroid.hardware.camera2.CameraCharacteristics#FLASH_SINGLE_STRENGTH_DEFAULT_LEVELandroid.hardware.camera2.CameraCharacteristics#FLASH_SINGLE_STRENGTH_MAX_LEVEL

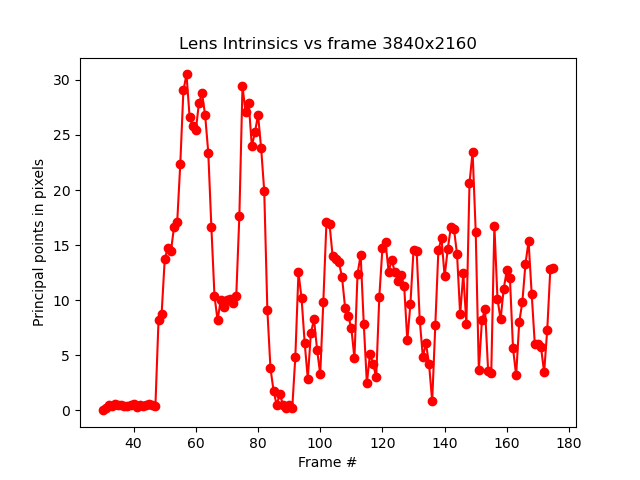

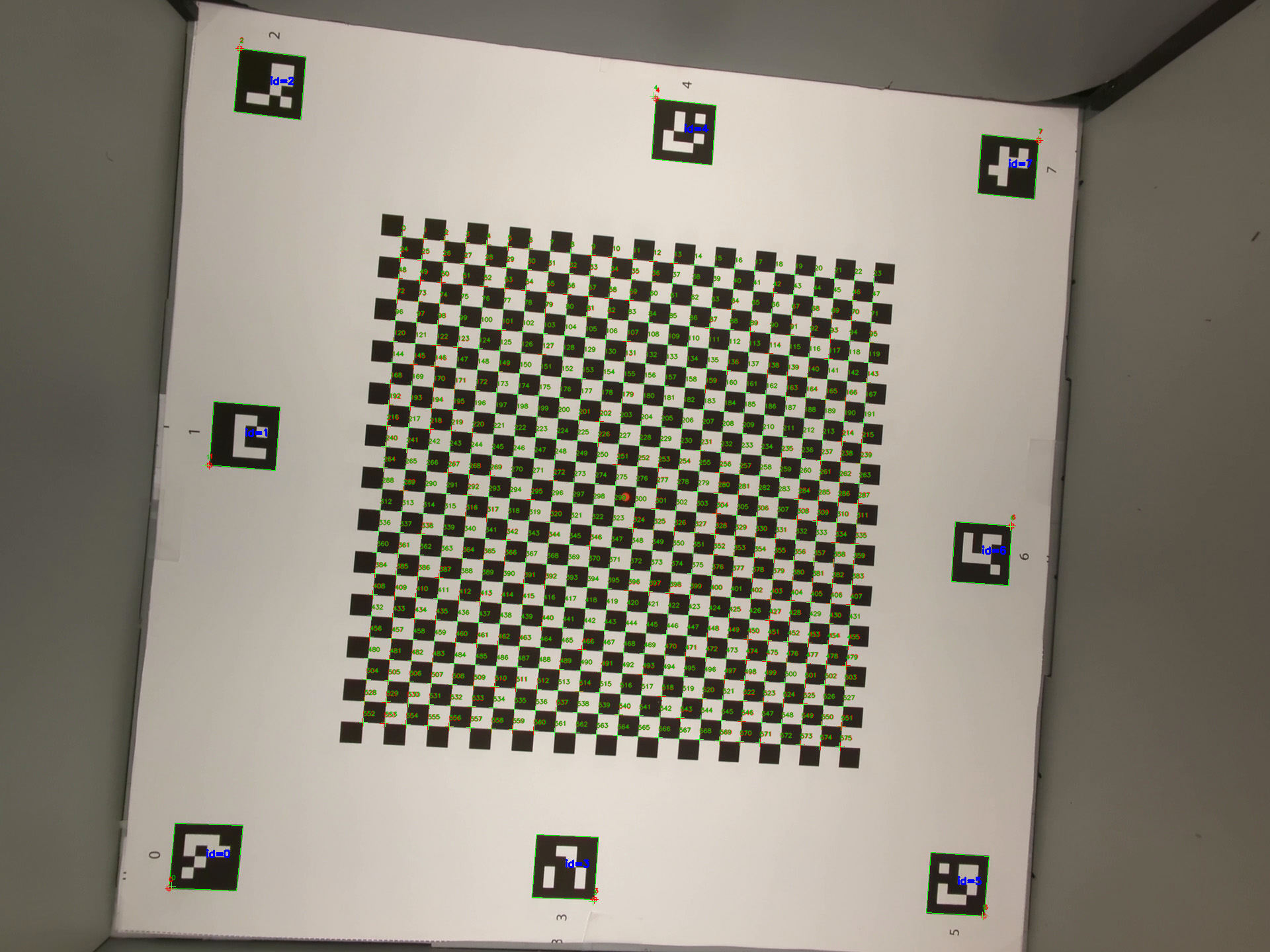

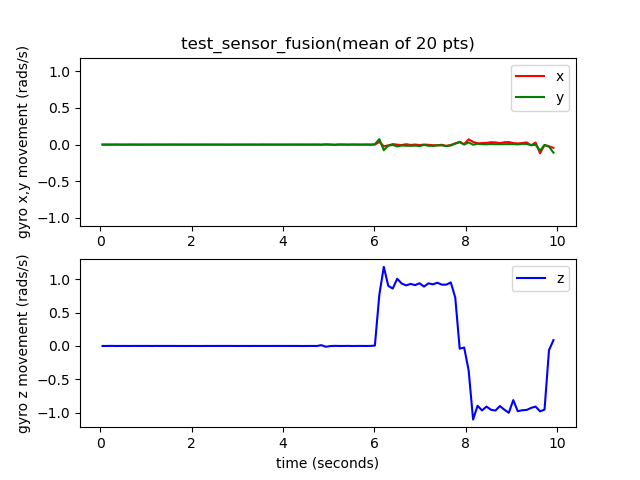

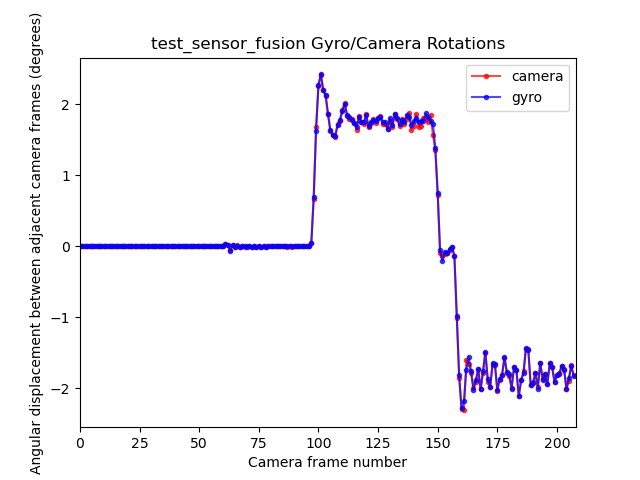

บัตร: